bevformer模型训练过程

本文已发表在知乎,辛苦移步~《bevformer模型训练过程》

最近把bevformer模型训练流程走了一遍,笔记如下。

算法介绍

细节参考:《mmdetection3d中bevformer解析》,类别共分为’smallMot’, ‘bigMot’, ‘nonMot’, ‘pedestrian’, 'TrainedOthers’共5类。

数据集

项目中使用了三十万帧私有数据进行训练,由于算力和时间限制,从中抽取了2万帧用于实验。评测集用了2000帧进行评测。

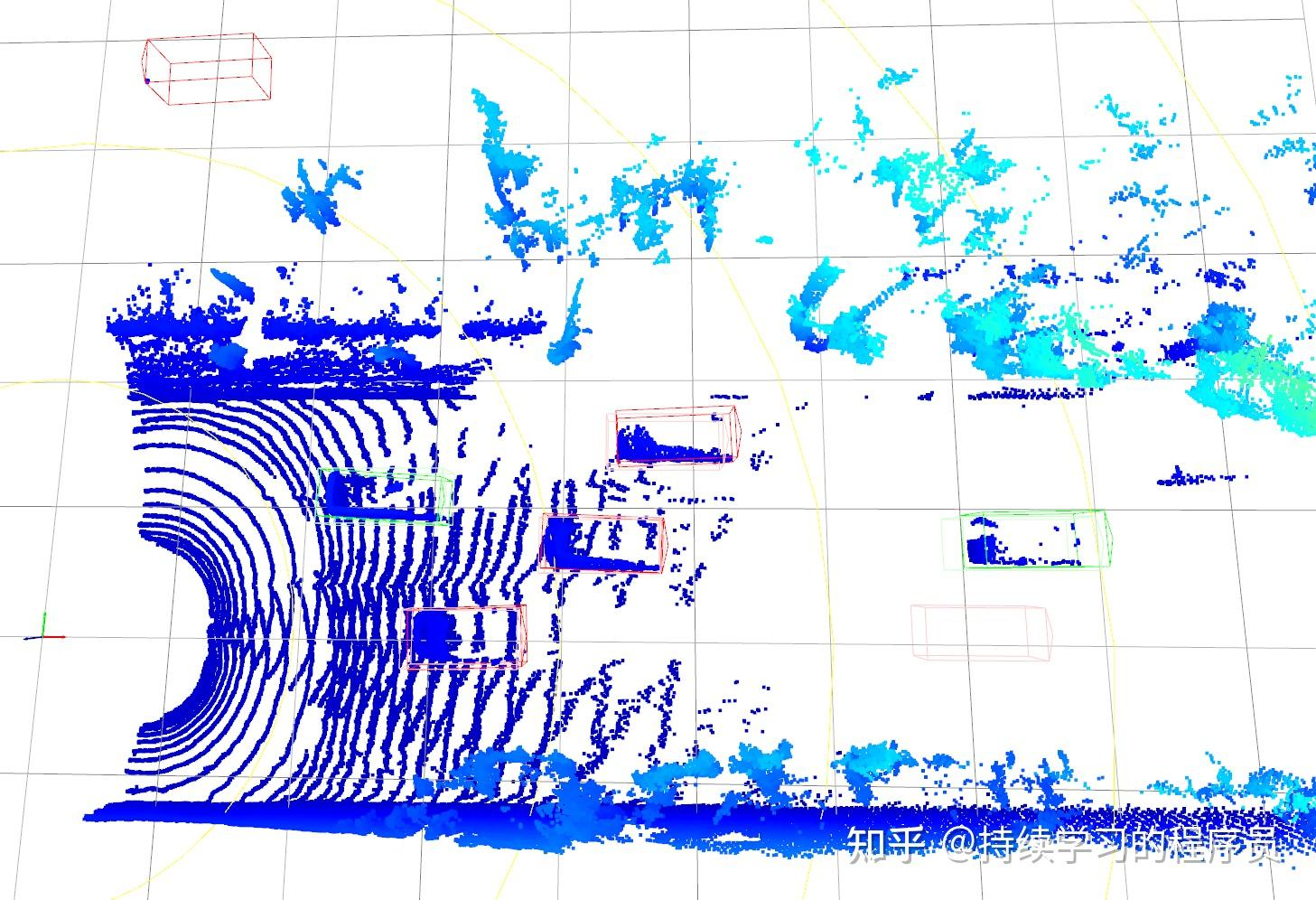

训练完了才发现只有车辆前方安装了激光雷达,因为数据标注是在雷达坐标系下(bevformer的预测的3d结果也是在lidar坐标系下),所以导致ground truth只有车辆前方才有。正常的bevformer用的是环视一圈的相机,效果应该会更好一些,本案例中相当于只用了左前,右前,正前三个方向的相机,并且也不会预测这三个相机视角里面的所有目标,只会预测这三个相机与激光雷达视角重叠的部分的目标(因为只有这个重叠部分有标注)。正好也验证了部分视角的bevformer也是可以work的。

训练

倒腾上百G数据到云端太费劲了,所以就在本地家用电脑上训练,24个epoch在1张3090卡上跑了大概37个小时。loss趋势如下,按照趋势来看,如果继续训练指标应该会继续上升一些: