Day49 Python打卡训练营

知识点回顾:

1.通道注意力模块复习

2.空间注意力模块

3.CBAM的定义

cbam模块介绍

cbam注意力

之前我们介绍了se通道注意力,我们说所有的模块本质上只是对特征进一步提取,今天进一步介绍cbam注意力

CBAM 是一种能够集成到任何卷积神经网络架构中的注意力模块。它的核心目标是通过学习的方式,自动获取特征图在通道和空间维度上的重要性,进而对特征图进行自适应调整,增强重要特征,抑制不重要特征,提升模型的特征表达能力和性能。简单来说,它就像是给模型装上了 “智能眼镜”,让模型能够更精准地看到图像中关键的部分

CBAM 由两个主要部分组成:通道注意力模块(Channel Attention Module)和空间注意力模块(Spatial Attention Module)。这两个模块顺序连接,共同作用于输入的特征图。

SE 通道注意力的局限:仅关注 “哪些通道重要”,未考虑 “重要信息在空间中的位置”。 CBAM 的突破: 通道注意力(Channel Attention):分析 “哪些通道的特征更关键”(如图像中的颜色、纹理通道)。 空间注意力(Spatial Attention):定位 “关键特征在图像中的具体位置”(如物体所在区域)。 二者结合:让模型同时学会 “关注什么” 和 “关注哪里”,提升特征表达能力。

输入特征图 → 通道注意力模块 → 空间注意力模块 → 输出增强后的特征图

轻量级设计:仅增加少量计算量(全局池化 + 简单卷积),适合嵌入各种 CNN 架构(如 ResNet、YOLO)。 即插即用:无需修改原有模型主体结构,直接作为模块插入卷积层之间。 双重优化:同时提升通道和空间维度的特征质量,尤其适合复杂场景(如小目标检测、语义分割)。

这些模块相较于cnn都属于即插即用

import torch

import torch.nn as nn# 定义通道注意力

class ChannelAttention(nn.Module):def __init__(self, in_channels, ratio=16):"""通道注意力机制初始化参数:in_channels: 输入特征图的通道数ratio: 降维比例,用于减少参数量,默认为16"""super().__init__()# 全局平均池化,将每个通道的特征图压缩为1x1,保留通道间的平均值信息self.avg_pool = nn.AdaptiveAvgPool2d(1)# 全局最大池化,将每个通道的特征图压缩为1x1,保留通道间的最显著特征self.max_pool = nn.AdaptiveMaxPool2d(1)# 共享全连接层,用于学习通道间的关系# 先降维(除以ratio),再通过ReLU激活,最后升维回原始通道数self.fc = nn.Sequential(nn.Linear(in_channels, in_channels // ratio, bias=False), # 降维层nn.ReLU(), # 非线性激活函数nn.Linear(in_channels // ratio, in_channels, bias=False) # 升维层)# Sigmoid函数将输出映射到0-1之间,作为各通道的权重self.sigmoid = nn.Sigmoid()def forward(self, x):"""前向传播函数参数:x: 输入特征图,形状为 [batch_size, channels, height, width]返回:调整后的特征图,通道权重已应用"""# 获取输入特征图的维度信息,这是一种元组的解包写法b, c, h, w = x.shape# 对平均池化结果进行处理:展平后通过全连接网络avg_out = self.fc(self.avg_pool(x).view(b, c))# 对最大池化结果进行处理:展平后通过全连接网络max_out = self.fc(self.max_pool(x).view(b, c))# 将平均池化和最大池化的结果相加并通过sigmoid函数得到通道权重attention = self.sigmoid(avg_out + max_out).view(b, c, 1, 1)# 将注意力权重与原始特征相乘,增强重要通道,抑制不重要通道return x * attention #这个运算是pytorch的广播机制## 空间注意力模块

class SpatialAttention(nn.Module):def __init__(self, kernel_size=7):super().__init__()self.conv = nn.Conv2d(2, 1, kernel_size, padding=kernel_size//2, bias=False)self.sigmoid = nn.Sigmoid()def forward(self, x):# 通道维度池化avg_out = torch.mean(x, dim=1, keepdim=True) # 平均池化:(B,1,H,W)max_out, _ = torch.max(x, dim=1, keepdim=True) # 最大池化:(B,1,H,W)pool_out = torch.cat([avg_out, max_out], dim=1) # 拼接:(B,2,H,W)attention = self.conv(pool_out) # 卷积提取空间特征return x * self.sigmoid(attention) # 特征与空间权重相乘## CBAM模块

class CBAM(nn.Module):def __init__(self, in_channels, ratio=16, kernel_size=7):super().__init__()self.channel_attn = ChannelAttention(in_channels, ratio)self.spatial_attn = SpatialAttention(kernel_size)def forward(self, x):x = self.channel_attn(x)x = self.spatial_attn(x)return x# 测试下通过CBAM模块的维度变化

# 输入卷积的尺寸为

# 假设输入特征图:batch=2,通道=512,尺寸=26x26

x = torch.randn(2, 512, 26, 26)

cbam = CBAM(in_channels=512)

output = cbam(x) # 输出形状不变:(2, 512, 26, 26)

print(f"Output shape: {output.shape}") # 验证输出维度Output shape: torch.Size([2, 512, 26, 26])

cnn+cbam训练

import torch

import torch.nn as nn

import torch.optim as optim

from torchvision import datasets, transforms

from torch.utils.data import DataLoader

import matplotlib.pyplot as plt

import numpy as np# 设置中文字体支持

plt.rcParams["font.family"] = ["SimHei"]

plt.rcParams['axes.unicode_minus'] = False # 解决负号显示问题# 检查GPU是否可用

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

print(f"使用设备: {device}")# 数据预处理(与原代码一致)

train_transform = transforms.Compose([transforms.RandomCrop(32, padding=4),transforms.RandomHorizontalFlip(),transforms.ColorJitter(brightness=0.2, contrast=0.2, saturation=0.2, hue=0.1),transforms.RandomRotation(15),transforms.ToTensor(),transforms.Normalize((0.4914, 0.4822, 0.4465), (0.2023, 0.1994, 0.2010))

])test_transform = transforms.Compose([transforms.ToTensor(),transforms.Normalize((0.4914, 0.4822, 0.4465), (0.2023, 0.1994, 0.2010))

])# 加载数据集(与原代码一致)

train_dataset = datasets.CIFAR10(root='./data', train=True, download=True, transform=train_transform)

test_dataset = datasets.CIFAR10(root='./data', train=False, transform=test_transform)

train_loader = DataLoader(train_dataset, batch_size=64, shuffle=True)

test_loader = DataLoader(test_dataset, batch_size=64, shuffle=False)使用设备: cuda

Files already downloaded and verified

# 定义带有CBAM的CNN模型

class CBAM_CNN(nn.Module):def __init__(self):super(CBAM_CNN, self).__init__()# ---------------------- 第一个卷积块(带CBAM) ----------------------self.conv1 = nn.Conv2d(3, 32, kernel_size=3, padding=1)self.bn1 = nn.BatchNorm2d(32) # 批归一化self.relu1 = nn.ReLU()self.pool1 = nn.MaxPool2d(kernel_size=2)self.cbam1 = CBAM(in_channels=32) # 在第一个卷积块后添加CBAM# ---------------------- 第二个卷积块(带CBAM) ----------------------self.conv2 = nn.Conv2d(32, 64, kernel_size=3, padding=1)self.bn2 = nn.BatchNorm2d(64)self.relu2 = nn.ReLU()self.pool2 = nn.MaxPool2d(kernel_size=2)self.cbam2 = CBAM(in_channels=64) # 在第二个卷积块后添加CBAM# ---------------------- 第三个卷积块(带CBAM) ----------------------self.conv3 = nn.Conv2d(64, 128, kernel_size=3, padding=1)self.bn3 = nn.BatchNorm2d(128)self.relu3 = nn.ReLU()self.pool3 = nn.MaxPool2d(kernel_size=2)self.cbam3 = CBAM(in_channels=128) # 在第三个卷积块后添加CBAM# ---------------------- 全连接层 ----------------------self.fc1 = nn.Linear(128 * 4 * 4, 512)self.dropout = nn.Dropout(p=0.5)self.fc2 = nn.Linear(512, 10)def forward(self, x):# 第一个卷积块x = self.conv1(x)x = self.bn1(x)x = self.relu1(x)x = self.pool1(x)x = self.cbam1(x) # 应用CBAM# 第二个卷积块x = self.conv2(x)x = self.bn2(x)x = self.relu2(x)x = self.pool2(x)x = self.cbam2(x) # 应用CBAM# 第三个卷积块x = self.conv3(x)x = self.bn3(x)x = self.relu3(x)x = self.pool3(x)x = self.cbam3(x) # 应用CBAM# 全连接层x = x.view(-1, 128 * 4 * 4)x = self.fc1(x)x = self.relu3(x)x = self.dropout(x)x = self.fc2(x)return x# 初始化模型并移至设备

model = CBAM_CNN().to(device)

criterion = nn.CrossEntropyLoss()

optimizer = optim.Adam(model.parameters(), lr=0.001)

scheduler = optim.lr_scheduler.ReduceLROnPlateau(optimizer, mode='min', patience=3, factor=0.5)# 训练函数

def train(model, train_loader, test_loader, criterion, optimizer, scheduler, device, epochs):model.train()all_iter_losses = []iter_indices = []train_acc_history = []test_acc_history = []train_loss_history = []test_loss_history = []for epoch in range(epochs):running_loss = 0.0correct = 0total = 0for batch_idx, (data, target) in enumerate(train_loader):data, target = data.to(device), target.to(device)optimizer.zero_grad()output = model(data)loss = criterion(output, target)loss.backward()optimizer.step()iter_loss = loss.item()all_iter_losses.append(iter_loss)iter_indices.append(epoch * len(train_loader) + batch_idx + 1)running_loss += iter_loss_, predicted = output.max(1)total += target.size(0)correct += predicted.eq(target).sum().item()if (batch_idx + 1) % 100 == 0:print(f'Epoch: {epoch+1}/{epochs} | Batch: {batch_idx+1}/{len(train_loader)} 'f'| 单Batch损失: {iter_loss:.4f} | 累计平均损失: {running_loss/(batch_idx+1):.4f}')epoch_train_loss = running_loss / len(train_loader)epoch_train_acc = 100. * correct / totaltrain_acc_history.append(epoch_train_acc)train_loss_history.append(epoch_train_loss)# 测试阶段model.eval()test_loss = 0correct_test = 0total_test = 0with torch.no_grad():for data, target in test_loader:data, target = data.to(device), target.to(device)output = model(data)test_loss += criterion(output, target).item()_, predicted = output.max(1)total_test += target.size(0)correct_test += predicted.eq(target).sum().item()epoch_test_loss = test_loss / len(test_loader)epoch_test_acc = 100. * correct_test / total_testtest_acc_history.append(epoch_test_acc)test_loss_history.append(epoch_test_loss)scheduler.step(epoch_test_loss)print(f'Epoch {epoch+1}/{epochs} 完成 | 训练准确率: {epoch_train_acc:.2f}% | 测试准确率: {epoch_test_acc:.2f}%')plot_iter_losses(all_iter_losses, iter_indices)plot_epoch_metrics(train_acc_history, test_acc_history, train_loss_history, test_loss_history)return epoch_test_acc# 绘图函数

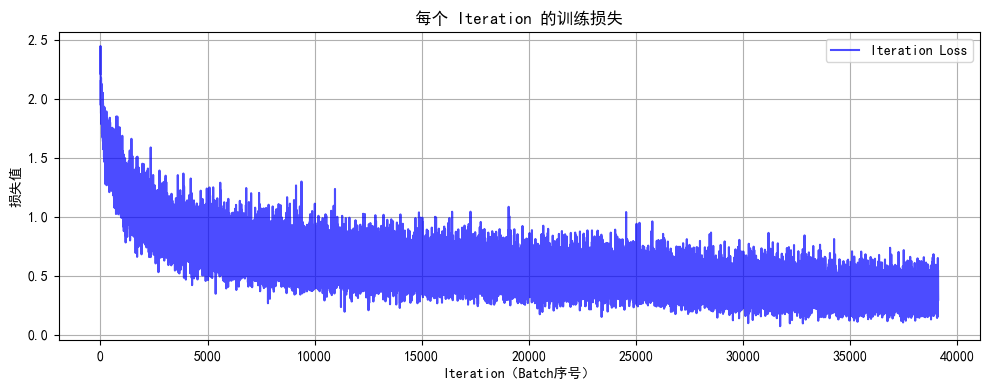

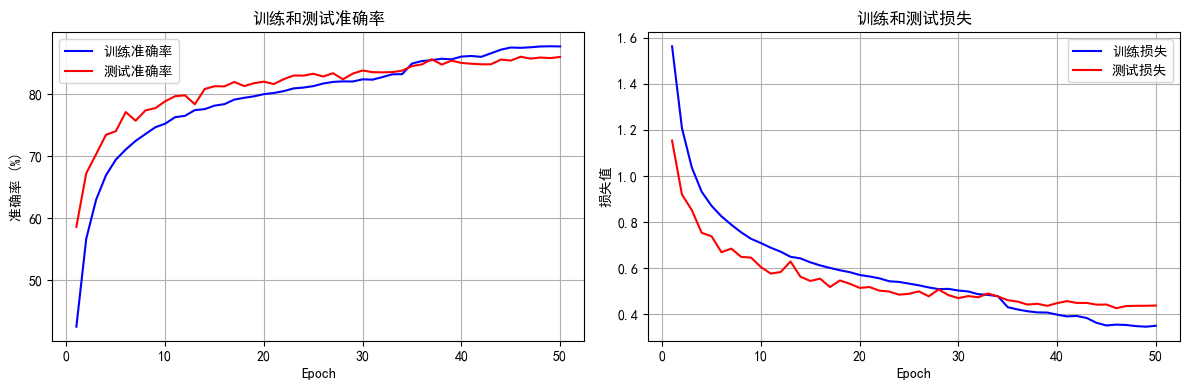

def plot_iter_losses(losses, indices):plt.figure(figsize=(10, 4))plt.plot(indices, losses, 'b-', alpha=0.7, label='Iteration Loss')plt.xlabel('Iteration(Batch序号)')plt.ylabel('损失值')plt.title('每个 Iteration 的训练损失')plt.legend()plt.grid(True)plt.tight_layout()plt.show()def plot_epoch_metrics(train_acc, test_acc, train_loss, test_loss):epochs = range(1, len(train_acc) + 1)plt.figure(figsize=(12, 4))plt.subplot(1, 2, 1)plt.plot(epochs, train_acc, 'b-', label='训练准确率')plt.plot(epochs, test_acc, 'r-', label='测试准确率')plt.xlabel('Epoch')plt.ylabel('准确率 (%)')plt.title('训练和测试准确率')plt.legend()plt.grid(True)plt.subplot(1, 2, 2)plt.plot(epochs, train_loss, 'b-', label='训练损失')plt.plot(epochs, test_loss, 'r-', label='测试损失')plt.xlabel('Epoch')plt.ylabel('损失值')plt.title('训练和测试损失')plt.legend()plt.grid(True)plt.tight_layout()plt.show()# 执行训练

epochs = 50

print("开始使用带CBAM的CNN训练模型...")

final_accuracy = train(model, train_loader, test_loader, criterion, optimizer, scheduler, device, epochs)

print(f"训练完成!最终测试准确率: {final_accuracy:.2f}%")# # 保存模型

# torch.save(model.state_dict(), 'cifar10_cbam_cnn_model.pth')

# print("模型已保存为: cifar10_cbam_cnn_model.pth")开始使用带CBAM的CNN训练模型...

Epoch: 1/50 | Batch: 100/782 | 单Batch损失: 1.8068 | 累计平均损失: 1.9504

Epoch: 1/50 | Batch: 200/782 | 单Batch损失: 1.6703 | 累计平均损失: 1.8310

Epoch: 1/50 | Batch: 300/782 | 单Batch损失: 1.7282 | 累计平均损失: 1.7603

Epoch: 1/50 | Batch: 400/782 | 单Batch损失: 1.4028 | 累计平均损失: 1.7050

Epoch: 1/50 | Batch: 500/782 | 单Batch损失: 1.2384 | 累计平均损失: 1.6675

Epoch: 1/50 | Batch: 600/782 | 单Batch损失: 1.3262 | 累计平均损失: 1.6308

Epoch: 1/50 | Batch: 700/782 | 单Batch损失: 1.2315 | 累计平均损失: 1.5930

Epoch 1/50 完成 | 训练准确率: 42.49% | 测试准确率: 58.60%

Epoch: 2/50 | Batch: 100/782 | 单Batch损失: 1.1333 | 累计平均损失: 1.3602

Epoch: 2/50 | Batch: 200/782 | 单Batch损失: 1.2330 | 累计平均损失: 1.3296

Epoch: 2/50 | Batch: 300/782 | 单Batch损失: 0.9225 | 累计平均损失: 1.2934

Epoch: 2/50 | Batch: 400/782 | 单Batch损失: 0.9983 | 累计平均损失: 1.2701

Epoch: 2/50 | Batch: 500/782 | 单Batch损失: 1.0356 | 累计平均损失: 1.2461

Epoch: 2/50 | Batch: 600/782 | 单Batch损失: 1.0236 | 累计平均损失: 1.2341

Epoch: 2/50 | Batch: 700/782 | 单Batch损失: 1.2743 | 累计平均损失: 1.2210

Epoch 2/50 完成 | 训练准确率: 56.67% | 测试准确率: 67.22%

Epoch: 3/50 | Batch: 100/782 | 单Batch损失: 1.2205 | 累计平均损失: 1.0597

Epoch: 3/50 | Batch: 200/782 | 单Batch损失: 1.1222 | 累计平均损失: 1.0563

Epoch: 3/50 | Batch: 300/782 | 单Batch损失: 1.0490 | 累计平均损失: 1.0634

Epoch: 3/50 | Batch: 400/782 | 单Batch损失: 0.9543 | 累计平均损失: 1.0599

Epoch: 3/50 | Batch: 500/782 | 单Batch损失: 0.9437 | 累计平均损失: 1.0528

Epoch: 3/50 | Batch: 600/782 | 单Batch损失: 1.2708 | 累计平均损失: 1.0465

Epoch: 3/50 | Batch: 700/782 | 单Batch损失: 0.8789 | 累计平均损失: 1.0448

Epoch 3/50 完成 | 训练准确率: 62.97% | 测试准确率: 70.30%

Epoch: 4/50 | Batch: 100/782 | 单Batch损失: 0.9047 | 累计平均损失: 0.9669

Epoch: 4/50 | Batch: 200/782 | 单Batch损失: 0.8886 | 累计平均损失: 0.9593

Epoch: 4/50 | Batch: 300/782 | 单Batch损失: 0.8078 | 累计平均损失: 0.9465

Epoch: 4/50 | Batch: 400/782 | 单Batch损失: 0.7879 | 累计平均损失: 0.9358

Epoch: 4/50 | Batch: 500/782 | 单Batch损失: 0.7902 | 累计平均损失: 0.9366

Epoch: 4/50 | Batch: 600/782 | 单Batch损失: 0.8576 | 累计平均损失: 0.9326

Epoch: 4/50 | Batch: 700/782 | 单Batch损失: 1.3249 | 累计平均损失: 0.9338

Epoch 4/50 完成 | 训练准确率: 66.91% | 测试准确率: 73.43%

Epoch: 5/50 | Batch: 100/782 | 单Batch损失: 0.8714 | 累计平均损失: 0.8887

Epoch: 5/50 | Batch: 200/782 | 单Batch损失: 0.8037 | 累计平均损失: 0.8927

Epoch: 5/50 | Batch: 300/782 | 单Batch损失: 0.7800 | 累计平均损失: 0.8819

Epoch: 5/50 | Batch: 400/782 | 单Batch损失: 1.1443 | 累计平均损失: 0.8738

Epoch: 5/50 | Batch: 500/782 | 单Batch损失: 0.8283 | 累计平均损失: 0.8736

Epoch: 5/50 | Batch: 600/782 | 单Batch损失: 0.8296 | 累计平均损失: 0.8714

Epoch: 5/50 | Batch: 700/782 | 单Batch损失: 0.7007 | 累计平均损失: 0.8718

Epoch 5/50 完成 | 训练准确率: 69.43% | 测试准确率: 74.02%

Epoch: 6/50 | Batch: 100/782 | 单Batch损失: 0.7123 | 累计平均损失: 0.8264

Epoch: 6/50 | Batch: 200/782 | 单Batch损失: 0.6168 | 累计平均损失: 0.8334

Epoch: 6/50 | Batch: 300/782 | 单Batch损失: 0.7244 | 累计平均损失: 0.8301

Epoch: 6/50 | Batch: 400/782 | 单Batch损失: 0.8604 | 累计平均损失: 0.8263

Epoch: 6/50 | Batch: 500/782 | 单Batch损失: 1.0281 | 累计平均损失: 0.8277

Epoch: 6/50 | Batch: 600/782 | 单Batch损失: 0.8731 | 累计平均损失: 0.8222

Epoch: 6/50 | Batch: 700/782 | 单Batch损失: 0.7084 | 累计平均损失: 0.8228

Epoch 6/50 完成 | 训练准确率: 71.06% | 测试准确率: 77.10%

Epoch: 7/50 | Batch: 100/782 | 单Batch损失: 0.9166 | 累计平均损失: 0.7944

Epoch: 7/50 | Batch: 200/782 | 单Batch损失: 0.6985 | 累计平均损失: 0.7973

Epoch: 7/50 | Batch: 300/782 | 单Batch损失: 0.8930 | 累计平均损失: 0.7911

Epoch: 7/50 | Batch: 400/782 | 单Batch损失: 0.7999 | 累计平均损失: 0.7938

Epoch: 7/50 | Batch: 500/782 | 单Batch损失: 0.6559 | 累计平均损失: 0.7925

Epoch: 7/50 | Batch: 600/782 | 单Batch损失: 0.7200 | 累计平均损失: 0.7903

Epoch: 7/50 | Batch: 700/782 | 单Batch损失: 0.8668 | 累计平均损失: 0.7900

Epoch 7/50 完成 | 训练准确率: 72.44% | 测试准确率: 75.70%

Epoch: 8/50 | Batch: 100/782 | 单Batch损失: 0.7175 | 累计平均损失: 0.7552

Epoch: 8/50 | Batch: 200/782 | 单Batch损失: 0.6332 | 累计平均损失: 0.7645

Epoch: 8/50 | Batch: 300/782 | 单Batch损失: 0.5731 | 累计平均损失: 0.7526

Epoch: 8/50 | Batch: 400/782 | 单Batch损失: 0.7617 | 累计平均损失: 0.7517

Epoch: 8/50 | Batch: 500/782 | 单Batch损失: 0.6892 | 累计平均损失: 0.7515

Epoch: 8/50 | Batch: 600/782 | 单Batch损失: 0.7312 | 累计平均损失: 0.7549

Epoch: 8/50 | Batch: 700/782 | 单Batch损失: 0.8937 | 累计平均损失: 0.7541

Epoch 8/50 完成 | 训练准确率: 73.56% | 测试准确率: 77.37%

Epoch: 9/50 | Batch: 100/782 | 单Batch损失: 0.8760 | 累计平均损失: 0.7398

Epoch: 9/50 | Batch: 200/782 | 单Batch损失: 0.5123 | 累计平均损失: 0.7349

Epoch: 9/50 | Batch: 300/782 | 单Batch损失: 0.7036 | 累计平均损失: 0.7311

Epoch: 9/50 | Batch: 400/782 | 单Batch损失: 0.6847 | 累计平均损失: 0.7306

Epoch: 9/50 | Batch: 500/782 | 单Batch损失: 0.8799 | 累计平均损失: 0.7301

Epoch: 9/50 | Batch: 600/782 | 单Batch损失: 0.8324 | 累计平均损失: 0.7331

Epoch: 9/50 | Batch: 700/782 | 单Batch损失: 0.7336 | 累计平均损失: 0.7303

Epoch 9/50 完成 | 训练准确率: 74.65% | 测试准确率: 77.73%

Epoch: 10/50 | Batch: 100/782 | 单Batch损失: 0.7165 | 累计平均损失: 0.6921

Epoch: 10/50 | Batch: 200/782 | 单Batch损失: 0.6091 | 累计平均损失: 0.7094

Epoch: 10/50 | Batch: 300/782 | 单Batch损失: 0.7060 | 累计平均损失: 0.7076

Epoch: 10/50 | Batch: 400/782 | 单Batch损失: 0.5803 | 累计平均损失: 0.7094

Epoch: 10/50 | Batch: 500/782 | 单Batch损失: 0.5968 | 累计平均损失: 0.7075

Epoch: 10/50 | Batch: 600/782 | 单Batch损失: 0.6240 | 累计平均损失: 0.7096

Epoch: 10/50 | Batch: 700/782 | 单Batch损失: 0.8921 | 累计平均损失: 0.7061

Epoch 10/50 完成 | 训练准确率: 75.23% | 测试准确率: 78.84%

Epoch: 11/50 | Batch: 100/782 | 单Batch损失: 0.8392 | 累计平均损失: 0.6906

Epoch: 11/50 | Batch: 200/782 | 单Batch损失: 0.4255 | 累计平均损失: 0.6749

Epoch: 11/50 | Batch: 300/782 | 单Batch损失: 0.8817 | 累计平均损失: 0.6839

Epoch: 11/50 | Batch: 400/782 | 单Batch损失: 0.9127 | 累计平均损失: 0.6882

Epoch: 11/50 | Batch: 500/782 | 单Batch损失: 0.5295 | 累计平均损失: 0.6912

Epoch: 11/50 | Batch: 600/782 | 单Batch损失: 0.7363 | 累计平均损失: 0.6908

Epoch: 11/50 | Batch: 700/782 | 单Batch损失: 0.5202 | 累计平均损失: 0.6884

Epoch 11/50 完成 | 训练准确率: 76.27% | 测试准确率: 79.65%

Epoch: 12/50 | Batch: 100/782 | 单Batch损失: 0.5777 | 累计平均损失: 0.6737

Epoch: 12/50 | Batch: 200/782 | 单Batch损失: 0.5878 | 累计平均损失: 0.6811

Epoch: 12/50 | Batch: 300/782 | 单Batch损失: 0.6180 | 累计平均损失: 0.6728

Epoch: 12/50 | Batch: 400/782 | 单Batch损失: 0.7010 | 累计平均损失: 0.6668

Epoch: 12/50 | Batch: 500/782 | 单Batch损失: 0.6033 | 累计平均损失: 0.6715

Epoch: 12/50 | Batch: 600/782 | 单Batch损失: 0.6178 | 累计平均损失: 0.6699

Epoch: 12/50 | Batch: 700/782 | 单Batch损失: 0.8882 | 累计平均损失: 0.6699

Epoch 12/50 完成 | 训练准确率: 76.49% | 测试准确率: 79.79%

Epoch: 13/50 | Batch: 100/782 | 单Batch损失: 0.4695 | 累计平均损失: 0.6513

Epoch: 13/50 | Batch: 200/782 | 单Batch损失: 0.7189 | 累计平均损失: 0.6444

Epoch: 13/50 | Batch: 300/782 | 单Batch损失: 0.5062 | 累计平均损失: 0.6449

Epoch: 13/50 | Batch: 400/782 | 单Batch损失: 0.5209 | 累计平均损失: 0.6505

Epoch: 13/50 | Batch: 500/782 | 单Batch损失: 0.6702 | 累计平均损失: 0.6469

Epoch: 13/50 | Batch: 600/782 | 单Batch损失: 0.6283 | 累计平均损失: 0.6486

Epoch: 13/50 | Batch: 700/782 | 单Batch损失: 0.7709 | 累计平均损失: 0.6489

Epoch 13/50 完成 | 训练准确率: 77.41% | 测试准确率: 78.36%

Epoch: 14/50 | Batch: 100/782 | 单Batch损失: 0.5958 | 累计平均损失: 0.6527

Epoch: 14/50 | Batch: 200/782 | 单Batch损失: 0.6085 | 累计平均损失: 0.6396

Epoch: 14/50 | Batch: 300/782 | 单Batch损失: 0.5621 | 累计平均损失: 0.6339

Epoch: 14/50 | Batch: 400/782 | 单Batch损失: 0.3217 | 累计平均损失: 0.6383

Epoch: 14/50 | Batch: 500/782 | 单Batch损失: 0.5894 | 累计平均损失: 0.6377

Epoch: 14/50 | Batch: 600/782 | 单Batch损失: 0.6295 | 累计平均损失: 0.6393

Epoch: 14/50 | Batch: 700/782 | 单Batch损失: 0.5119 | 累计平均损失: 0.6411

Epoch 14/50 完成 | 训练准确率: 77.57% | 测试准确率: 80.82%

Epoch: 15/50 | Batch: 100/782 | 单Batch损失: 0.7048 | 累计平均损失: 0.6209

Epoch: 15/50 | Batch: 200/782 | 单Batch损失: 0.4222 | 累计平均损失: 0.6307

Epoch: 15/50 | Batch: 300/782 | 单Batch损失: 0.5744 | 累计平均损失: 0.6302

Epoch: 15/50 | Batch: 400/782 | 单Batch损失: 0.5282 | 累计平均损失: 0.6266

Epoch: 15/50 | Batch: 500/782 | 单Batch损失: 0.7231 | 累计平均损失: 0.6227

Epoch: 15/50 | Batch: 600/782 | 单Batch损失: 0.6799 | 累计平均损失: 0.6259

Epoch: 15/50 | Batch: 700/782 | 单Batch损失: 0.6691 | 累计平均损失: 0.6288

Epoch 15/50 完成 | 训练准确率: 78.14% | 测试准确率: 81.26%

Epoch: 16/50 | Batch: 100/782 | 单Batch损失: 0.5496 | 累计平均损失: 0.6028

Epoch: 16/50 | Batch: 200/782 | 单Batch损失: 0.7343 | 累计平均损失: 0.6084

Epoch: 16/50 | Batch: 300/782 | 单Batch损失: 0.4796 | 累计平均损失: 0.6088

Epoch: 16/50 | Batch: 400/782 | 单Batch损失: 0.6605 | 累计平均损失: 0.6051

Epoch: 16/50 | Batch: 500/782 | 单Batch损失: 0.4469 | 累计平均损失: 0.6081

Epoch: 16/50 | Batch: 600/782 | 单Batch损失: 0.5591 | 累计平均损失: 0.6098

Epoch: 16/50 | Batch: 700/782 | 单Batch损失: 0.4150 | 累计平均损失: 0.6122

Epoch 16/50 完成 | 训练准确率: 78.38% | 测试准确率: 81.24%

Epoch: 17/50 | Batch: 100/782 | 单Batch损失: 0.7903 | 累计平均损失: 0.6028

Epoch: 17/50 | Batch: 200/782 | 单Batch损失: 0.6390 | 累计平均损失: 0.5975

Epoch: 17/50 | Batch: 300/782 | 单Batch损失: 0.5029 | 累计平均损失: 0.5954

Epoch: 17/50 | Batch: 400/782 | 单Batch损失: 0.6530 | 累计平均损失: 0.5988

Epoch: 17/50 | Batch: 500/782 | 单Batch损失: 0.6598 | 累计平均损失: 0.5976

Epoch: 17/50 | Batch: 600/782 | 单Batch损失: 0.4620 | 累计平均损失: 0.5987

Epoch: 17/50 | Batch: 700/782 | 单Batch损失: 0.4572 | 累计平均损失: 0.5989

Epoch 17/50 完成 | 训练准确率: 79.11% | 测试准确率: 81.95%

Epoch: 18/50 | Batch: 100/782 | 单Batch损失: 0.8232 | 累计平均损失: 0.5920

Epoch: 18/50 | Batch: 200/782 | 单Batch损失: 0.4122 | 累计平均损失: 0.5796

Epoch: 18/50 | Batch: 300/782 | 单Batch损失: 0.7608 | 累计平均损失: 0.5941

Epoch: 18/50 | Batch: 400/782 | 单Batch损失: 0.4806 | 累计平均损失: 0.5960

Epoch: 18/50 | Batch: 500/782 | 单Batch损失: 0.4139 | 累计平均损失: 0.5960

Epoch: 18/50 | Batch: 600/782 | 单Batch损失: 0.4981 | 累计平均损失: 0.5947

Epoch: 18/50 | Batch: 700/782 | 单Batch损失: 0.5214 | 累计平均损失: 0.5906

Epoch 18/50 完成 | 训练准确率: 79.40% | 测试准确率: 81.29%

Epoch: 19/50 | Batch: 100/782 | 单Batch损失: 0.5081 | 累计平均损失: 0.5887

Epoch: 19/50 | Batch: 200/782 | 单Batch损失: 0.5368 | 累计平均损失: 0.5874

Epoch: 19/50 | Batch: 300/782 | 单Batch损失: 0.5433 | 累计平均损失: 0.5830

Epoch: 19/50 | Batch: 400/782 | 单Batch损失: 0.5979 | 累计平均损失: 0.5804

Epoch: 19/50 | Batch: 500/782 | 单Batch损失: 0.5381 | 累计平均损失: 0.5762

Epoch: 19/50 | Batch: 600/782 | 单Batch损失: 0.4585 | 累计平均损失: 0.5801

Epoch: 19/50 | Batch: 700/782 | 单Batch损失: 0.6012 | 累计平均损失: 0.5794

Epoch 19/50 完成 | 训练准确率: 79.64% | 测试准确率: 81.75%

Epoch: 20/50 | Batch: 100/782 | 单Batch损失: 0.5562 | 累计平均损失: 0.5775

Epoch: 20/50 | Batch: 200/782 | 单Batch损失: 0.5135 | 累计平均损失: 0.5794

Epoch: 20/50 | Batch: 300/782 | 单Batch损失: 0.5336 | 累计平均损失: 0.5776

Epoch: 20/50 | Batch: 400/782 | 单Batch损失: 0.5229 | 累计平均损失: 0.5761

Epoch: 20/50 | Batch: 500/782 | 单Batch损失: 0.4623 | 累计平均损失: 0.5713

Epoch: 20/50 | Batch: 600/782 | 单Batch损失: 0.6300 | 累计平均损失: 0.5690

Epoch: 20/50 | Batch: 700/782 | 单Batch损失: 0.6291 | 累计平均损失: 0.5707

Epoch 20/50 完成 | 训练准确率: 79.99% | 测试准确率: 82.00%

Epoch: 21/50 | Batch: 100/782 | 单Batch损失: 0.4574 | 累计平均损失: 0.5482

Epoch: 21/50 | Batch: 200/782 | 单Batch损失: 0.8479 | 累计平均损失: 0.5593

Epoch: 21/50 | Batch: 300/782 | 单Batch损失: 0.4395 | 累计平均损失: 0.5591

Epoch: 21/50 | Batch: 400/782 | 单Batch损失: 0.5584 | 累计平均损失: 0.5588

Epoch: 21/50 | Batch: 500/782 | 单Batch损失: 0.6799 | 累计平均损失: 0.5591

Epoch: 21/50 | Batch: 600/782 | 单Batch损失: 0.6693 | 累计平均损失: 0.5612

Epoch: 21/50 | Batch: 700/782 | 单Batch损失: 0.6641 | 累计平均损失: 0.5618

Epoch 21/50 完成 | 训练准确率: 80.17% | 测试准确率: 81.61%

Epoch: 22/50 | Batch: 100/782 | 单Batch损失: 0.5207 | 累计平均损失: 0.5465

Epoch: 22/50 | Batch: 200/782 | 单Batch损失: 0.4003 | 累计平均损失: 0.5554

Epoch: 22/50 | Batch: 300/782 | 单Batch损失: 0.4804 | 累计平均损失: 0.5541

Epoch: 22/50 | Batch: 400/782 | 单Batch损失: 0.6084 | 累计平均损失: 0.5559

Epoch: 22/50 | Batch: 500/782 | 单Batch损失: 0.7097 | 累计平均损失: 0.5515

Epoch: 22/50 | Batch: 600/782 | 单Batch损失: 0.5282 | 累计平均损失: 0.5560

Epoch: 22/50 | Batch: 700/782 | 单Batch损失: 0.5192 | 累计平均损失: 0.5556

Epoch 22/50 完成 | 训练准确率: 80.47% | 测试准确率: 82.40%

Epoch: 23/50 | Batch: 100/782 | 单Batch损失: 0.4791 | 累计平均损失: 0.5384

Epoch: 23/50 | Batch: 200/782 | 单Batch损失: 0.7563 | 累计平均损失: 0.5305

Epoch: 23/50 | Batch: 300/782 | 单Batch损失: 0.4415 | 累计平均损失: 0.5409

Epoch: 23/50 | Batch: 400/782 | 单Batch损失: 0.4734 | 累计平均损失: 0.5394

Epoch: 23/50 | Batch: 500/782 | 单Batch损失: 0.6719 | 累计平均损失: 0.5417

Epoch: 23/50 | Batch: 600/782 | 单Batch损失: 0.5048 | 累计平均损失: 0.5423

Epoch: 23/50 | Batch: 700/782 | 单Batch损失: 0.4834 | 累计平均损失: 0.5444

Epoch 23/50 完成 | 训练准确率: 80.91% | 测试准确率: 82.99%

Epoch: 24/50 | Batch: 100/782 | 单Batch损失: 0.7115 | 累计平均损失: 0.5322

Epoch: 24/50 | Batch: 200/782 | 单Batch损失: 0.4290 | 累计平均损失: 0.5369

Epoch: 24/50 | Batch: 300/782 | 单Batch损失: 0.5661 | 累计平均损失: 0.5322

Epoch: 24/50 | Batch: 400/782 | 单Batch损失: 0.4407 | 累计平均损失: 0.5312

Epoch: 24/50 | Batch: 500/782 | 单Batch损失: 0.8303 | 累计平均损失: 0.5351

Epoch: 24/50 | Batch: 600/782 | 单Batch损失: 0.6202 | 累计平均损失: 0.5353

Epoch: 24/50 | Batch: 700/782 | 单Batch损失: 0.5813 | 累计平均损失: 0.5361

Epoch 24/50 完成 | 训练准确率: 81.04% | 测试准确率: 82.97%

Epoch: 25/50 | Batch: 100/782 | 单Batch损失: 0.5002 | 累计平均损失: 0.5237

Epoch: 25/50 | Batch: 200/782 | 单Batch损失: 0.4924 | 累计平均损失: 0.5197

Epoch: 25/50 | Batch: 300/782 | 单Batch损失: 0.3069 | 累计平均损失: 0.5273

Epoch: 25/50 | Batch: 400/782 | 单Batch损失: 0.3876 | 累计平均损失: 0.5339

Epoch: 25/50 | Batch: 500/782 | 单Batch损失: 0.5452 | 累计平均损失: 0.5333

Epoch: 25/50 | Batch: 600/782 | 单Batch损失: 0.6578 | 累计平均损失: 0.5331

Epoch: 25/50 | Batch: 700/782 | 单Batch损失: 0.3714 | 累计平均损失: 0.5341

Epoch 25/50 完成 | 训练准确率: 81.28% | 测试准确率: 83.27%

Epoch: 26/50 | Batch: 100/782 | 单Batch损失: 0.5367 | 累计平均损失: 0.5102

Epoch: 26/50 | Batch: 200/782 | 单Batch损失: 0.6369 | 累计平均损失: 0.5312

Epoch: 26/50 | Batch: 300/782 | 单Batch损失: 0.3903 | 累计平均损失: 0.5211

Epoch: 26/50 | Batch: 400/782 | 单Batch损失: 0.4560 | 累计平均损失: 0.5179

Epoch: 26/50 | Batch: 500/782 | 单Batch损失: 0.3716 | 累计平均损失: 0.5237

Epoch: 26/50 | Batch: 600/782 | 单Batch损失: 0.4940 | 累计平均损失: 0.5226

Epoch: 26/50 | Batch: 700/782 | 单Batch损失: 0.5624 | 累计平均损失: 0.5259

Epoch 26/50 完成 | 训练准确率: 81.70% | 测试准确率: 82.83%

Epoch: 27/50 | Batch: 100/782 | 单Batch损失: 0.5966 | 累计平均损失: 0.5204

Epoch: 27/50 | Batch: 200/782 | 单Batch损失: 0.4850 | 累计平均损失: 0.5068

Epoch: 27/50 | Batch: 300/782 | 单Batch损失: 0.5526 | 累计平均损失: 0.5133

Epoch: 27/50 | Batch: 400/782 | 单Batch损失: 0.4366 | 累计平均损失: 0.5158

Epoch: 27/50 | Batch: 500/782 | 单Batch损失: 0.4077 | 累计平均损失: 0.5175

Epoch: 27/50 | Batch: 600/782 | 单Batch损失: 0.5512 | 累计平均损失: 0.5163

Epoch: 27/50 | Batch: 700/782 | 单Batch损失: 0.4778 | 累计平均损失: 0.5162

Epoch 27/50 完成 | 训练准确率: 81.96% | 测试准确率: 83.36%

Epoch: 28/50 | Batch: 100/782 | 单Batch损失: 0.4616 | 累计平均损失: 0.5081

Epoch: 28/50 | Batch: 200/782 | 单Batch损失: 0.6436 | 累计平均损失: 0.5113

Epoch: 28/50 | Batch: 300/782 | 单Batch损失: 0.4535 | 累计平均损失: 0.5094

Epoch: 28/50 | Batch: 400/782 | 单Batch损失: 0.6412 | 累计平均损失: 0.5094

Epoch: 28/50 | Batch: 500/782 | 单Batch损失: 0.4172 | 累计平均损失: 0.5070

Epoch: 28/50 | Batch: 600/782 | 单Batch损失: 0.5729 | 累计平均损失: 0.5084

Epoch: 28/50 | Batch: 700/782 | 单Batch损失: 0.7177 | 累计平均损失: 0.5097

Epoch 28/50 完成 | 训练准确率: 82.04% | 测试准确率: 82.38%

Epoch: 29/50 | Batch: 100/782 | 单Batch损失: 0.3307 | 累计平均损失: 0.4994

Epoch: 29/50 | Batch: 200/782 | 单Batch损失: 0.4438 | 累计平均损失: 0.5039

Epoch: 29/50 | Batch: 300/782 | 单Batch损失: 0.3884 | 累计平均损失: 0.5038

Epoch: 29/50 | Batch: 400/782 | 单Batch损失: 0.5149 | 累计平均损失: 0.5124

Epoch: 29/50 | Batch: 500/782 | 单Batch损失: 0.6244 | 累计平均损失: 0.5074

Epoch: 29/50 | Batch: 600/782 | 单Batch损失: 0.6589 | 累计平均损失: 0.5084

Epoch: 29/50 | Batch: 700/782 | 单Batch损失: 0.4801 | 累计平均损失: 0.5089

Epoch 29/50 完成 | 训练准确率: 82.02% | 测试准确率: 83.30%

Epoch: 30/50 | Batch: 100/782 | 单Batch损失: 0.3495 | 累计平均损失: 0.4854

Epoch: 30/50 | Batch: 200/782 | 单Batch损失: 0.5006 | 累计平均损失: 0.4877

Epoch: 30/50 | Batch: 300/782 | 单Batch损失: 0.4388 | 累计平均损失: 0.4916

Epoch: 30/50 | Batch: 400/782 | 单Batch损失: 0.5631 | 累计平均损失: 0.4933

Epoch: 30/50 | Batch: 500/782 | 单Batch损失: 0.4836 | 累计平均损失: 0.4984

Epoch: 30/50 | Batch: 600/782 | 单Batch损失: 0.3281 | 累计平均损失: 0.4989

Epoch: 30/50 | Batch: 700/782 | 单Batch损失: 0.5237 | 累计平均损失: 0.5017

Epoch 30/50 完成 | 训练准确率: 82.37% | 测试准确率: 83.80%

Epoch: 31/50 | Batch: 100/782 | 单Batch损失: 0.5479 | 累计平均损失: 0.4756

Epoch: 31/50 | Batch: 200/782 | 单Batch损失: 0.6272 | 累计平均损失: 0.4960

Epoch: 31/50 | Batch: 300/782 | 单Batch损失: 0.3122 | 累计平均损失: 0.4965

Epoch: 31/50 | Batch: 400/782 | 单Batch损失: 0.6559 | 累计平均损失: 0.4966

Epoch: 31/50 | Batch: 500/782 | 单Batch损失: 0.5954 | 累计平均损失: 0.4929

Epoch: 31/50 | Batch: 600/782 | 单Batch损失: 0.7424 | 累计平均损失: 0.4918

Epoch: 31/50 | Batch: 700/782 | 单Batch损失: 0.5575 | 累计平均损失: 0.4977

Epoch 31/50 完成 | 训练准确率: 82.32% | 测试准确率: 83.53%

Epoch: 32/50 | Batch: 100/782 | 单Batch损失: 0.4886 | 累计平均损失: 0.4607

Epoch: 32/50 | Batch: 200/782 | 单Batch损失: 0.3784 | 累计平均损失: 0.4728

Epoch: 32/50 | Batch: 300/782 | 单Batch损失: 0.5617 | 累计平均损失: 0.4766

Epoch: 32/50 | Batch: 400/782 | 单Batch损失: 0.3727 | 累计平均损失: 0.4832

Epoch: 32/50 | Batch: 500/782 | 单Batch损失: 0.3744 | 累计平均损失: 0.4829

Epoch: 32/50 | Batch: 600/782 | 单Batch损失: 0.3707 | 累计平均损失: 0.4861

Epoch: 32/50 | Batch: 700/782 | 单Batch损失: 0.3870 | 累计平均损失: 0.4860

Epoch 32/50 完成 | 训练准确率: 82.74% | 测试准确率: 83.50%

Epoch: 33/50 | Batch: 100/782 | 单Batch损失: 0.2945 | 累计平均损失: 0.4732

Epoch: 33/50 | Batch: 200/782 | 单Batch损失: 0.5217 | 累计平均损失: 0.4844

Epoch: 33/50 | Batch: 300/782 | 单Batch损失: 0.4208 | 累计平均损失: 0.4836

Epoch: 33/50 | Batch: 400/782 | 单Batch损失: 0.3817 | 累计平均损失: 0.4824

Epoch: 33/50 | Batch: 500/782 | 单Batch损失: 0.4112 | 累计平均损失: 0.4792

Epoch: 33/50 | Batch: 600/782 | 单Batch损失: 0.4080 | 累计平均损失: 0.4812

Epoch: 33/50 | Batch: 700/782 | 单Batch损失: 0.4099 | 累计平均损失: 0.4809

Epoch 33/50 完成 | 训练准确率: 83.18% | 测试准确率: 83.54%

Epoch: 34/50 | Batch: 100/782 | 单Batch损失: 0.4311 | 累计平均损失: 0.4742

Epoch: 34/50 | Batch: 200/782 | 单Batch损失: 0.4110 | 累计平均损失: 0.4714

Epoch: 34/50 | Batch: 300/782 | 单Batch损失: 0.4747 | 累计平均损失: 0.4745

Epoch: 34/50 | Batch: 400/782 | 单Batch损失: 0.4877 | 累计平均损失: 0.4792

Epoch: 34/50 | Batch: 500/782 | 单Batch损失: 0.4097 | 累计平均损失: 0.4755

Epoch: 34/50 | Batch: 600/782 | 单Batch损失: 0.7281 | 累计平均损失: 0.4755

Epoch: 34/50 | Batch: 700/782 | 单Batch损失: 0.4282 | 累计平均损失: 0.4757

Epoch 34/50 完成 | 训练准确率: 83.21% | 测试准确率: 83.77%

Epoch: 35/50 | Batch: 100/782 | 单Batch损失: 0.3286 | 累计平均损失: 0.4360

Epoch: 35/50 | Batch: 200/782 | 单Batch损失: 0.4929 | 累计平均损失: 0.4323

Epoch: 35/50 | Batch: 300/782 | 单Batch损失: 0.3762 | 累计平均损失: 0.4275

Epoch: 35/50 | Batch: 400/782 | 单Batch损失: 0.3616 | 累计平均损失: 0.4324

Epoch: 35/50 | Batch: 500/782 | 单Batch损失: 0.4876 | 累计平均损失: 0.4344

Epoch: 35/50 | Batch: 600/782 | 单Batch损失: 0.3452 | 累计平均损失: 0.4303

Epoch: 35/50 | Batch: 700/782 | 单Batch损失: 0.2800 | 累计平均损失: 0.4288

Epoch 35/50 完成 | 训练准确率: 84.92% | 测试准确率: 84.51%

Epoch: 36/50 | Batch: 100/782 | 单Batch损失: 0.4680 | 累计平均损失: 0.4293

Epoch: 36/50 | Batch: 200/782 | 单Batch损失: 0.5700 | 累计平均损失: 0.4212

Epoch: 36/50 | Batch: 300/782 | 单Batch损失: 0.4390 | 累计平均损失: 0.4204

Epoch: 36/50 | Batch: 400/782 | 单Batch损失: 0.5267 | 累计平均损失: 0.4197

Epoch: 36/50 | Batch: 500/782 | 单Batch损失: 0.3959 | 累计平均损失: 0.4207

Epoch: 36/50 | Batch: 600/782 | 单Batch损失: 0.3113 | 累计平均损失: 0.4203

Epoch: 36/50 | Batch: 700/782 | 单Batch损失: 0.3314 | 累计平均损失: 0.4214

Epoch 36/50 完成 | 训练准确率: 85.32% | 测试准确率: 84.78%

Epoch: 37/50 | Batch: 100/782 | 单Batch损失: 0.4593 | 累计平均损失: 0.4146

Epoch: 37/50 | Batch: 200/782 | 单Batch损失: 0.5526 | 累计平均损失: 0.4161

Epoch: 37/50 | Batch: 300/782 | 单Batch损失: 0.4811 | 累计平均损失: 0.4187

Epoch: 37/50 | Batch: 400/782 | 单Batch损失: 0.3941 | 累计平均损失: 0.4172

Epoch: 37/50 | Batch: 500/782 | 单Batch损失: 0.4344 | 累计平均损失: 0.4152

Epoch: 37/50 | Batch: 600/782 | 单Batch损失: 0.5488 | 累计平均损失: 0.4134

Epoch: 37/50 | Batch: 700/782 | 单Batch损失: 0.3947 | 累计平均损失: 0.4128

Epoch 37/50 完成 | 训练准确率: 85.47% | 测试准确率: 85.61%

Epoch: 38/50 | Batch: 100/782 | 单Batch损失: 0.2697 | 累计平均损失: 0.3975

Epoch: 38/50 | Batch: 200/782 | 单Batch损失: 0.3262 | 累计平均损失: 0.3966

Epoch: 38/50 | Batch: 300/782 | 单Batch损失: 0.4658 | 累计平均损失: 0.4038

Epoch: 38/50 | Batch: 400/782 | 单Batch损失: 0.5184 | 累计平均损失: 0.4054

Epoch: 38/50 | Batch: 500/782 | 单Batch损失: 0.4482 | 累计平均损失: 0.4047

Epoch: 38/50 | Batch: 600/782 | 单Batch损失: 0.5497 | 累计平均损失: 0.4031

Epoch: 38/50 | Batch: 700/782 | 单Batch损失: 0.4320 | 累计平均损失: 0.4064

Epoch 38/50 完成 | 训练准确率: 85.69% | 测试准确率: 84.76%

Epoch: 39/50 | Batch: 100/782 | 单Batch损失: 0.4279 | 累计平均损失: 0.4081

Epoch: 39/50 | Batch: 200/782 | 单Batch损失: 0.4513 | 累计平均损失: 0.3995

Epoch: 39/50 | Batch: 300/782 | 单Batch损失: 0.3423 | 累计平均损失: 0.4055

Epoch: 39/50 | Batch: 400/782 | 单Batch损失: 0.4963 | 累计平均损失: 0.4015

Epoch: 39/50 | Batch: 500/782 | 单Batch损失: 0.3098 | 累计平均损失: 0.4034

Epoch: 39/50 | Batch: 600/782 | 单Batch损失: 0.3668 | 累计平均损失: 0.4039

Epoch: 39/50 | Batch: 700/782 | 单Batch损失: 0.4422 | 累计平均损失: 0.4057

Epoch 39/50 完成 | 训练准确率: 85.60% | 测试准确率: 85.38%

Epoch: 40/50 | Batch: 100/782 | 单Batch损失: 0.3657 | 累计平均损失: 0.3879

Epoch: 40/50 | Batch: 200/782 | 单Batch损失: 0.4267 | 累计平均损失: 0.3892

Epoch: 40/50 | Batch: 300/782 | 单Batch损失: 0.5641 | 累计平均损失: 0.3889

Epoch: 40/50 | Batch: 400/782 | 单Batch损失: 0.2898 | 累计平均损失: 0.3903

Epoch: 40/50 | Batch: 500/782 | 单Batch损失: 0.4153 | 累计平均损失: 0.3906

Epoch: 40/50 | Batch: 600/782 | 单Batch损失: 0.4488 | 累计平均损失: 0.3950

Epoch: 40/50 | Batch: 700/782 | 单Batch损失: 0.3801 | 累计平均损失: 0.3975

Epoch 40/50 完成 | 训练准确率: 86.04% | 测试准确率: 85.02%

Epoch: 41/50 | Batch: 100/782 | 单Batch损失: 0.3915 | 累计平均损失: 0.4067

Epoch: 41/50 | Batch: 200/782 | 单Batch损失: 0.2563 | 累计平均损失: 0.3886

Epoch: 41/50 | Batch: 300/782 | 单Batch损失: 0.5302 | 累计平均损失: 0.3866

Epoch: 41/50 | Batch: 400/782 | 单Batch损失: 0.4611 | 累计平均损失: 0.3909

Epoch: 41/50 | Batch: 500/782 | 单Batch损失: 0.3508 | 累计平均损失: 0.3875

Epoch: 41/50 | Batch: 600/782 | 单Batch损失: 0.5400 | 累计平均损失: 0.3878

Epoch: 41/50 | Batch: 700/782 | 单Batch损失: 0.5500 | 累计平均损失: 0.3903

Epoch 41/50 完成 | 训练准确率: 86.14% | 测试准确率: 84.89%

Epoch: 42/50 | Batch: 100/782 | 单Batch损失: 0.4661 | 累计平均损失: 0.3924

Epoch: 42/50 | Batch: 200/782 | 单Batch损失: 0.6080 | 累计平均损失: 0.3919

Epoch: 42/50 | Batch: 300/782 | 单Batch损失: 0.4949 | 累计平均损失: 0.3922

Epoch: 42/50 | Batch: 400/782 | 单Batch损失: 0.2592 | 累计平均损失: 0.3908

Epoch: 42/50 | Batch: 500/782 | 单Batch损失: 0.4580 | 累计平均损失: 0.3893

Epoch: 42/50 | Batch: 600/782 | 单Batch损失: 0.4937 | 累计平均损失: 0.3917

Epoch: 42/50 | Batch: 700/782 | 单Batch损失: 0.3789 | 累计平均损失: 0.3921

Epoch 42/50 完成 | 训练准确率: 86.00% | 测试准确率: 84.80%

Epoch: 43/50 | Batch: 100/782 | 单Batch损失: 0.5154 | 累计平均损失: 0.3723

Epoch: 43/50 | Batch: 200/782 | 单Batch损失: 0.1457 | 累计平均损失: 0.3755

Epoch: 43/50 | Batch: 300/782 | 单Batch损失: 0.6064 | 累计平均损失: 0.3785

Epoch: 43/50 | Batch: 400/782 | 单Batch损失: 0.3559 | 累计平均损失: 0.3803

Epoch: 43/50 | Batch: 500/782 | 单Batch损失: 0.2650 | 累计平均损失: 0.3808

Epoch: 43/50 | Batch: 600/782 | 单Batch损失: 0.4246 | 累计平均损失: 0.3837

Epoch: 43/50 | Batch: 700/782 | 单Batch损失: 0.6159 | 累计平均损失: 0.3826

Epoch 43/50 完成 | 训练准确率: 86.57% | 测试准确率: 84.80%

Epoch: 44/50 | Batch: 100/782 | 单Batch损失: 0.3769 | 累计平均损失: 0.3547

Epoch: 44/50 | Batch: 200/782 | 单Batch损失: 0.2535 | 累计平均损失: 0.3590

Epoch: 44/50 | Batch: 300/782 | 单Batch损失: 0.3264 | 累计平均损失: 0.3602

Epoch: 44/50 | Batch: 400/782 | 单Batch损失: 0.4237 | 累计平均损失: 0.3610

Epoch: 44/50 | Batch: 500/782 | 单Batch损失: 0.3469 | 累计平均损失: 0.3632

Epoch: 44/50 | Batch: 600/782 | 单Batch损失: 0.2249 | 累计平均损失: 0.3644

Epoch: 44/50 | Batch: 700/782 | 单Batch损失: 0.2896 | 累计平均损失: 0.3650

Epoch 44/50 完成 | 训练准确率: 87.16% | 测试准确率: 85.56%

Epoch: 45/50 | Batch: 100/782 | 单Batch损失: 0.4033 | 累计平均损失: 0.3474

Epoch: 45/50 | Batch: 200/782 | 单Batch损失: 0.3802 | 累计平均损失: 0.3482

Epoch: 45/50 | Batch: 300/782 | 单Batch损失: 0.3963 | 累计平均损失: 0.3419

Epoch: 45/50 | Batch: 400/782 | 单Batch损失: 0.4769 | 累计平均损失: 0.3499

Epoch: 45/50 | Batch: 500/782 | 单Batch损失: 0.1733 | 累计平均损失: 0.3510

Epoch: 45/50 | Batch: 600/782 | 单Batch损失: 0.4369 | 累计平均损失: 0.3486

Epoch: 45/50 | Batch: 700/782 | 单Batch损失: 0.3665 | 累计平均损失: 0.3510

Epoch 45/50 完成 | 训练准确率: 87.50% | 测试准确率: 85.40%

Epoch: 46/50 | Batch: 100/782 | 单Batch损失: 0.2379 | 累计平均损失: 0.3568

Epoch: 46/50 | Batch: 200/782 | 单Batch损失: 0.5482 | 累计平均损失: 0.3484

Epoch: 46/50 | Batch: 300/782 | 单Batch损失: 0.4037 | 累计平均损失: 0.3515

Epoch: 46/50 | Batch: 400/782 | 单Batch损失: 0.4300 | 累计平均损失: 0.3531

Epoch: 46/50 | Batch: 500/782 | 单Batch损失: 0.3944 | 累计平均损失: 0.3531

Epoch: 46/50 | Batch: 600/782 | 单Batch损失: 0.2426 | 累计平均损失: 0.3552

Epoch: 46/50 | Batch: 700/782 | 单Batch损失: 0.2979 | 累计平均损失: 0.3543

Epoch 46/50 完成 | 训练准确率: 87.45% | 测试准确率: 86.02%

Epoch: 47/50 | Batch: 100/782 | 单Batch损失: 0.3793 | 累计平均损失: 0.3436

Epoch: 47/50 | Batch: 200/782 | 单Batch损失: 0.3787 | 累计平均损失: 0.3530

Epoch: 47/50 | Batch: 300/782 | 单Batch损失: 0.5298 | 累计平均损失: 0.3537

Epoch: 47/50 | Batch: 400/782 | 单Batch损失: 0.4792 | 累计平均损失: 0.3552

Epoch: 47/50 | Batch: 500/782 | 单Batch损失: 0.4041 | 累计平均损失: 0.3572

Epoch: 47/50 | Batch: 600/782 | 单Batch损失: 0.3475 | 累计平均损失: 0.3522

Epoch: 47/50 | Batch: 700/782 | 单Batch损失: 0.4549 | 累计平均损失: 0.3510

Epoch 47/50 完成 | 训练准确率: 87.54% | 测试准确率: 85.71%

Epoch: 48/50 | Batch: 100/782 | 单Batch损失: 0.4600 | 累计平均损失: 0.3388

Epoch: 48/50 | Batch: 200/782 | 单Batch损失: 0.5518 | 累计平均损失: 0.3452

Epoch: 48/50 | Batch: 300/782 | 单Batch损失: 0.2917 | 累计平均损失: 0.3358

Epoch: 48/50 | Batch: 400/782 | 单Batch损失: 0.3100 | 累计平均损失: 0.3423

Epoch: 48/50 | Batch: 500/782 | 单Batch损失: 0.7021 | 累计平均损失: 0.3475

Epoch: 48/50 | Batch: 600/782 | 单Batch损失: 0.2287 | 累计平均损失: 0.3485

Epoch: 48/50 | Batch: 700/782 | 单Batch损失: 0.5825 | 累计平均损失: 0.3478

Epoch 48/50 完成 | 训练准确率: 87.67% | 测试准确率: 85.89%

Epoch: 49/50 | Batch: 100/782 | 单Batch损失: 0.3823 | 累计平均损失: 0.3368

Epoch: 49/50 | Batch: 200/782 | 单Batch损失: 0.3382 | 累计平均损失: 0.3429

Epoch: 49/50 | Batch: 300/782 | 单Batch损失: 0.2413 | 累计平均损失: 0.3414

Epoch: 49/50 | Batch: 400/782 | 单Batch损失: 0.5054 | 累计平均损失: 0.3423

Epoch: 49/50 | Batch: 500/782 | 单Batch损失: 0.3529 | 累计平均损失: 0.3427

Epoch: 49/50 | Batch: 600/782 | 单Batch损失: 0.4574 | 累计平均损失: 0.3423

Epoch: 49/50 | Batch: 700/782 | 单Batch损失: 0.4026 | 累计平均损失: 0.3440

Epoch 49/50 完成 | 训练准确率: 87.70% | 测试准确率: 85.80%

Epoch: 50/50 | Batch: 100/782 | 单Batch损失: 0.3368 | 累计平均损失: 0.3451

Epoch: 50/50 | Batch: 200/782 | 单Batch损失: 0.5310 | 累计平均损失: 0.3492

Epoch: 50/50 | Batch: 300/782 | 单Batch损失: 0.3280 | 累计平均损失: 0.3482

Epoch: 50/50 | Batch: 400/782 | 单Batch损失: 0.3337 | 累计平均损失: 0.3498

Epoch: 50/50 | Batch: 500/782 | 单Batch损失: 0.5709 | 累计平均损失: 0.3485

Epoch: 50/50 | Batch: 600/782 | 单Batch损失: 0.3742 | 累计平均损失: 0.3505

Epoch: 50/50 | Batch: 700/782 | 单Batch损失: 0.3078 | 累计平均损失: 0.3508

Epoch 50/50 完成 | 训练准确率: 87.68% | 测试准确率: 85.98%

训练完成!最终测试准确率: 85.98%

@浙大疏锦行