什么是人工智能(AI)?大学想学AI,该如何入手?

什么是人工智能(AI)?

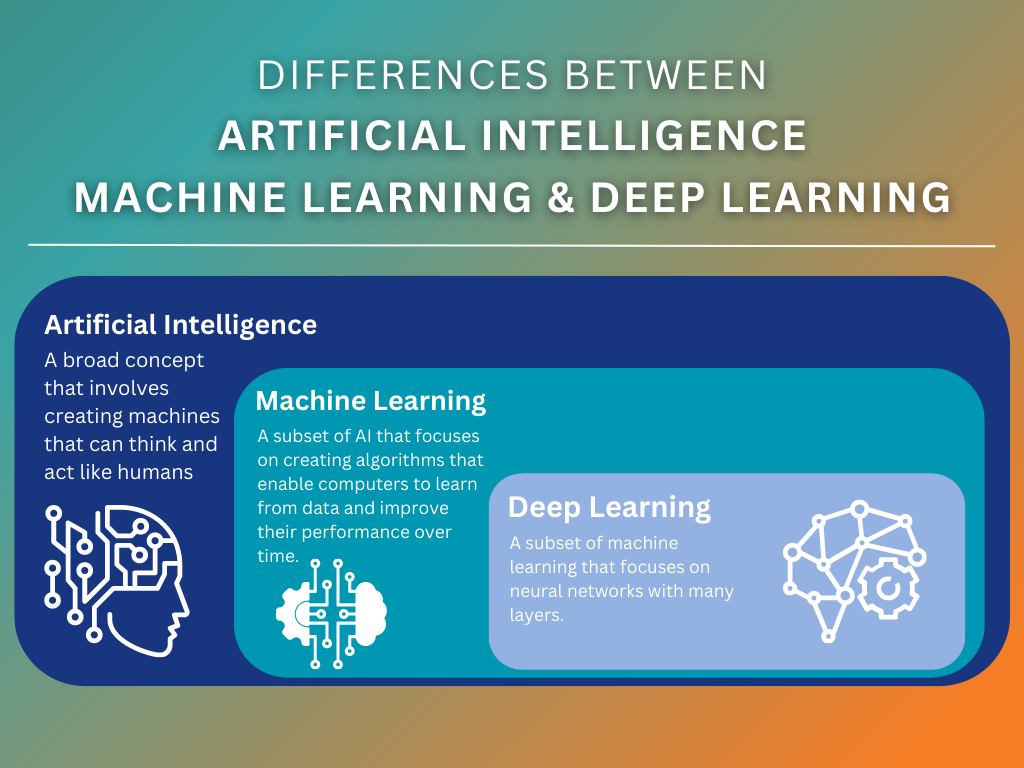

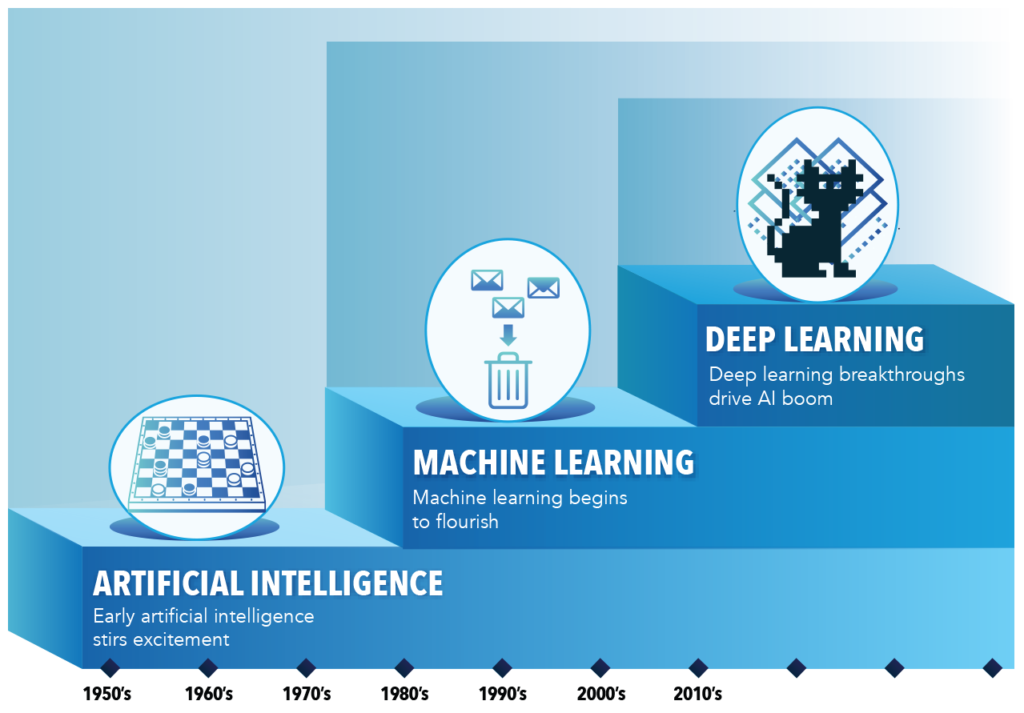

人工智能(Artificial Intelligence, AI)是计算机科学的一个分支,核心目标是让机器具备类似人类的智能能力,例如感知(看、听、理解)、推理(逻辑判断、决策)、学习(从数据中总结规律)和交互(自然语言对话、情感识别)等。

AI的范围很广,根据能力层级可分为:

- 弱人工智能(Narrow AI):专注单一任务(如语音助手Siri、图像识别软件、推荐算法),目前所有实际应用的AI都属于此类。

- 强人工智能(General AI):具备通用智能(如人类的学习、推理、创造能力),目前仍处于理论探索阶段。

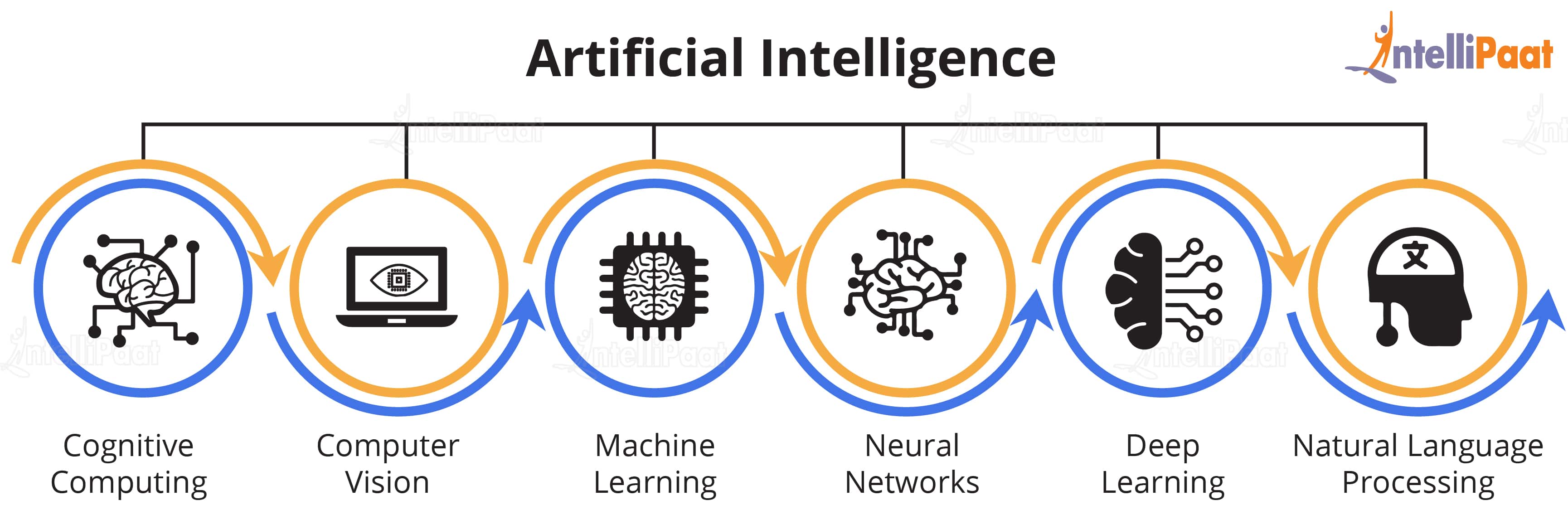

AI的关键技术包括:

- 机器学习(Machine Learning, ML):让机器从数据中自动学习规律(如分类、回归)。

- 深度学习(Deep Learning, DL):基于多层神经网络(如CNN、Transformer)的机器学习方法,擅长处理图像、语音、文本等非结构化数据。

- 自然语言处理(NLP):让机器理解、生成人类语言(如聊天机器人、机器翻译)。

- 计算机视觉(CV):让机器“看懂”图像/视频(如人脸识别、自动驾驶视觉感知)。

大学想学AI,该如何入手?

大学学习AI需要系统性规划,兼顾理论基础、编程能力和实践项目。以下是分阶段的具体建议:

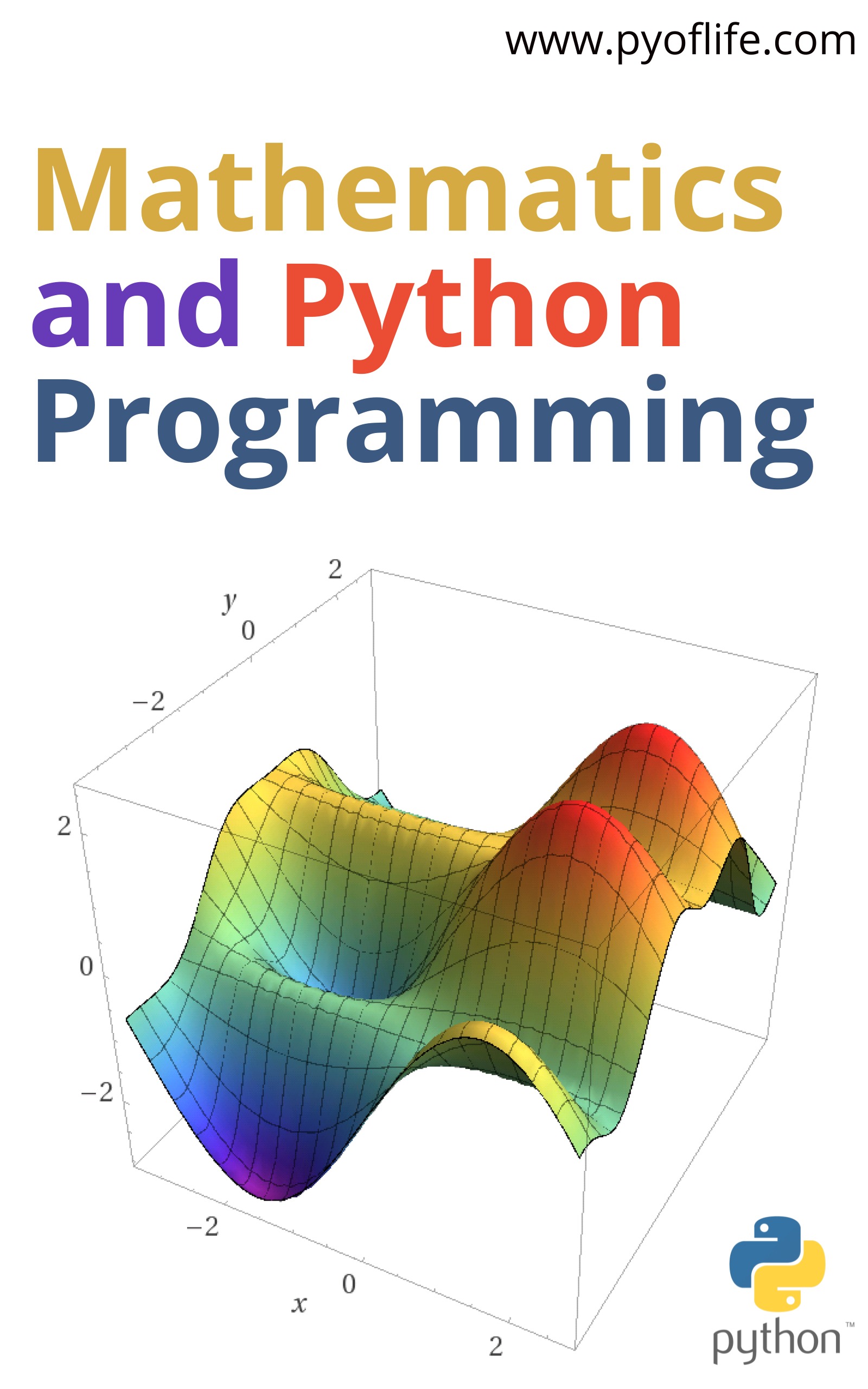

一、打牢基础:数学与编程(大一至大二)

AI的核心是“用数学建模+代码实现解决实际问题”,因此数学和编程是一切的基础。

1. 数学:重点突破4大核心方向

-

线性代数(最重要!):矩阵运算(如神经网络的权重矩阵)、向量空间(特征表示)、特征值/特征向量(降维、PCA)。

推荐学习:《线性代数及其应用》(David Lay)、B站“3Blue1Brown”(直观理解矩阵、向量空间)。 -

概率论与数理统计:概率分布(如高斯分布)、期望/方差(模型不确定性)、贝叶斯定理(朴素贝叶斯分类器)、假设检验(模型效果验证)。

推荐学习:《概率论与数理统计》(浙江大学)、Coursera《概率论》(杜克大学)。 -

微积分:导数(梯度下降优化算法)、偏导数(反向传播求参数)、积分(概率密度函数)。

重点:掌握多元函数的微分和积分,理解“梯度”的物理意义。 -

最优化理论:损失函数(如MSE、交叉熵)、优化算法(梯度下降、Adam)、正则化(防止过拟合)。

推荐阅读:《凸优化》(Boyd)(了解基础即可,AI中常用凸优化问题)。

2. 编程:Python是AI的“通用语言”

- 基础语法:掌握变量、循环、函数、类与对象等,推荐《Python编程:从入门到实践》。

- 核心库:

- NumPy(矩阵运算,AI的“计算器”);

- Pandas(数据清洗与预处理,处理表格数据);

- Matplotlib/Seaborn(可视化,观察数据分布和模型效果);

- Scikit-learn(传统机器学习算法,如SVM、随机森林,适合入门练手)。

- 进阶工具:

- PyTorch/TensorFlow(深度学习框架,工业界主流);

- Jupyter Notebook(交互式编程,方便实验)。

二、入门AI核心:机器学习与深度学习(大二至大三)

掌握基础后,需系统学习AI的核心技术:机器学习和深度学习。

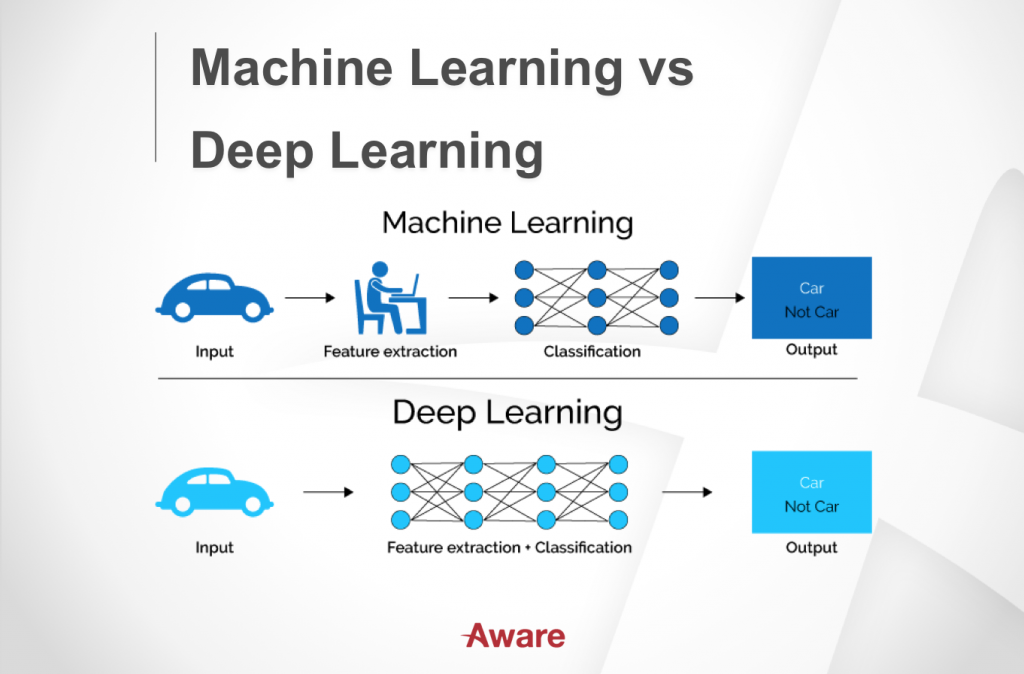

1. 机器学习(ML):理解“如何让机器从数据中学习”

- 核心概念:监督学习(分类、回归)、无监督学习(聚类、降维)、半监督学习、强化学习(如AlphaGo)。

- 经典算法:线性回归、逻辑回归、决策树、随机森林、SVM、K-means、PCA等。

- 关键步骤:数据预处理(清洗、标准化)、模型训练(调参、交叉验证)、模型评估(准确率、F1分数、ROC曲线)。

- 推荐资源:

- 书籍:《机器学习》(周志华,“西瓜书”,理论+案例);《Hands-On Machine Learning with Scikit-Learn, Keras, and TensorFlow》(实战性强,英文原版或中文译本)。

- 课程:吴恩达《Machine Learning》(Coursera,经典入门,含数学推导和编程作业);李宏毅《机器学习》(B站,通俗易懂,结合前沿)。

2. 深度学习(DL):掌握“神经网络的魔法”

- 基础网络结构:

- 全连接层(FC)、卷积神经网络(CNN,图像领域)、循环神经网络(RNN/LSTM,序列数据如文本)、Transformer(大语言模型如GPT的核心)。

- 关键技术:反向传播(梯度下降优化)、正则化(Dropout、BatchNorm)、过拟合解决(数据增强、早停法)、迁移学习(用预训练模型微调)。

- 实战框架:优先学PyTorch(代码更简洁,适合研究)或TensorFlow(工业界部署方便)。

- 推荐资源:

- 书籍:《深度学习》(花书,理论基石);《Deep Learning with PyTorch》(官方教程,实战性强)。

- 课程:李宏毅《深度学习》(B站,从基础到前沿,含GPT等内容);Fast.ai(实战导向,快速上手项目)。

三、实践为王:从项目到竞赛(贯穿大学全程)

AI是应用导向的学科,理论学习必须结合实践,否则无法真正掌握。

1. 入门项目(大二):用简单数据练手

- 任务示例:

- 分类:用Scikit-learn的鸢尾花数据集训练逻辑回归/SVM;

- 回归:用波士顿房价数据集(或Kaggle的房价预测)训练线性回归;

- 图像:用MNIST手写数字数据集训练CNN(PyTorch/TensorFlow实现);

- 文本:用IMDB影评数据集做情感分类(TF-IDF或简单RNN)。

2. 进阶项目(大三):解决真实场景问题

- 数据来源:Kaggle(全球最大数据竞赛平台,如泰坦尼克号生存预测、图像分割)、UCI数据集(经典小数据集)、企业公开数据集(如Google Dataset Search)。

- 任务方向:

- 计算机视觉:目标检测(YOLO)、图像分割(U-Net)、风格迁移;

- 自然语言处理:文本生成(LSTM写诗)、命名实体识别(BERT微调)、对话系统(简单Chatbot);

- 多模态:图像描述(用CNN+RNN生成图片文字)、视频理解(行为识别)。

3. 竞赛与开源(大三至大四):提升竞争力

- 竞赛:Kaggle竞赛(如Titanic、House Prices)、阿里天池(国内平台)、ACM-ICPC(侧重算法,但AI相关赛题增多)。

- 开源贡献:参与GitHub上的AI项目(如贡献模型代码、修复Bug),或自己上传项目(写清晰的README,展示技术栈)。

四、长期学习:跟踪前沿与拓展视野

AI技术迭代极快(如从CNN到Transformer仅用几年),需保持学习热情:

- 关注顶会与论文:NeurIPS(机器学习)、ICML(机器学习)、CVPR(计算机视觉)、ACL(自然语言处理)。可通过arXiv(预印本平台)或“机器之心”“机器学习研究组订阅号”等公众号获取最新论文。

- 参与学术交流:参加高校讲座、行业峰会(如世界人工智能大会WAIC),或加入AI社区(知乎、CSDN、Reddit的r/MachineLearning)。

- 拓展技能:

- 数学:拓扑学(流形学习)、信息论(互信息、KL散度);

- 工程:分布式训练(多GPU/TPU加速)、模型部署(TensorRT、ONNX);

- 交叉领域:AI+医疗(医学影像分析)、AI+金融(量化交易)、AI+机器人(强化学习控制)。

总结:学习路径建议

- 大一:打牢数学(线性代数、概率论)和Python基础。

- 大二:系统学习机器学习(周志华+吴恩达课程),完成简单项目(如鸢尾花分类)。

- 大三:深入深度学习(花书+李宏毅课程),参与Kaggle竞赛或企业数据集项目(如图像分割)。

- 大四:聚焦方向(CV/NLP/强化学习等),做毕业设计(如基于Transformer的文本生成),准备实习/读研。

关键提醒:AI学习没有捷径,数学和编程是“地基”,项目和实践是“钢筋”,持续跟踪前沿是“装修”。保持耐心,逐步积累,你会在这个充满创新的领域找到自己的方向!