论文阅读:ICLR 2024 GAIA: A Benchmark for General AI Assistants

https://arxiv.org/pdf/2311.12983

https://www.doubao.com/chat/18484357054754562

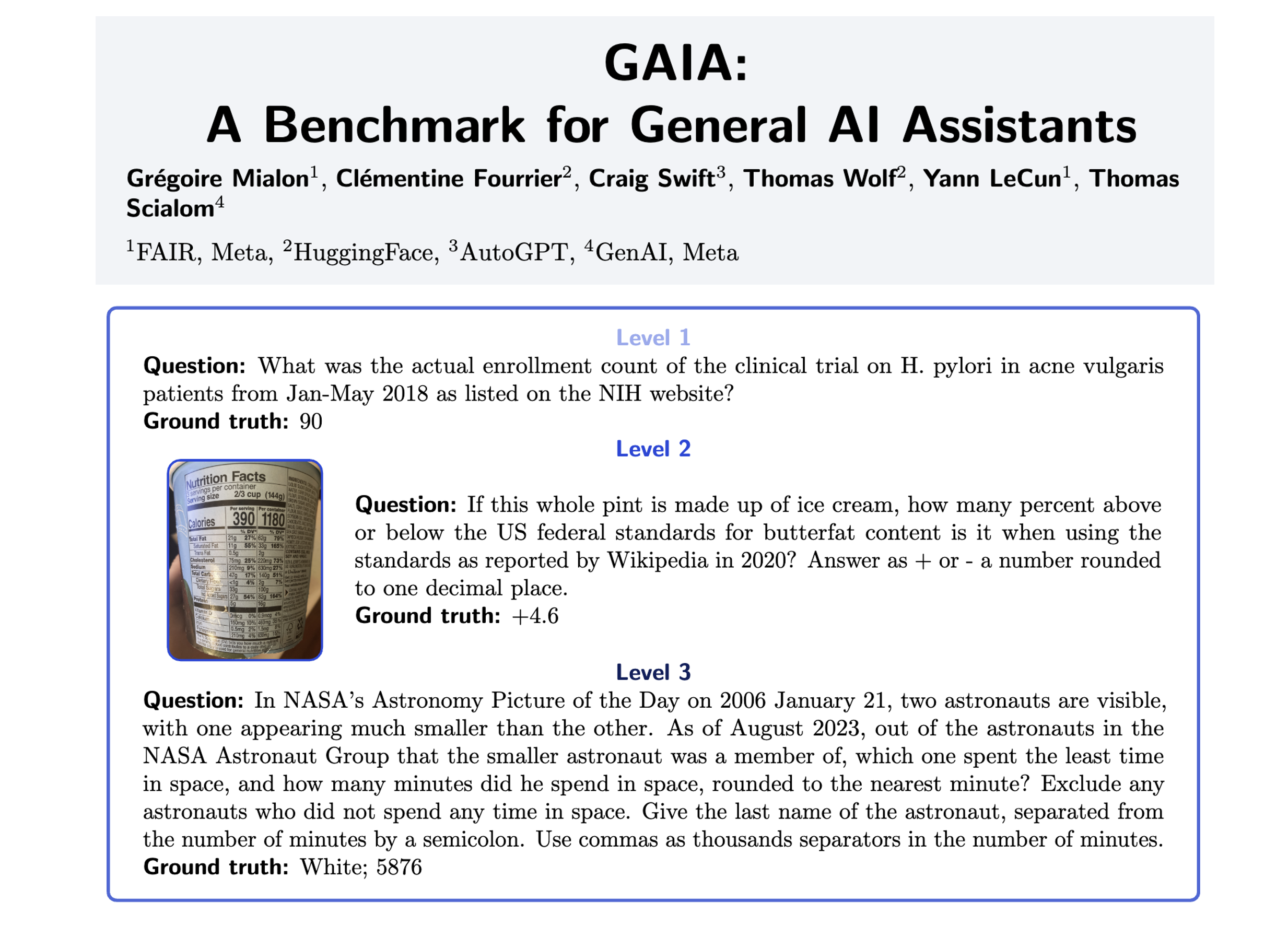

GAIA: A Benchmark for General AI Assistants

GAIA:通用人工智能助手基准测试

该论文介绍了GAIA(General AI Assistants)基准测试,这是一个旨在评估通用人工智能助手能力的新基准,发表于ICLR 2024。GAIA通过提出一系列现实世界中的问题,要求助手具备推理、多模态处理、网页浏览和工具使用等基础能力。这些问题对人类来说概念上简单,但对当前最先进的AI系统来说却极具挑战性。研究者们通过对比人类和AI系统在这些问题上的表现,揭示了AI系统在解决实际问题时的不足。

GAIA基准测试包含466个精心设计的问题,这些问题覆盖了多种实际应用场景,如日常任务、科学问题和一般知识。每个问题都设计为有一个明确且唯一的答案,便于自动评估。实验结果显示,即使是性能最好的AI系统,如GPT-4,其成功率也仅为15%,而人类的回答成功率则高达92%。这一显著差异表明,尽管AI系统在某些专业领域表现出色,但在处理这类现实世界问题时仍存在明显缺陷。

GAIA的设计理念强调了基准测试应关注AI系统在实际应用中的表现,而非仅仅追求解决对人类来说越来越困难的任务。该基准测试的目的是推动AI研究向更接近人类智能的方向发展,即在多样化的现实场景中表现出与人类相似的稳健性和适应性。通过GAIA,研究者们希望能够更好地评估和推动AI系统的发展,使其更加接近通用人工智能(AGI)的目标。

此外,GAIA还提供了一个开放的框架,允许社区成员根据提供的指导原则扩展和改进基准测试。研究者们希望GAIA能够成为评估AI系统能力的一个重要工具,并为未来AI系统的发展提供方向。