在VMware虚拟机集群中,完成Hive的安装部署

Hive是分布式运行的框架还是单机运行的?

Hive是单机工具,只需要部署在一台服务器即可。

Hive虽然是单机的,但是它可以提交分布式运行的MapReduce程序运行。

我们知道Hive是单机工具后,就需要准备一台服务器供Hive使用即可。

同时Hive需要使用元数据服务,即需要提供一个关系型数据库,我们也选择一台服务器安装关系型数据库即可。

所以:

| 服务 | 机器 |

| Hive本体 | 部署在node1 |

| 元数据服务所需的关系型数据库(课程选择最为流行的MySQL) | 部署在node1 |

为了简单起见,都安装到node1服务器上。

一、安装MySQL数据库

我们在node1节点使用yum在线安装MySQL5.7版本。

CentOS 7 已于 2024 年 6 月 30 日结束生命周期,官方镜像源(mirrorlist.centos.org)已关闭,因此无法解析域名。

解决方案

1、备份现有 Yum 配置:

sudo mv /etc/yum.repos.d/CentOS-Base.repo /etc/yum.repos.d/CentOS-Base.repo.backup2、创建新的 Yum 配置文件:

sudo nano /etc/yum.repos.d/CentOS-Base.repo3、将以下内容复制到文件中(使用阿里云镜像源):

[base]

name=CentOS-$releasever - Base - mirrors.aliyun.com

failovermethod=priority

baseurl=https://mirrors.aliyun.com/centos/$releasever/os/$basearch/

gpgcheck=1

gpgkey=https://mirrors.aliyun.com/centos/RPM-GPG-KEY-CentOS-7#released updates

[updates]

name=CentOS-$releasever - Updates - mirrors.aliyun.com

failovermethod=priority

baseurl=https://mirrors.aliyun.com/centos/$releasever/updates/$basearch/

gpgcheck=1

gpgkey=https://mirrors.aliyun.com/centos/RPM-GPG-KEY-CentOS-7#additional packages that may be useful

[extras]

name=CentOS-$releasever - Extras - mirrors.aliyun.com

failovermethod=priority

baseurl=https://mirrors.aliyun.com/centos/$releasever/extras/$basearch/

gpgcheck=1

gpgkey=https://mirrors.aliyun.com/centos/RPM-GPG-KEY-CentOS-7#additional packages that extend functionality of existing packages

[centosplus]

name=CentOS-$releasever - Plus - mirrors.aliyun.com

failovermethod=priority

baseurl=https://mirrors.aliyun.com/centos/$releasever/centosplus/$basearch/

gpgcheck=1

enabled=0

gpgkey=https://mirrors.aliyun.com/centos/RPM-GPG-KEY-CentOS-74、清理 Yum 缓存并重新生成:

sudo yum clean all

sudo yum makecache5、更新系统:

sudo yum update接下来就可以执行如下指令进行下载安装mysql了

# 更新密钥

rpm --import https://repo.mysql.com/RPM-GPG-KEY-mysql-2022# 安装Mysql yum库

rpm -Uvh http://repo.mysql.com//mysql57-community-release-el7-7.noarch.rpm# yum安装Mysql

yum -y install mysql-community-server# 启动Mysql设置开机启动

systemctl start mysqld

systemctl enable mysqld# 检查Mysql服务状态

systemctl status mysqld# 第一次启动mysql,会在日志文件中生成root用户的一个随机密码,使用下面命令查看该密码

grep 'temporary password' /var/log/mysqld.log# 修改root用户密码

mysql -u root -p -h localhost

Enter password:mysql> ALTER USER 'root'@'localhost' IDENTIFIED BY 'Root!@#$';# 如果你想设置简单密码,需要降低Mysql的密码安全级别

set global validate_password_policy=LOW; # 密码安全级别低

set global validate_password_length=4; # 密码长度最低4位即可# 然后就可以用简单密码了(课程中使用简单密码,为了方便,生产中不要这样)

ALTER USER 'root'@'localhost' IDENTIFIED BY 'root';/usr/bin/mysqladmin -u root password 'root'grant all privileges on *.* to root@"%" identified by 'root' with grant option;

flush privileges;二、配置Hadoop

Hive的运行依赖于Hadoop(HDFS、MapReduce、YARN都依赖)

同时涉及到HDFS文件系统的访问,所以需要配置Hadoop的代理用户

即设置hadoop用户允许代理(模拟)其它用户

配置如下内容在Hadoop的core-site.xml文件中,并分发到其它节点,且重启HDFS集群

# 编辑

vim core-site.xml# 修改core-site.xml文件

<property><name>hadoop.proxyuser.hadoop.hosts</name><value>*</value>

</property>

<property><name>hadoop.proxyuser.hadoop.groups</name><value>*</value>

</property>三、下载解压Hive

切换到hadoop用户

su - hadoop下载Hive安装包路径:

http://archive.apache.org/dist/hive/hive-3.1.3/apache-hive-3.1.3-bin.tar.gz

或者从网盘资料中获取安装包:链接: https://pan.baidu.com/s/1vTQWQLmZ8JHUqs5Us5FcFQ?pwd=zgzs 提取码: zgzs

解压到node1服务器的:/export/server/内

tar -zxvf apache-hive-3.1.3-bin.tar.gz -C /export/server/设置软连接

ln -s /export/server/apache-hive-3.1.3-bin /export/server/hive四、提供MySQL Driver包

下载MySQL驱动包:

https://repo1.maven.org/maven2/mysql/mysql-connector-java/5.1.34/mysql-connector-java-5.1.34.jar

或者从上述网盘资料中获取安装包

将下载好的驱动jar包,放入:Hive安装文件夹的lib目录内

mv mysql-connector-java-5.1.34.jar /export/server/hive/lib/五、配置Hive

在Hive的conf目录内,新建hive-env.sh文件

# 在Hive的conf目录内,新建hive-env.sh文件

vim hive-env.sh# 填入以下环境变量内容

export HADOOP_HOME=/export/server/hadoop

export HIVE_CONF_DIR=/export/server/hive/conf

export HIVE_AUX_JARS_PATH=/export/server/hive/lib

在Hive的conf目录内,新建hive-site.xml文件

# 在Hive的conf目录内,新建hive-site.xml文件

vim hive-site.xml# 填入以下内容

<configuration><property><name>javax.jdo.option.ConnectionURL</name><value>jdbc:mysql://node1:3306/hive?createDatabaseIfNotExist=true&useSSL=false&useUnicode=true&characterEncoding=UTF-8</value></property><property><name>javax.jdo.option.ConnectionDriverName</name><value>com.mysql.jdbc.Driver</value></property><property><name>javax.jdo.option.ConnectionUserName</name><value>root</value></property><property><name>javax.jdo.option.ConnectionPassword</name><value>123456</value></property><property><name>hive.server2.thrift.bind.host</name><value>node1</value></property><property><name>hive.metastore.uris</name><value>thrift://node1:9083</value></property><property><name>hive.metastore.event.db.notification.api.auth</name><value>false</value></property>

</configuration>

六、初始化元数据库

至此,Hive的配置已经完成,现在在启动Hive前,需要先初始化Hive所需的元数据库。

在MySQL中新建数据库:hive

CREATE DATABASE hive CHARSET UTF8;执行元数据库初始化命令:

cd /export/server/hivebin/schematool -initSchema -dbType mysql -verbos# 初始化成功后,会在MySQL的hive库中新建74张元数据管理的表。

七、启动Hive(使用Hadoop用户)

确保Hive文件夹所属为hadoop用户

创建一个hive的日志文件夹:

mkdir /export/server/hive/logs启动元数据管理服务(必须启动,否则无法工作)

前台启动:

bin/hive --service metastore 或者后台启动:

nohup bin/hive --service metastore >> logs/metastore.log 2>&1 &启动客户端,二选一

Hive Shell方式(可以直接写SQL):

bin/hiveHive ThriftServer方式(不可直接写SQL,需要外部客户端链接使用):

bin/hive --service hiveserver2

八、补充:HiveServer2服务

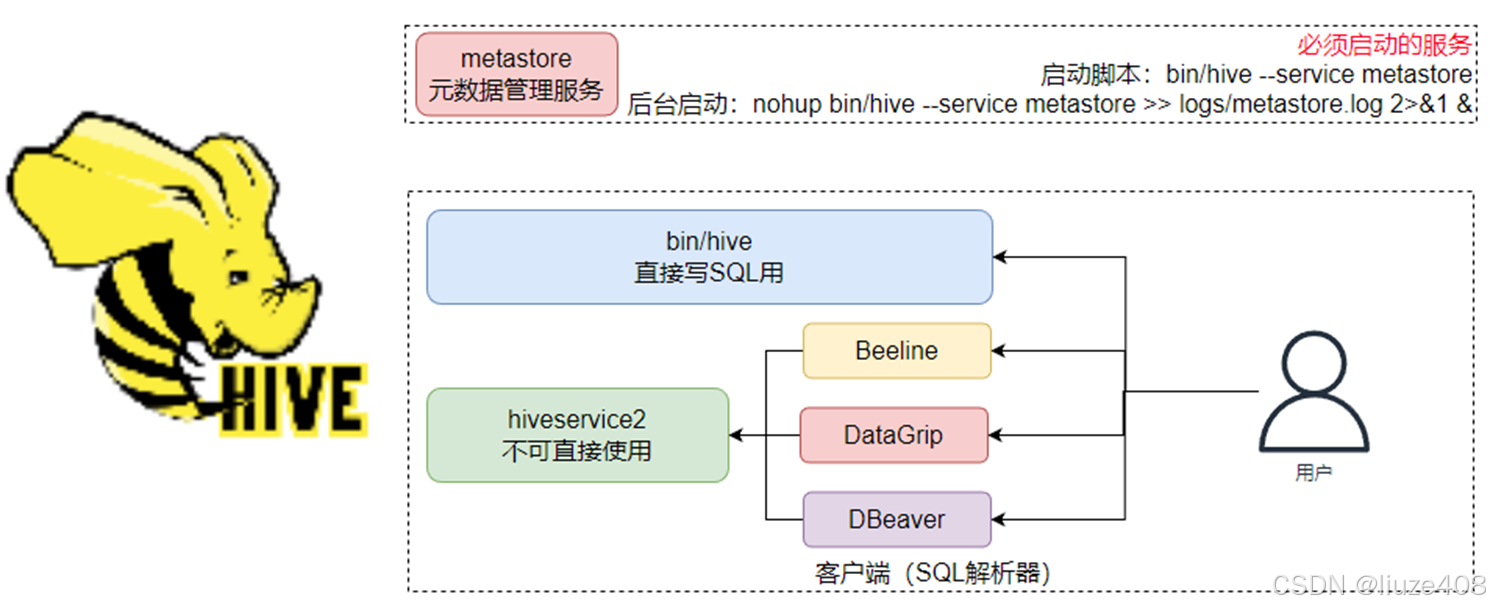

在启动Hive的时候,除了必备的Metastore服务外,我们前面提过有2种方式使用Hive:

方式1: bin/hive 即Hive的Shell客户端,可以直接写SQL

方式2: bin/hive --service hiveserver2

后台执行脚本:

nohup bin/hive --service hiveserver2 >> logs/hiveserver2.log 2>&1 &bin/hive --service metastore,启动的是元数据管理服务

bin/hive --service hiveserver2,启动的是HiveServer2服务

HiveServer2是Hive内置的一个ThriftServer服务,提供Thrift端口供其它客户端链接

可以连接ThriftServer的客户端有:

Hive内置的 beeline客户端工具(命令行工具)

第三方的图形化SQL工具,如DataGrip、DBeaver、Navicat等

Hive的客户端体系如下

启动

在hive安装的服务器上,首先启动metastore服务,然后启动hiveserver2服务。

#先启动metastore服务 然后启动hiveserver2服务

nohup bin/hive --service metastore >> logs/metastore.log 2>&1 &

nohup bin/hive --service hiveserver2 >> logs/hiveserver2.log 2>&1 &

beeline

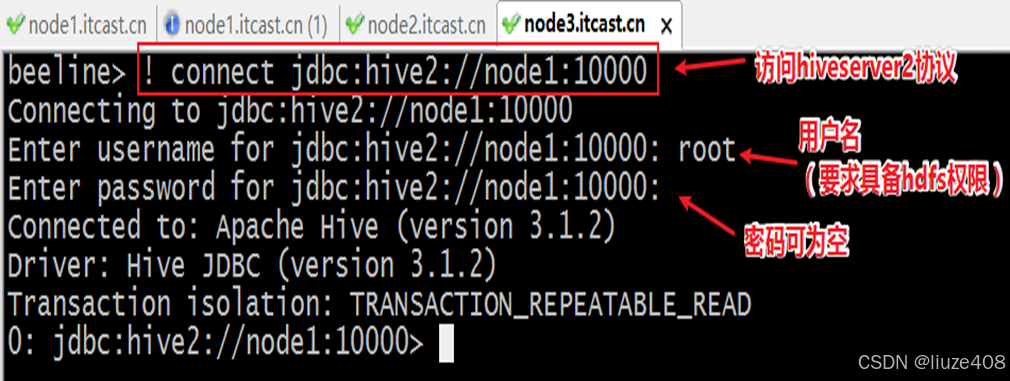

在node1上使用beeline客户端进行连接访问。需要注意hiveserver2服务启动之后需要稍等一会才可以对外提供服务。

Beeline是JDBC的客户端,通过JDBC协议和Hiveserver2服务进行通信,协议的地址是:jdbc:hive2://node1:10000

[root@node1 ~]# /export/server/hive/bin/beeline

Beeline version 3.1.2 by Apache Hive

beeline> ! connect jdbc:hive2://node1:10000

Connecting to jdbc:hive2://node1:10000

Enter username for jdbc:hive2://node1:10000: root

Enter password for jdbc:hive2://node1:10000:

Connected to: Apache Hive (version 3.1.2)

Driver: Hive JDBC (version 3.1.2)

Transaction isolation: TRANSACTION_REPEATABLE_READ

0: jdbc:hive2://node1:10000>

后续可以在beeline中进行数据库相关操作了。