【LLM】DeepSeek-V3.1-Think模型相关细节

note

- 特点:

- 混合推理架构:一个模型同时支持思考模式与非思考模式;更高的思考效率:相比 DeepSeek-R1-0528,DeepSeek-V3.1-Think 能在更短时间内给出答案;更强的 Agent 能力:通过 Post-Training 优化,新模型在工具使用与智能体任务中的表现有较大提升。

- 增加了对 Anthropic API 格式的支持,让大家可以轻松将 DeepSeek-V3.1 的能力接入 Claude Code 框架。(详见官方文档:https://api-docs.deepseek.com/zh-cn/guides/anthropic_api)

- 通过Qwen3-2507将推理和非推理分开来看,混合推理还是存在一些问题的。

- 相关paper,The Impact of Language Mixing on Bilingual LLM Reasoning,结论是语言混杂可以增强推理能力。

文章目录

- note

- 一、DeepSeek-V3.1-Think模型

- Reference

一、DeepSeek-V3.1-Think模型

DeepSeek发布V3.1模型,采用混合推理架构同时支持思考与非思考模式,相比 DeepSeek-R1-0528,DeepSeek-V3.1-Think 能在更短时间内给出答案;。特点是采用UE8M0 FP8 Scale参数精度,API同步升级对Anthropic API格式的支持,上下文扩展至128K。在编程智能体测评SWE和搜索智能体测评上性能提升。

官方blog:https://mp.weixin.qq.com/s/WUbmBSapVyvxZe6HobD5Qw,

Base 模型:Hugging Face:https://huggingface.co/deepseek-ai/DeepSeek-V3.1-Base,

魔搭:https://modelscope.cn/models/deepseek-ai/DeepSeek-V3.1-Base,

后训练模型:Hugging Face: https://huggingface.co/deepseek-ai/DeepSeek-V3.1,

魔搭:https://modelscope.cn/models/deepseek-ai/DeepSeek-V3.1

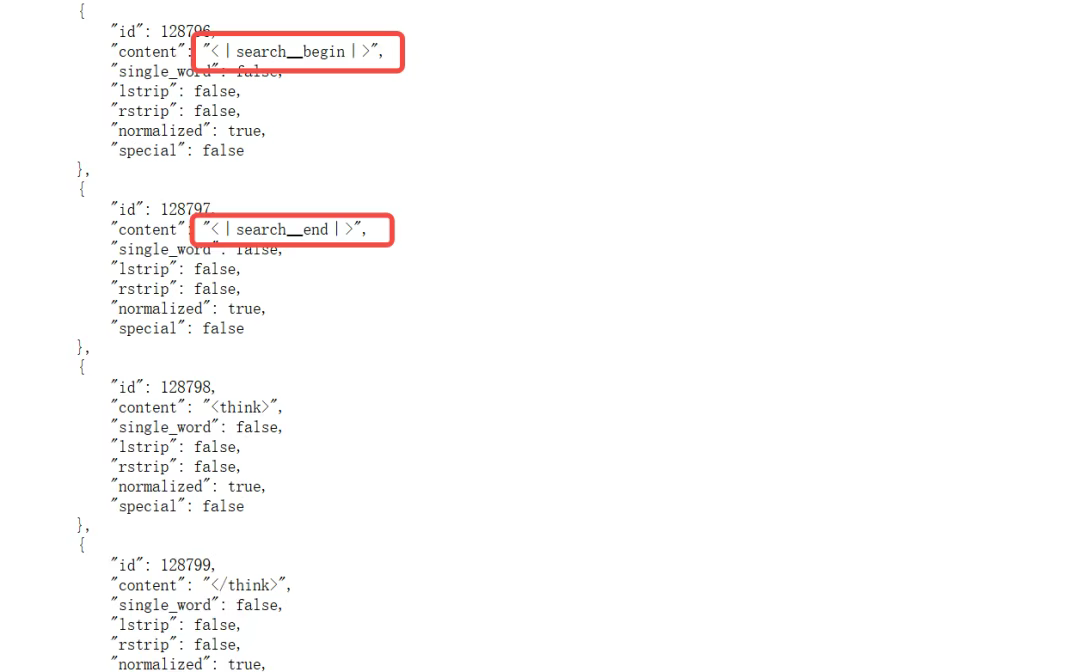

除了混合推理之外,V3.1的special token还多了search标记。

加入search标记,应该是让模型在联网搜索时,不是一次性检索,而是可以边思考边检索,就是豆包的变向边搜一样。在生成的内容的过程中,会触发搜索机制,从外部获取更多的信息,以便于更好地回答。不过,目前在客户端,并没有体现,联网搜索,依然是一次性搜索,不知道是不是还在适配,还是说后面会推出新的功能。

除了search标记,tool use部分也做了更新,变得更加简洁,<|tool call begin|> + 函数名 + <|tool sep|> + 参数字符串 + <|tool call end|>,参数直接作为字符串传递。所以在tool部分,v3.1应该也是专门训练过,不过具体如何还需要自行测试。

Reference

[1] DeepSeek-V3.1 发布,迈向 Agent 时代的第一步

[2] DeepSeek V3.1细节