【人工智能】推荐开源企业级OCR大模型InternVL3

推荐开源企业级OCR大模型InternVL3

文章参考来源:

https://huggingface.co/OpenGVLab/InternVL3-14B-Instruct

https://www.aivi.fyi/llms/deploy-InternVL3

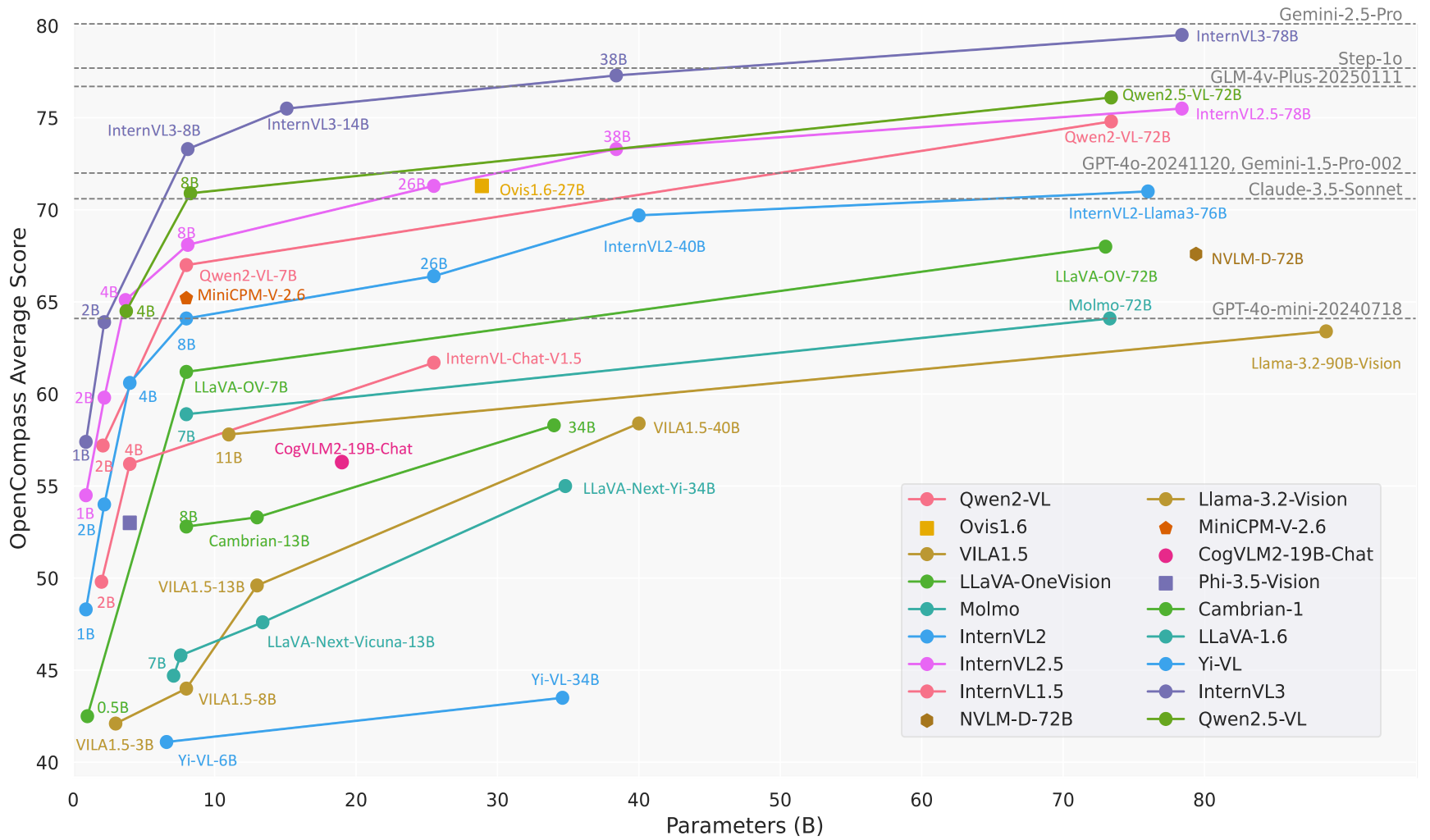

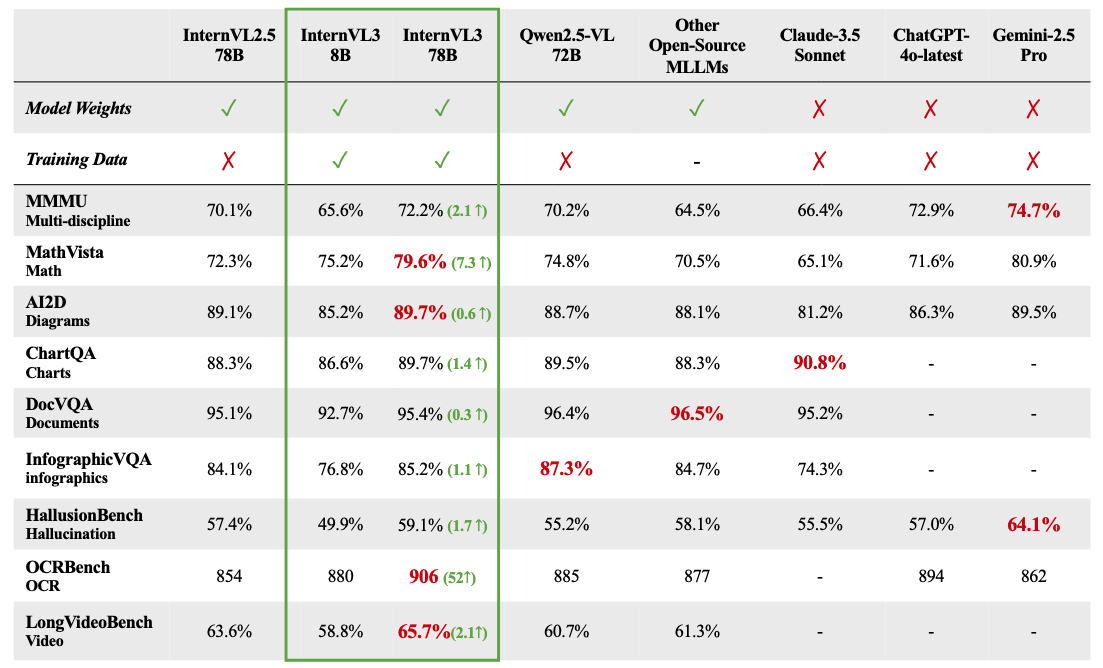

InternVL3,这是一个高级多模态大型语言模型 (MLLM) 系列,展示了卓越的整体性能。与 InternVL 2.5 相比,InternVL3 表现出卓越的多模态感知和推理能力,同时进一步扩展了其多模态功能,包括工具使用、GUI 代理、工业图像分析、3D 视觉感知等。此外,我们将 InternVL3 与 Qwen2.5 Chat 模型进行了比较,其相应的预训练基础模型被用作 InternVL3 中语言组件的初始化。得益于原生多模态预训练,InternVL3 系列的整体文本性能甚至优于 Qwen2.5 系列。

广泛的应用场景

与前代InternVL 2.5相比,InternVL3不仅在多模态感知和推理能力方面表现更佳,还将其多模态能力进一步扩展到工具使用、GUI代理、工业图像分析、3D视觉感知等领域。

这使得InternVL3在实际应用中具有更广泛的价值,从基础图像理解到复杂的跨模态推理任务,都能表现出色。

要有效运行 InternVL3-14B-Instruct 模型,建议的显卡配置如下:

显卡要求

-

显存: 具有至少 32 GB 显存的显卡是理想的选择。对于更高效的推理或训练,64 GB 显存会更好。

-

GPU 型号:

- NVIDIA A100

- NVIDIA V100

- NVIDIA RTX 3090 / 4090

- NVIDIA Titan RTX

-

CUDA 版本: 确保安装支持的 CUDA 版本(例如,CUDA 11.0 或更高)。

-

驱动程序: 更新到最新的 NVIDIA 驱动程序,以确保最佳兼容性和性能。

其他配置要求

- CPU: 多核处理器(如 AMD Ryzen 7 或 Intel i7 及以上)有助于加快数据处理速度。

- 内存: 至少 64 GB 系统内存,以处理数据加载和模型推理。

- 存储: SSD 存储可以提高数据读取速度,建议至少 1 TB 的空间。

确保以上配置能够为你提供良好的使用体验,无论是进行模型训练还是推理。