液态神经网络:智能制造的新引擎

导语

过去十年,智能制造的核心动力一直来自深度学习。从卷积神经网络(CNN)到长短时记忆网络(LSTM),再到近几年大火的 Transformer,这些模型的确推动了工业 AI 的落地。但问题是:工厂车间的环境和互联网不一样,它充满了实时数据流、频繁波动和各种噪声。在这种背景下,传统 AI 模型往往力不从心:要么反应太慢,要么算力消耗过大,要么对数据质量要求过高。

液态神经网络(Liquid Neural Network,简称 LNN)的出现,为这个难题打开了新思路。它就像给神经网络装上了“液态大脑”:能根据输入信号实时调整自己的“时间节奏”,在复杂和不确定的环境里依旧保持稳定和高效。

这篇文章会带你走一遍:

为什么传统 AI 模型不够用?

LNN 到底是什么?背后数学逻辑如何?

LNN 在智能制造里能做哪些事?(控制、管理、供应链)

现实中有哪些挑战?

未来研究的方向和可能的突破。

如果说 CNN/LSTM/Transformer 是工厂里的“老前辈”,那么 LNN 就像新上岗的“聪明学徒”,它虽然还年轻,但有潜力成为未来生产系统的核心大脑。

一、深度学习在制造业的瓶颈

当我们谈智能制造的时候,脑海里常常会浮现这样一幅画面:生产线上的传感器源源不断地产生数据,机器手臂精确执行操作,后台算法实时监控和调度。看上去,制造业似乎就是一个天然的数据乐园,AI 模型只要一上,就能大显身手。

但事实并非如此。传统深度学习模型在互联网场景里确实表现出色,可一旦走进工厂,它们就会暴露出一系列短板。

1. CNN:看得见,却“听不懂时间”

卷积神经网络(CNN)是图像识别的明星,擅长从二维空间里提取模式。它们可以帮工厂识别零件缺陷、检测表面裂纹,这没问题。

但制造过程是一个“时间的故事”。温度曲线的微小波动、振动信号的节奏变化、产线节拍的细微调整,这些都不是一张静态图片能捕捉到的。CNN 在时间维度上几乎是“耳聋”的——它看得见空间形态,却听不懂数据的节奏。

2. LSTM:能理解时间,但“体力差”

于是人们转向长短时记忆网络(LSTM)。它像一个带记忆力的工人,可以把过去的数据片段存下来,再用来推断现在的情况。这在工业场景里非常重要:比如预测机器轴承什么时候会出故障,需要依赖长时间的历史数据。

问题是,LSTM 记忆力虽然强,但学习起来代价不小:

训练耗时:要喂大量数据,调参复杂;

长依赖难题:记得住几十步,但几千步就容易“忘”或“乱”;

对噪声敏感:工厂里传感器数据难免抖动,LSTM 很容易被干扰。

换句话说,LSTM 就像一个体力一般的工人:能干活,但一旦加班加点,效率就明显下滑。

3. Transformer:大脑聪明,但“饭量惊人”

Transformer 则是另一个极端。它擅长“全局思考”,能在长序列中建立远距离的联系。比如预测一个月的产量波动,它比 LSTM 更胜一筹。

可惜,Transformer 的计算复杂度是 O(n²)。这意味着:

在处理超长时间序列时,它的计算和显存消耗非常大;

工厂车间的边缘设备根本跑不动它;

即便用高性能服务器,也会带来延迟,难以满足实时要求。

你可以把 Transformer 想象成一个超级聪明的顾问,脑子很快,但每次开口都要耗费巨额咨询费。对于成本敏感的制造业,这显然是个问题。

4. 工业场景的额外挑战

除了模型本身的缺陷,制造业还有一些“场地规则”,让深度学习更难落地:

实时性要求高:决策必须在毫秒级完成,容不得拖延;

数据不稳定:传感器会出错、环境会干扰,数据质量参差不齐;

设备多样化:不同厂区、不同年代的机器,接口和协议各不相同;

安全与可解释性:制造业讲究安全可靠,算法不能像黑盒一样说不清。

因此,即使 CNN/LSTM/Transformer 在实验室里表现再好,到了工厂也常常遇到“水土不服”。

👉 也正因为这些瓶颈,人们开始寻找新的模型架构。而液态神经网络(LNN)的出现,正是为了回应这些工业痛点。

二、液态神经网络的秘密武器

在上一节我们看到,CNN、LSTM 和 Transformer 都有“短板”:不是时间意识差,就是能耗太高,或者太难落地。那么,液态神经网络(Liquid Neural Network,简称 LNN)凭什么被认为是制造业的新希望?

一句话:它像“液体”一样,能够随环境流动,动态调整自己。

1. 为什么叫“液态”?

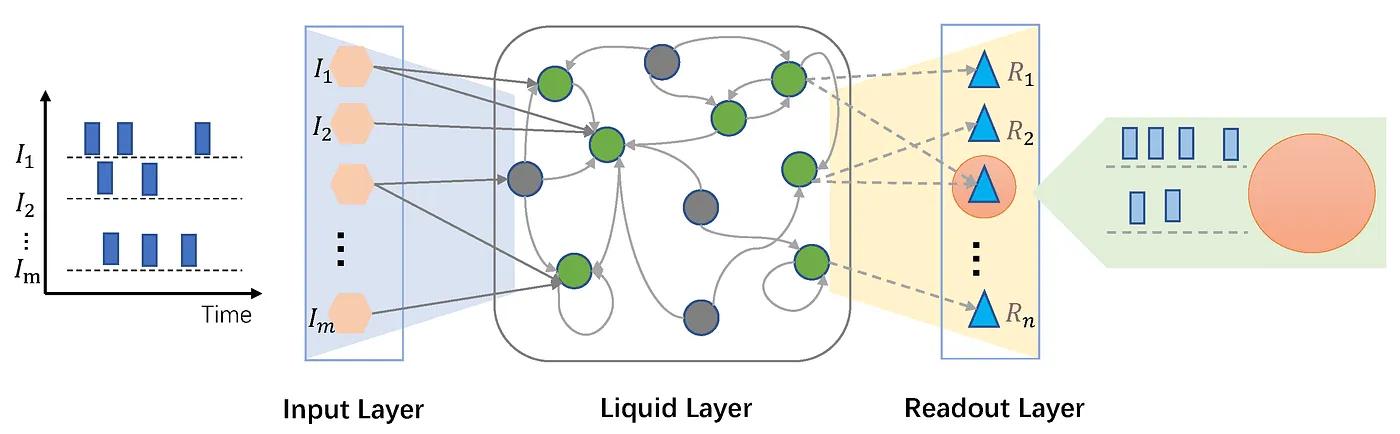

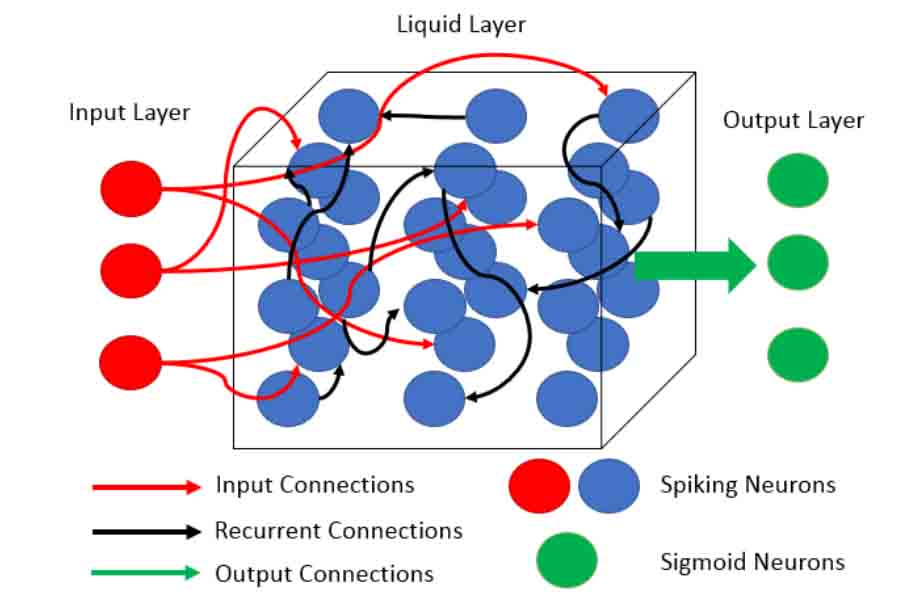

想象一下,你往水里丢一块石头,水面会立刻泛起涟漪,随后逐渐恢复平静。液态神经网络的工作方式很像这样:输入信号一旦进入,网络内部的“时间常数”就会发生改变,从而让它以不同的速度去吸收、遗忘和调整。

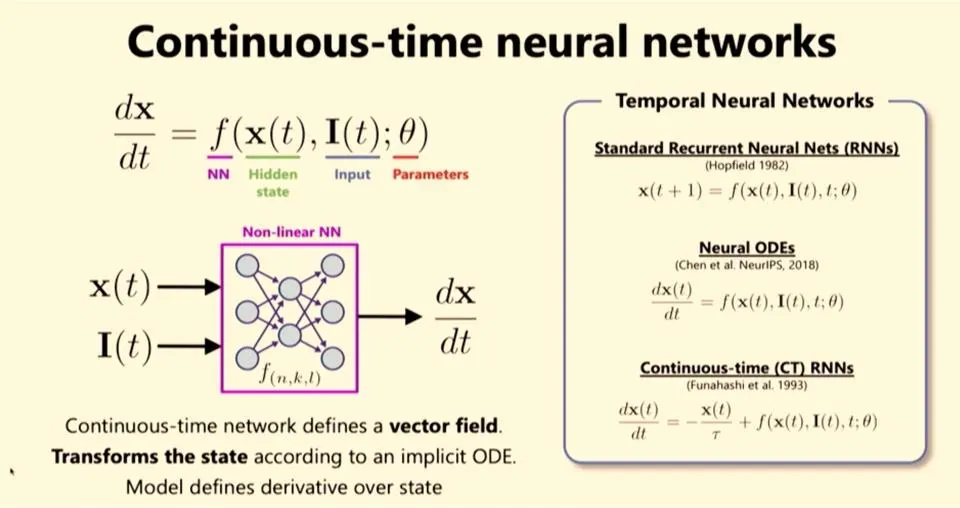

这和传统网络有什么不同?

RNN/LSTM 的时间节奏是“固定的”,就像钟表一样,嘀嗒嘀嗒按部就班;

LNN 的时间节奏是“可变的”,会根据输入自动快进或放慢。

因此,当面对工厂里的突发波动(比如机器突然发热、震动增加),LNN 会比 LSTM 更灵活,像液体一样快速流动并调整。

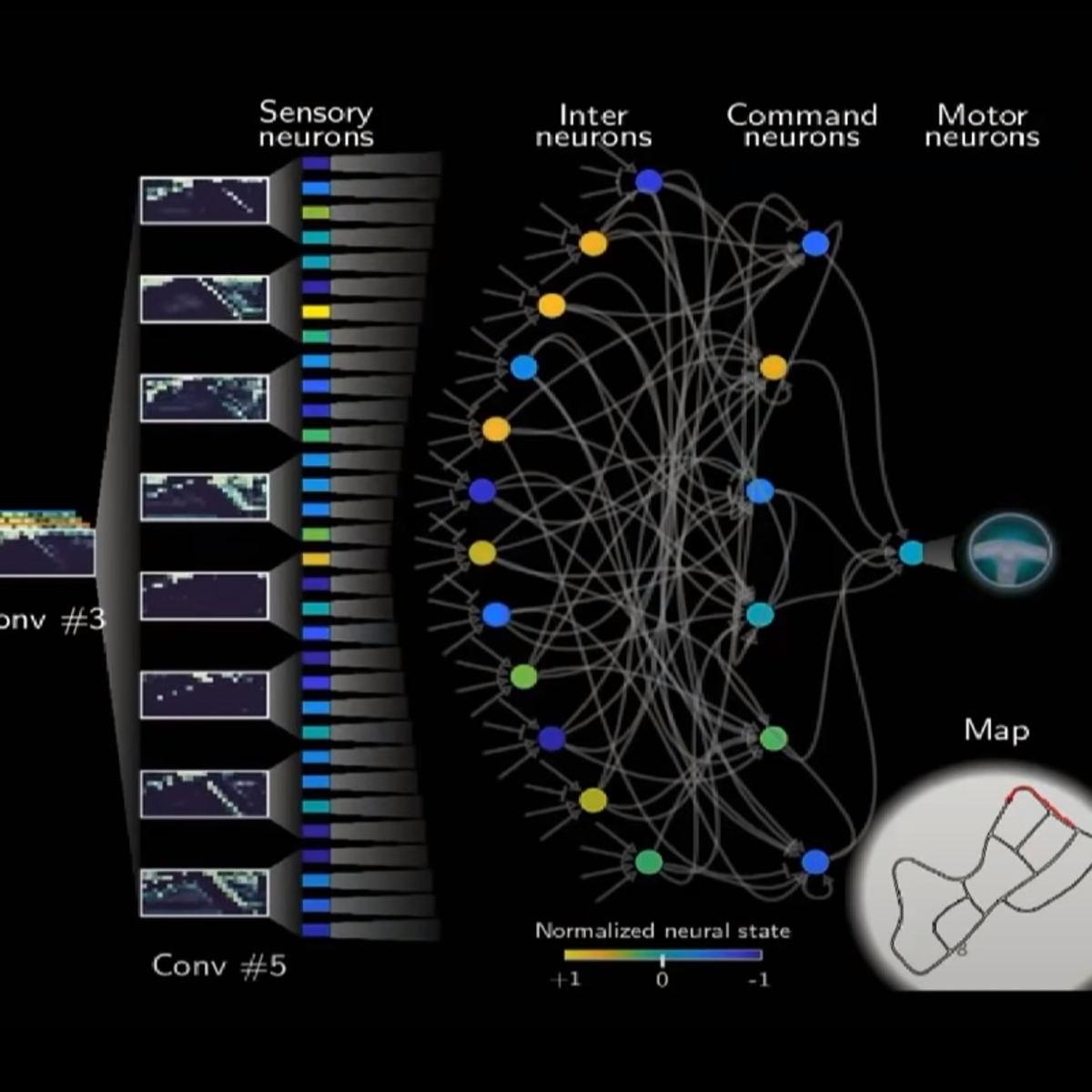

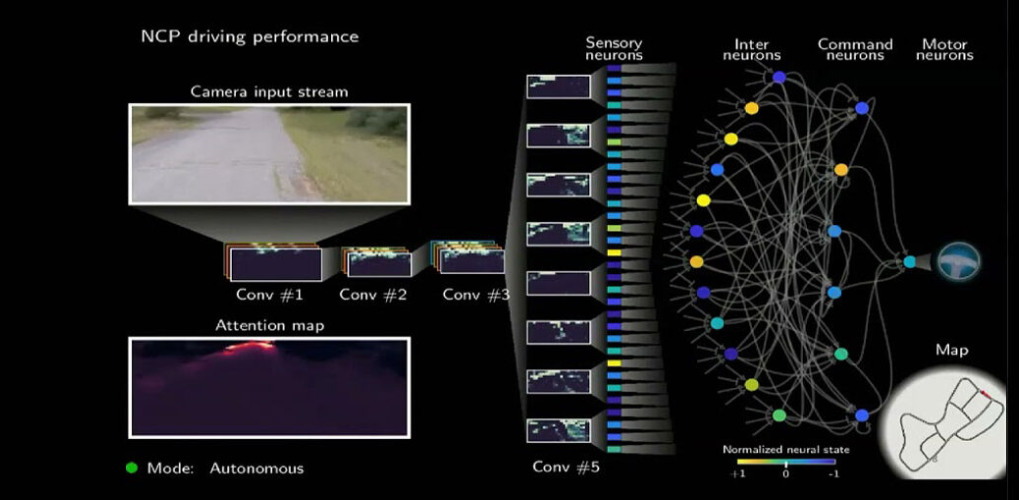

2. 背后的数学魔法

别担心,这里不会给你一大堆公式,只挑最核心的一点。

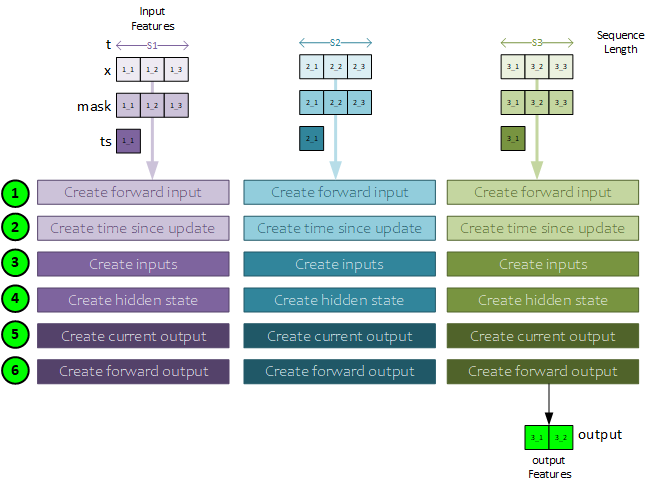

LNN 的隐藏状态变化,可以用下面的微分方程表示:

:网络的内部状态(可以理解为它的“记忆”)

:时间常数,会随输入 I(t)I(t) 动态调整

:非线性函数,相当于大脑里的“突触”反应

:可学习参数

区别就在于:传统 RNN 的 是固定的,而 LNN 的

是动态的。

这就像一个人,遇到紧急情况会立刻高度警觉( 很小,快速反应),而在稳定状态下则会放慢节奏(

较大,节能持久)。

3. 它的秘密武器在哪里?

短期 + 长期记忆平衡

LSTM 总是在短期和长期依赖之间左右为难。LNN 能动态切换记忆节奏,更加自然。高效计算

某些 LNN(比如 CfC)有闭式解,不必依赖复杂的数值求解器,所以比 Neural ODE 更省算力。

抗噪性

工厂里的传感器信号嘈杂,LNN 在结构上更鲁棒,能从乱糟糟的数据里提取有用的模式。因果建模

传统深度学习模型大多是“相关性黑盒”,而 LNN 通过时间常数的动态变化,可以更自然地学习因果关系。

4. 和“前辈们”的对比

| 特点 | CNN | LSTM | Transformer | LNN |

|---|---|---|---|---|

| 时间建模 | 弱 | 中 | 强 | 强且自适应 |

| 计算效率 | 高 | 中等 | 较低 | 较高(部分模型闭式解) |

| 噪声鲁棒性 | 较弱 | 中等 | 中等 | 高 |

| 边缘部署 | 容易 | 较难 | 较难 | 相对容易 |

| 因果推理 | 基本没有 | 较弱 | 一般 | 较强 |

从表里可以看到,LNN 并不是要“替代” CNN/LSTM/Transformer,而是补上了它们在制造业里最要命的短板:实时性、能效和因果性。

👉 所以,如果说 CNN 是工厂里的“显微镜”、LSTM 是“日记本”、Transformer 是“超级顾问”,那么 LNN 更像是一个灵活的操作员:它不仅能记住过去,还能根据当前情况灵活反应。

三、应用场景全景图

液态神经网络(LNN)并不是停留在理论层面的“实验室宠儿”,它在智能制造的多个环节都能找到用武之地。从车间里的实时控制,到生产管理,再到企业层面的供应链和物流规划,LNN 的灵活性都能派上用场。下面我们分三个层级来看看它的应用前景。

1. 制造过程控制:像“第六感”一样的实时反应

在生产线上,哪怕是一个小小的温度波动,都可能导致良品率下降。传统控制系统往往依赖固定逻辑规则,遇到突发情况容易“僵住”。

LNN 的优势在这里显露无遗:

设备调参:通过分析传感器实时数据(如温度、压力、振动),LNN 能动态调整参数,就像经验丰富的技师随时“拧一下螺丝”。

预测性维护:LNN 能捕捉到轴承振动中的细微异常,在机器真正损坏前“提醒”你。这种提前预警能省下大笔停机损失。

边缘计算:LNN 可以直接部署在靠近设备的传感器或控制器里,不必依赖云端。这意味着它能在毫秒级做出决策,避免延迟。

👉 想象一下,一台注塑机的温度传感器检测到加热异常。传统控制系统可能要等后台分析结果,而 LNN 则能立刻调整加热功率,防止原料浪费。

2. 生产管理:让车间“自带调度员”

制造执行系统(MES)是车间管理的“大脑”,但它的规则通常是固定的,一旦遇到订单突变或设备停机,就需要人工干预。

LNN 可以让 MES 更加灵活:

动态排产:当某台设备突然停机时,LNN 可以实时重排生产计划,把任务分配给其他设备,减少产线空转。

实时质量检测:在视觉检测场景中,LNN 能在模糊或有噪声的情况下依然识别产品缺陷。它就像一个经验丰富的质检员,不会因为光线不好就“误判”。

工艺优化:结合数字孪生技术,LNN 能模拟不同调度策略的效果,帮助工厂找到产能与能耗之间的最佳平衡点。

👉 举个例子:某车间临时接到加急订单,MES 原本的规则无法应对。LNN 驱动的调度模块会立即重新分配资源,让订单按时交付,而不会打乱整体生产节奏。

3. 供应链与物流:像 GPS 一样动态规划

制造业不仅仅是车间里的机器,还涉及供应链和物流。这里的不确定性更大:客户需求波动、供应商延迟、天气和交通突发情况……

LNN 在这里的用武之地包括:

需求预测:结合销售数据、天气预报、社交媒体趋势,LNN 能更准确地预测未来需求,避免库存积压或断货。

库存管理:它能实时调整补货节奏,实现“准时化”供料,降低仓储成本。

物流调度:LNN 可以根据实时路况规划运输路线,就像一款工业版的“高德地图”,让货物更快更省钱地到达目的地。

👉 比如,一家电子厂原计划用 A 供应商的零件,但由于突发暴雨物流受阻。LNN 驱动的 ERP 系统能迅速识别风险,切换到备用供应商,并动态调整运输路线,确保生产不断档。

4. 小结

可以把这三个层级理解为“从车间到企业”:

过程控制:机器更聪明;

生产管理:车间更灵活;

供应链与物流:企业更敏捷。

LNN 在这三方面的结合,正好覆盖了智能制造的全链条。

四、挑战:为什么 LNN 还没全面落地?

如果你看完前面三章,可能会觉得:LNN 简直完美,既聪明、又高效、还抗噪,为什么不直接推向工厂?

事实是,LNN 目前还处在“潜力巨大,但不够成熟”的阶段。它确实能解决传统深度学习的一些痛点,但自身也带来新的问题。

1. 算力矛盾:又省又费

在学术论文里,LNN 常被描述为“参数少、效率高”。这是对的——比如 LTC-RNN 在处理某些任务时确实比 LSTM 轻量。

但另一方面,LNN 的自适应特性意味着它需要不断调整内部状态。训练和优化时,算力消耗反而可能更大。如果部署在边缘设备上,尤其是工厂里的低功耗控制器,这就是个不小的挑战。

👉 换句话说,LNN 在实验室里看起来很省力,但放到车间,可能依旧“吃不消”。

2. 数据依赖:既能抗噪,又挑剔

很多研究表明,LNN 对噪声数据比 LSTM 更鲁棒,这让它非常适合工厂这种环境。

可问题是:鲁棒≠无敌。

如果传感器严重失准,LNN 的输出依旧会跑偏;

如果训练数据缺乏多样性,LNN 可能在新场景下表现不稳定;

LNN 虽然能抗一些小噪声,但对整体数据流的一致性依然很敏感。

所以它并不是“随便喂数据就能跑”的万能模型。

3. 系统兼容:新瓶装老酒的麻烦

制造业的设备寿命通常以“十年”为单位。很多工厂里还在用十几年前的 PLC(可编程逻辑控制器)。这些老系统接口固定、协议死板,要和 LNN 对接并不容易。

更糟糕的是,不同厂商的设备标准各异,LNN 想“无缝嵌入”,往往要做大量定制化开发。对企业来说,这意味着高成本和高风险。

4. 可解释性:黑盒问题依旧存在

虽然 LNN 在理论上比 LSTM 更“透明”,能体现一定的因果关系,但对工程师而言,它依然是个黑盒。

在制造业里,如果某个算法让设备停机,工程师必须能解释:为什么。如果解释不清,哪怕模型再准,也难以获得信任。尤其在安全关键场景(比如汽车制造、航空零部件),没有解释性的 AI 是很难通过认证的。

5. 人才与生态:从学术到工业的鸿沟

目前 LNN 的研究大多集中在学术界,开源工具和工业级部署案例仍然有限。相比于成熟的 CNN 或 Transformer,LNN 的社区还很小,人才储备不足。这让企业在考虑应用时会犹豫:用不起,用不动,也没人懂。

五、未来展望:LNN 的下一步在哪里?

液态神经网络的概念并不复杂:它让神经网络像液体一样,能随环境变化灵活流动。但要把这种“聪明的液体大脑”真正带进工厂,还需要一系列技术和工程突破。

未来,研究者和产业界可能会在以下几个方向发力。

1. 模型轻量化与能效优化

为什么重要?

工厂车间的边缘设备(如传感器、控制器)算力有限,跑不动庞大的模型。研究方向:

剪枝、量化、知识蒸馏,把庞大的 LNN“瘦身”。潜在效果:

让 LNN 真正可以在低功耗设备上实时运行,而不是只能停留在实验室。

2. 系统级协同设计

为什么重要?

目前,传感器、控制算法和执行机构是分开的,耦合度低,容易延迟。研究方向:

将 传感-计算-执行 看作一个整体来优化。比如根据 LNN 的时间常数分布,动态调整传感器的采样频率。潜在效果:

提高实时性,减少系统能耗,形成“工厂神经系统”。

3. 可解释性与安全认证

为什么重要?

工厂不能接受一个“说不清理由”的算法去决定生产,尤其在安全关键环节。研究方向:

把因果建模、符号推理、形式化验证结合到 LNN 中,让它的决策过程能被追溯。潜在效果:

提升工程师的信任度,同时有助于通过 ISO/IEC 等工业标准认证。

4. 持续学习与领域自适应

为什么重要?

工厂不是静态环境,原材料、工艺和设备条件都可能变化。研究方向:

引入持续学习框架,让 LNN 能边运行边学习,避免频繁重训;同时发展跨工厂迁移能力。潜在效果:

让 LNN 随着使用时间越来越聪明,减少人工维护成本。

5. 与数字孪生和工业互联网融合

为什么重要?

工厂的核心趋势是数字化和互联化,单一模型再强也无法独立工作。研究方向:

将 LNN 嵌入数字孪生平台,用于实时仿真和调度;或者结合工业互联网,在多工厂间共享学习成果。潜在效果:

让 LNN 成为制造业的“分布式智慧大脑”。

6. 总结表:挑战 → 研究方向 → 潜在解决方案

| 当前挑战 | 研究方向 | 潜在解决方案 |

|---|---|---|

| 算力消耗大 | 模型轻量化 | 剪枝、量化、蒸馏;硬件加速 |

| 数据依赖强 | 数据增强 & 特征提取 | 噪声过滤、多源融合、数据插补 |

| 系统兼容性差 | 系统级协同 | 标准化接口;软硬件一体化优化 |

| 可解释性不足 | 可解释 AI | 因果推理、形式化验证、可视化工具 |

| 持续学习困难 | 在线/迁移学习 | 弹性权重整合、增量学习框架 |

| 工业落地难 | 生态建设 | 开源工具、产业-学术合作、人才培养 |

六、总结与收尾

液态神经网络(LNN)其实就是智能制造赛道上的“新人选手”。它并不是来推翻 CNN、LSTM 或 Transformer 的,而是补上了这些“前辈”在工厂环境里最头疼的短板:实时性、抗噪性和因果建模。

回顾前文,我们可以看到:

在 过程控制 中,LNN 像一个灵敏的技师,能即时捕捉异常并快速反应;

在 生产管理 中,它更像一个灵活的调度员,让车间能跟随环境变化实时排产、及时质检;

在 供应链与物流 中,它又像一个工业版的“导航助手”,帮助企业在不确定的市场环境里保持敏捷。

但与此同时,它也还年轻:算力开销、数据依赖、兼容性、可解释性……这些都是它必须面对的成长烦恼。

未来五到十年,我们可能会看到这样的画面:

工厂里的传感器和设备,不仅能“感知”,还能“思考”,因为它们内嵌了轻量化的 LNN;

车间管理系统不再死板,而是像活的神经网络一样,可以随订单波动自动重排任务;

供应链调度不再只是静态规则,而是 LNN 驱动的动态博弈,让企业对突发事件具备更强的韧性。

一句话总结:

液态神经网络不是万能钥匙,但它可能是制造业走向“自适应”和“自主化”的关键拼图。它让我们看到了一种新的可能性:AI 不只是“被动处理数据的工具”,而是能与复杂系统共舞的“液态大脑”。

对于研究者,这是一个值得深耕的新方向;对于工程师,这是一个需要关注的前沿趋势;而对于制造业来说,这或许正是未来智能化升级的突破口。