浅谈JMeter Listener

在性能测试领域,Apache JMeter 凭借开源、灵活的特性成为主流工具,而 Listener(结果监听器) 则是分析测试结果的核心支点——它们像“数据捕手”,精准抓取请求响应、响应时间、错误率等关键信息,支撑我们从调试到压测的全流程分析。本文将深度拆解常见Listener的用途与用法,帮你打通“数据采集→分析→决策”的任督二脉。

一、Listener的核心价值:不止于“看结果”

Listener的本质是结果处理器,核心作用可归纳为三点:

- 实时调试:开发/调试阶段,实时查看请求细节(如参数、响应体),快速定位接口问题;

- 性能分析:压测时统计吞吐量、响应时间、错误率等指标,评估系统性能;

- 数据沉淀:将结果保存为文件或推送到外部系统(如InfluxDB),供离线分析或长期监控。

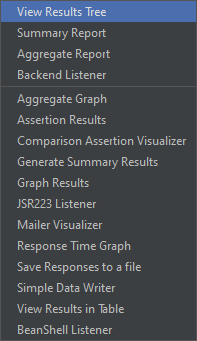

二、16款常用Listener深度解析(附场景化用法)

以下按调试效率、性能分析、数据扩展三大维度,解析用户常见的Listener:

🔍 调试类:快速定位问题

1. View Results Tree(结果树查看器)

- 用途:调试“神器”,逐请求查看请求头、响应体、断言结果,甚至支持JSON/XML格式化。

- 用法:

- 展开节点,切换

Request(看参数)、Response Data(看返回)、Assertion Results(看断言失败原因); - 用顶部“Filter”仅显示错误请求,聚焦问题。

- 展开节点,切换

- 禁忌:压测时必关! 大量数据会让JMeter卡顿,甚至内存溢出。

2. View Results in Table(表格查看结果)

- 用途:以表格形式展示每个请求的响应时间、状态码、URL,适合调试阶段逐个验证请求。

- 优势:比“结果树”更轻量化,可快速扫瞄异常请求(如状态码≠200)。

📊 性能分析类:指标驱动决策

3. Summary Report(汇总报告)

- 核心指标:样本数、平均响应时间、错误率、吞吐量(Requests/sec)。

- 适用场景:压测后快速概览整体表现,判断“吞吐量是否达标”“错误率是否过高”。

4. Aggregate Report(聚合报告)

- 进阶能力:在Summary基础上,新增 百分位时间(如90% Line,代表90%请求的响应时间≤该值)。

- 分析逻辑:

- 若

90% Line远高于平均值,说明长尾请求多(部分用户体验差); - 对比不同接口的

Throughput,定位性能瓶颈接口。

- 若

5. Aggregate Graph(聚合图表)

- 可视化升级:将Aggregate Report的数据转化为柱状图/折线图,直观展示“响应时间分布”“吞吐量趋势”。

- 场景:对比不同测试场景(如并发100 vs 并发500)的性能差异。

6. Response Time Graph(响应时间图)

- 专注分布:以直方图+趋势线展示响应时间分布,快速判断:

- 若“长尾”(高响应时间区间)占比高→系统尾部性能差;

- 若曲线波动剧烈→系统稳定性不足。

🚀 数据扩展类:打通外部生态

7. Backend Listener(后端监听器)

- 核心能力:将结果推送到外部系统(如InfluxDB、Prometheus),结合Grafana搭建实时监控看板。

- 配置示例:

- 选

InfluxDB作为Backend,填写地址、数据库、指标前缀; - 压测时,Grafana实时展示“响应时间变化”“吞吐量曲线”,支持告警。

- 选

- 优势:适合长时间压测、分布式测试,避免JMeter本地存储压力。

8. JSR223 Listener(JSR223监听器)

- 终极灵活:用Groovy/Java脚本自定义处理结果,比如:

- 提取响应中的特殊字段(如订单号),写入数据库;

- 实时计算复杂指标(如TPS波动系数=当前TPS/基线TPS);

- 生成自定义日志(如“响应时间>500ms的请求明细”)。

- 替代方案:旧版

BeanShell Listener性能较差,优先选JSR223+Groovy。

🎯 特殊场景类:解决细分需求

9. Assertion Results(断言结果)

- 聚焦失败:仅显示断言失败的请求,过滤成功数据,避免信息干扰。

- 场景:接口返回内容验证失败时,快速定位“哪个请求、哪个断言规则失败”。

10. Comparison Assertion Visualizer(对比断言可视化器)

- 版本对比:对比两个响应的差异(如新老接口、不同环境),高亮显示字段增减、值变化。

- 用法:配合

Comparison Assertionsampler使用,直观排查接口变更的影响。

11. Mailer Listener(邮件监听器)

- 自动告警:测试结束后,根据规则(如错误率>5%)发送邮件报告。

- 配置:填写SMTP服务器、发件人、收件人,设置触发条件(Always/On Error)。

- 场景:无人值守的定时压测,自动通知结果。

12. Save Responses to a file / Simple Data Writer(结果存储)

Save Responses:按需保存响应到文件(如仅保存错误响应),适合分析特殊报文;Simple Data Writer:更灵活,可自定义导出字段(如响应时间、URL、状态码),支持CSV格式,方便后续用Excel/Python分析。

三、Listener最佳实践:调试≠压测,场景决定策略

1. 调试阶段(开发/接口验证)

- 组合:

View Results Tree(看细节) +Assertion Results(看失败) +View Results in Table(扫瞄异常); - 动作:逐个请求验证,确保参数、响应、断言全通过。

2. 压测阶段(性能验证)

- GUI模式(仅调试):仅开

Aggregate Report,其余Listener关闭; - 非GUI模式(真实压测):

- 用

Backend Listener推数据到InfluxDB+Grafana,实时监控; - 或用

Simple Data Writer保存全量数据,离线用Aggregate Report分析;

- 用

- 禁忌:压测时开

View Results Tree=自毁长城(性能腰斩)。

3. 长期监控/分布式测试

- 必选

Backend Listener,结合Prometheus+Grafana搭建Dashboard,支持多机数据聚合。

四、避坑指南:这些错误别再犯!

- 压测时开太多Listener:JMeter需同时处理“发请求+存结果”,资源耗尽会导致结果失真(如响应时间被高估);

- 依赖GUI看结果:非GUI模式(

jmeter -n -t test.jmx -l result.jtl)更稳定,结果文件可导入GUI分析; - 混用BeanShell和JSR223:优先选JSR223+Groovy(执行效率比BeanShell高3倍+);

- 忽略百分位时间:平均值会掩盖“长尾请求”,90% Line才是用户体验的真实反映。

结语:让数据“说话”,而非“堆砌”

Listener的本质是数据的入口和出口:调试时,它们帮你快速定位问题;压测时,它们帮你提炼指标;扩展时,它们帮你打通生态。记住:工具是死的,场景是活的——调试阶段可尽情探索,压测阶段必须回归极简,让JMeter专注“发请求”,把“数据分析”交给更专业的工具(如Grafana、Python)。

掌握这些Listener,你就能从“看结果”进化到“用结果驱动优化”,真正让性能测试产生价值。