ERNIE 学习

参考:百度ERNIE技术演进:从1.0到4.5的技术突破-CSDN博客

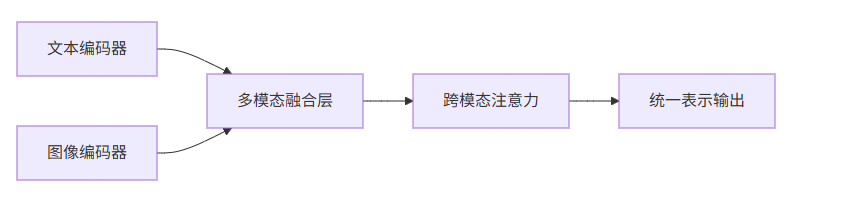

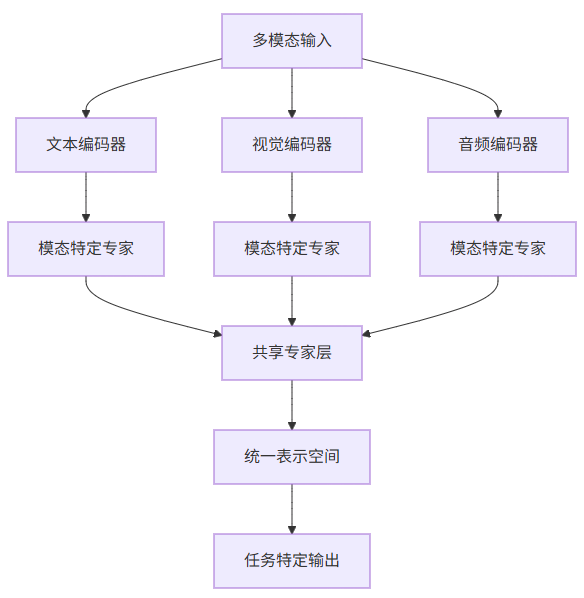

ERNIE 4.0:多模态突破

ERNIE 4.0实现了真正的多模态融合,支持文本、图像、音频等多种模态的联合理解与生成。这一突破使ERNIE系列从纯语言模型升级为多模态大模型。

ERNIE 4.5:混合专家架构巅峰

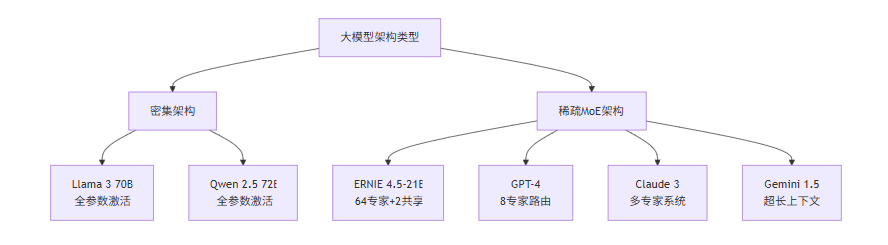

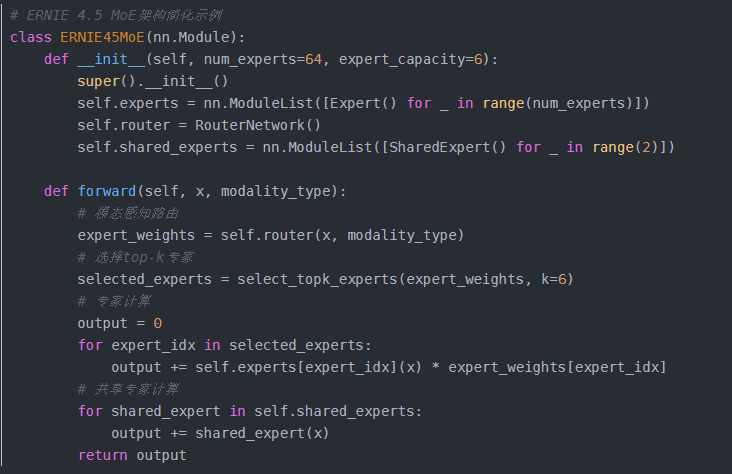

ERNIE 4.5代表了当前技术发展的最高水平,采用了创新的混合专家(MoE)架构:

核心架构特征:

总参数量: 4240亿参数

激活参数量: 470亿参数(A47B版本)

专家数量: 64个文本专家 + 64个视觉专家

共享专家: 2个跨模态共享专家

上下文长度: 131,072 tokens

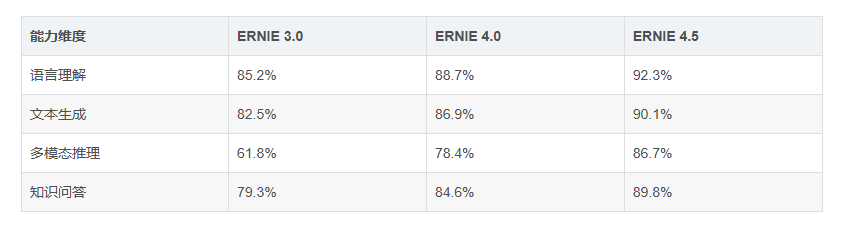

性能演进轨迹

ERNIE系列模型在各项基准测试中的表现持续提升:

4.5版本核心技术突破

ERNIE 4.5作为百度ERNIE系列的最新力作,在技术架构上实现了多项重大突破,特别是在混合专家模型(MoE)、超长上下文处理和多模态融合方面展现了卓越的技术创新。该版本通过创新的架构设计和训练策略,在保持高效推理的同时显著提升了模型性能。

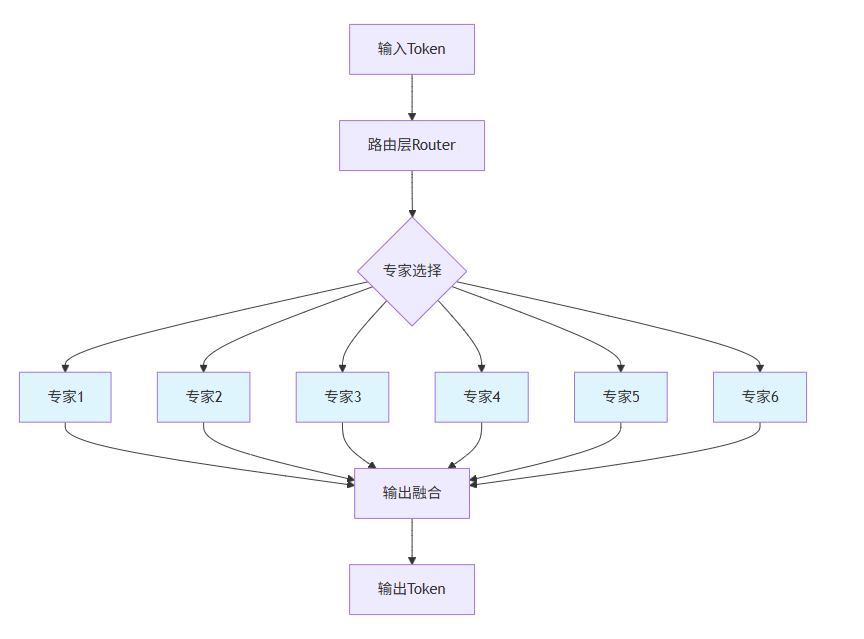

混合专家模型架构创新

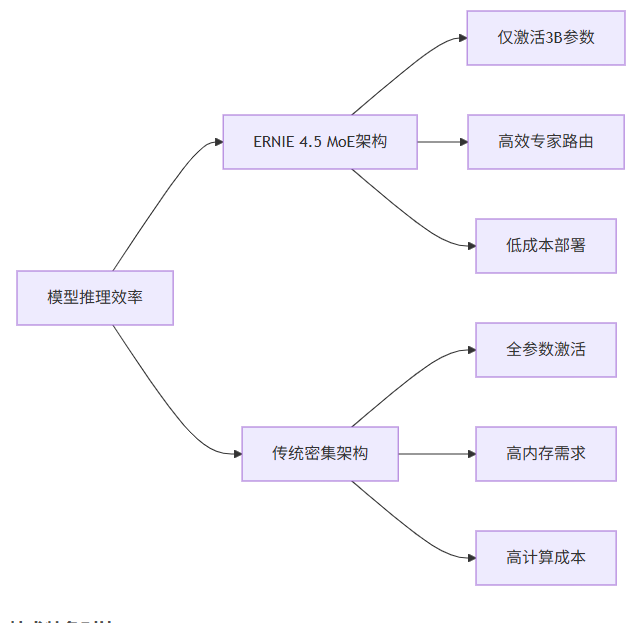

ERNIE 4.5采用了先进的混合专家模型架构,其核心设计理念是通过稀疏激活机制实现参数的高效利用。

多模态异构预训练技术

ERNIE 4.5在预训练阶段采用了创新的多模态异构训练策略:

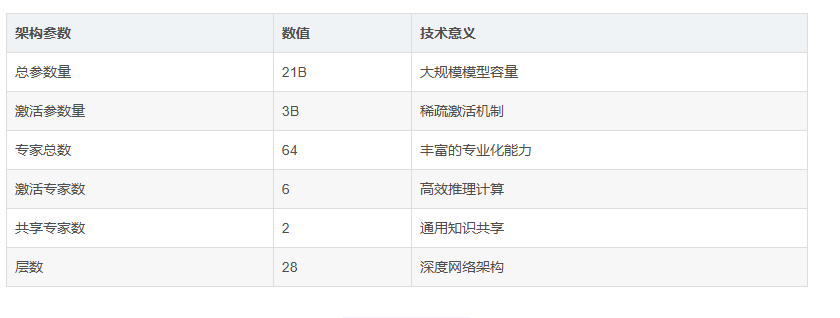

技术架构对比

ERNIE 4.5采用了创新的MoE(Mixture of Experts)架构,与传统的密集Transformer架构形成鲜明对比。以下是主要技术架构参数的对比: