AI推理革命:从Sequential Thinking到Agentic AI的演进之路——揭秘大语言模型思维进化的四重奏

AI思维演进示意图

❝"思考是人类最伟大的能力,而让AI学会思考,则是我们这个时代最激动人心的挑战。"

在人工智能的发展长河中,2023年注定是一个里程碑式的年份。从OpenAI的GPT-4到Anthropic的Claude,从Google的Bard到各种开源模型的涌现,大语言模型(LLM)的推理能力正在以前所未有的速度进化。而在这场推理革命的背后,四个关键概念正在重塑我们对AI思维的理解:Sequential Thinking(序列化思维)、Chain-of-Thought(思维链)、ReAct(推理-行动) 和 Agentic AI(智能体AI)。

今天,让我们一起踏上这场思维进化的探索之旅,看看AI是如何从简单的问答机器,一步步进化为能够独立思考和行动的智能体的。

一、思维的起点:Sequential Thinking——AI学会"一步一步来"

什么是Sequential Thinking?

想象一下,当你在解决一个复杂的数学题时,你不会直接给出答案,而是会在草稿纸上一步步地推导。这就是序列化思维的本质——将复杂问题分解为一系列有序的步骤。

在传统的大语言模型中,AI往往像一个"直觉型天才",能够直接给出答案,但却无法解释推理过程。这就像一个学生告诉你"答案是42",但却说不出为什么是42一样。Sequential Thinking的出现,让AI开始学会"慢思考"。

# 传统模式:直接回答

def traditional_answer(question):return model.generate(question) # 直接输出最终答案# Sequential Thinking:步骤化思考

def sequential_thinking(question):steps = []current_problem = questionwhile not is_final_answer(current_problem):step = analyze_next_step(current_problem)steps.append(step)current_problem = update_problem(current_problem, step)return {'steps': steps,'final_answer': current_problem}

Sequential Thinking的核心特征

-

分解性(Decomposition):将复杂问题拆分为简单子问题

-

有序性(Ordering):步骤之间存在逻辑顺序

-

渐进性(Progressive):每一步都基于前面步骤的结果

-

可追踪性(Traceability):整个推理过程清晰可见

实际应用场景

在实际应用中,Sequential Thinking展现出了强大的威力:

数学问题求解:

问题:小明有15个苹果,给了小红3个,又给了小华5个,请问小明还剩多少个苹果?Sequential Thinking过程:

步骤1:识别初始状态 - 小明有15个苹果

步骤2:第一次分配 - 给小红3个,剩余15-3=12个

步骤3:第二次分配 - 给小华5个,剩余12-5=7个

步骤4:得出最终答案 - 小明还剩7个苹果

逻辑推理:

问题:如果所有的鸟都会飞,企鹅是鸟,那么企鹅会飞吗?Sequential Thinking过程:

步骤1:识别前提条件 - 所有鸟都会飞(前提A)

步骤2:识别事实 - 企鹅是鸟(前提B)

步骤3:应用逻辑规则 - 如果A且B,则企鹅会飞

步骤4:检验现实 - 企鹅实际上不会飞

步骤5:识别矛盾 - 前提与现实不符,需要修正前提

二、推理的升华:Chain-of-Thought——让AI拥有"思维链条"

CoT:从Google的重大突破说起

2022年1月,Google Research发表了一篇震撼学术界的论文《Chain-of-Thought Prompting Elicits Reasoning in Large Language Models》。这篇论文提出的Chain-of-Thought(CoT)方法,被誉为"让AI学会思考的里程碑"。

CoT不仅仅是Sequential Thinking的简单延伸,更是一种系统化的推理框架。如果说Sequential Thinking是"一步一步来",那么CoT就是"一环扣一环的思维链条"。

CoT的技术原理

CoT的核心思想是通过few-shot prompting的方式,为大语言模型提供推理示例,让模型学会模仿人类的思维过程。

# CoT Prompting示例

def cot_prompting():examples = [{"question": "Roger有5个网球。他买了2罐网球,每罐有3个球。他现在有多少个网球?","reasoning": """让我一步步思考这个问题:- Roger最初有5个网球- 他买了2罐网球,每罐3个,所以买了2×3=6个网球- 总共有5+6=11个网球""","answer": "11个网球"}]prompt = build_cot_prompt(examples, new_question)return model.generate(prompt)

CoT的三大优势

-

可解释性增强:每个推理步骤都清晰可见,用户可以理解AI的思维过程

-

准确性提升:通过分步推理,减少了直接跳跃到错误结论的可能性

-

复杂性处理:能够处理多步骤的复杂问题,而不是仅限于简单的问答

CoT的变体与发展

1. Zero-shot CoT

最简单的形式,只需要在问题后加上"让我们一步步思考":

问题:如果一个商店的苹果价格是每斤3元,小王买了5斤,打了8折,他需要付多少钱?

提示:让我们一步步思考。AI回答:

让我一步步分析:

1. 苹果单价:3元/斤

2. 购买数量:5斤

3. 原价:3×5=15元

4. 打8折:15×0.8=12元

所以小王需要付12元。

2. Self-Consistency CoT

生成多个推理路径,然后选择最一致的答案:

def self_consistency_cot(question, num_samples=5):reasoning_paths = []answers = []for _ in range(num_samples):result = cot_reasoning(question)reasoning_paths.append(result.reasoning)answers.append(result.answer)# 选择出现频率最高的答案final_answer = most_common(answers)return final_answer, reasoning_paths

3. Tree-of-Thoughts (ToT)

将推理过程扩展为树状结构,探索多个可能的推理分支:

问题根节点

├── 推理分支A

│ ├── 子步骤A1

│ └── 子步骤A2

├── 推理分支B

│ ├── 子步骤B1

│ └── 子步骤B2

└── 推理分支C└── 子步骤C1

CoT在实际应用中的表现

根据Google的研究,CoT在多个基准测试中都显示出了显著的性能提升:

-

GSM8K数学题:准确率从17.9%提升到58.1%

-

MAWPS数学应用题:准确率从7.4%提升到78.7%

-

CommonsenseQA常识推理:准确率从72.0%提升到78.1%

这些数据清楚地表明,CoT不仅仅是一个技术改进,更是AI推理能力的一次质的飞跃。

三、行动的融合:ReAct——推理与行动的完美结合

ReAct:思考与行动的二重奏

如果说CoT让AI学会了思考,那么ReAct(Reasoning + Acting)则让AI学会了在思考中行动,在行动中思考。这就像一个优秀的侦探,既会分析线索(推理),又会实地调查(行动)。

ReAct是由普林斯顿大学和Google联合提出的突破性框架。它的核心理念是:让AI在推理过程中与外部环境交互,通过行动获取新信息来辅助推理。

ReAct的工作原理

class ReActAgent:def __init__(self, llm, tools):self.llm = llmself.tools = toolsdef solve(self, task):observation = "Task: " + tasktrajectory = []while not self.is_complete():# 思考步骤thought = self.llm.generate(f"Thought: {observation}")trajectory.append(("Thought", thought))# 行动步骤action = self.llm.generate(f"Action: {thought}")trajectory.append(("Action", action))# 执行行动并获取观察结果observation = self.execute_action(action)trajectory.append(("Observation", observation))return trajectorydef execute_action(self, action):if action.startswith("Search"):query = action.split("Search[")[1].split("]")[0]return self.tools.search(query)elif action.startswith("Calculate"):expression = action.split("Calculate[")[1].split("]")[0]return self.tools.calculate(expression)# ... 其他工具调用

ReAct的实际运行示例

让我们看一个ReAct解决实际问题的完整过程:

问题:谁是《阿凡达:水之道》的导演?这部电影在中国的票房收入是多少?

Thought 1: 我需要找到《阿凡达:水之道》的导演信息。

Action 1: Search[阿凡达:水之道 导演]

Observation 1: 《阿凡达:水之道》是由詹姆斯·卡梅隆执导的2022年科幻电影...Thought 2: 好的,导演是詹姆斯·卡梅隆。现在我需要查找这部电影在中国的票房收入。

Action 2: Search[阿凡达:水之道 中国票房]

Observation 2: 《阿凡达:水之道》在中国内地票房收入约为17.78亿人民币...Thought 3: 现在我有了完整的信息。

Action 3: Finish[《阿凡达:水之道》的导演是詹姆斯·卡梅隆,该电影在中国的票房收入约为17.78亿人民币。]

ReAct vs CoT:关键差异分析

| 维度 | Chain-of-Thought | ReAct |

|---|---|---|

| 推理方式 | 纯内部推理 | 推理+外部交互 |

| 信息来源 | 模型内部知识 | 实时外部数据 |

| 适用场景 | 数学、逻辑问题 | 信息查询、复杂任务 |

| 可靠性 | 受训练数据限制 | 可获取最新信息 |

| 复杂度 | 相对简单 | 需要工具集成 |

ReAct的技术创新点

-

交替模式(Interleaving Pattern):思考和行动交替进行,而不是先思考完再行动

-

环境感知(Environment Awareness):能够感知和响应环境变化

-

工具集成(Tool Integration):可以调用各种外部工具和API

-

反思机制(Reflection Mechanism):根据行动结果调整推理策略

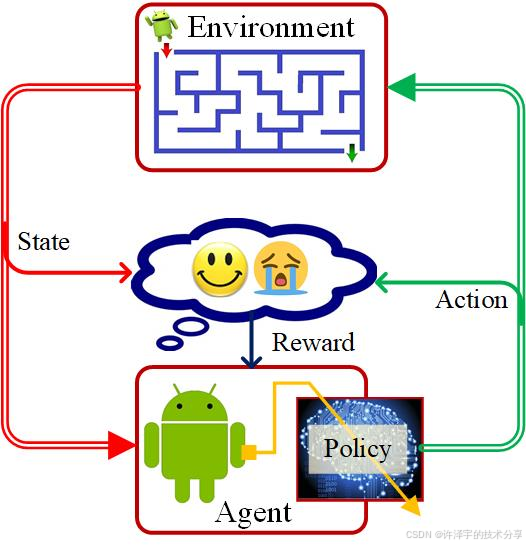

四、智能的升华:Agentic AI——从工具到伙伴的蜕变

Agentic AI:智能体时代的来临

如果前面三个概念是AI推理能力的渐进式提升,那么Agentic AI则代表着一个全新时代的到来——AI智能体时代。

Agentic AI不再是一个被动的工具,而是一个主动的智能体,能够:

-

🎯 自主设定目标

-

🤔 独立制定计划

-

🔧 灵活调整策略

-

🤝 与人类协作

-

📈 持续学习改进

Agentic AI的架构设计

class AgenticAI:def __init__(self):self.memory = EpisodicMemory()self.planner = StrategicPlanner()self.executor = ActionExecutor()self.reflector = SelfReflector()self.learner = ContinualLearner()def run(self, goal):while not self.is_goal_achieved(goal):# 1. 计划制定plan = self.planner.create_plan(goal, self.memory.retrieve_context())# 2. 执行行动for step in plan.steps:result = self.executor.execute(step)self.memory.store_experience(step, result)# 3. 实时反思if not result.successful:self.reflector.analyze_failure(step, result)plan = self.planner.revise_plan(plan, result)# 4. 学习更新self.learner.update_from_experience(self.memory.get_recent_experiences())

Agentic AI的核心特征

1. 自主性(Autonomy)

# 传统AI:被动响应

def traditional_ai(user_input):return process_and_respond(user_input)# Agentic AI:主动思考

def agentic_ai(environment_state):goals = self.identify_goals(environment_state)for goal in goals:if self.should_pursue(goal):self.initiate_action_sequence(goal)

2. 持久性(Persistence)

Agentic AI不会因为一次失败就放弃,而是会持续尝试不同的方法:

def persistent_problem_solving(self, problem):attempts = 0max_attempts = 10while attempts < max_attempts:strategy = self.generate_strategy(problem, attempts)result = self.try_strategy(strategy)if result.success:self.learn_from_success(strategy, result)return resultelse:self.learn_from_failure(strategy, result)problem = self.refine_problem_understanding(problem, result)attempts += 1return self.escalate_to_human(problem)

3. 协作性(Collaboration)

现代的Agentic AI不是孤军奋战,而是能够与其他AI智能体或人类形成协作团队:

class CollaborativeAgent:def __init__(self, specialization):self.specialization = specializationself.team_members = []def handle_complex_task(self, task):# 分析任务复杂度if self.can_handle_alone(task):return self.solve_independently(task)# 寻找合作伙伴required_skills = self.analyze_required_skills(task)partners = self.find_partners(required_skills)# 协作解决team = Team([self] + partners)return team.collaborative_solve(task)

Agentic AI的实际应用案例

案例1:智能客服系统2.0

传统客服:只能回答预设问题

Agentic客服:能够主动识别客户需求,制定解决方案,协调内部资源客户:"我的订单有问题"

Agentic AI的处理流程:

1. 主动询问:识别具体问题类型

2. 调查分析:查询订单状态、物流信息、支付记录

3. 方案制定:根据问题制定个性化解决方案

4. 资源协调:联系相关部门执行方案

5. 跟踪反馈:主动跟进解决效果,确保客户满意

案例2:智能投资顾问

class InvestmentAgent:def manage_portfolio(self, user_profile):# 持续市场监控market_data = self.monitor_markets()# 风险评估risk_assessment = self.assess_market_risks(market_data)# 策略调整if risk_assessment.requires_action:new_strategy = self.develop_strategy(user_profile, risk_assessment)# 主动通知用户self.notify_user(new_strategy.recommendation)# 获得授权后执行if user_profile.auto_execute_enabled:self.execute_trades(new_strategy)

五、四重奏的和谐统一:从Sequential到Agentic的进化路径

进化时间线

graph LRA[Sequential Thinking<br/>2020-2021] --> B[Chain-of-Thought<br/>2022]B --> C[ReAct<br/>2022-2023]C --> D[Agentic AI<br/>2023-2024]A1[一步步思考] --> AB1[思维链推理] --> BC1[推理+行动] --> CD1[自主智能体] --> D

能力对比矩阵

| 能力维度 | Sequential | CoT | ReAct | Agentic |

|---|---|---|---|---|

| 推理深度 | ⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| 行动能力 | ❌ | ❌ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| 自主性 | ❌ | ⭐ | ⭐⭐ | ⭐⭐⭐⭐⭐ |

| 学习能力 | ❌ | ⭐ | ⭐⭐ | ⭐⭐⭐⭐⭐ |

| 协作能力 | ❌ | ❌ | ⭐⭐ | ⭐⭐⭐⭐⭐ |

| 复杂度 | ⭐ | ⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

技术栈的演进

# Sequential Thinking 时代

def solve_problem(problem):steps = decompose(problem)for step in steps:result = process_step(step)return result# CoT 时代

def solve_problem_cot(problem):reasoning_chain = generate_reasoning_steps(problem)return follow_reasoning_chain(reasoning_chain)# ReAct 时代

def solve_problem_react(problem):while not solved:thought = think(current_state)action = decide_action(thought)observation = execute_action(action)current_state = update_state(observation)return solution# Agentic AI 时代

def solve_problem_agentic(problem):agent = create_agent_for_problem(problem)agent.set_goal(problem)while not agent.goal_achieved():agent.plan()agent.execute()agent.reflect()agent.adapt()return agent.get_solution()

六、实战演练:构建一个完整的AI推理系统

让我们通过一个实际的代码示例,来看看如何将这四种思维模式整合到一个完整的AI系统中。

项目背景:智能学习助手

假设我们要构建一个智能学习助手,它需要能够:

-

理解学生的问题

-

制定学习计划

-

提供个性化指导

-

跟踪学习进度

import asyncio

from typing import List, Dict, Any

from dataclasses import dataclass

from enum import Enumclass ReasoningMode(Enum):SEQUENTIAL = "sequential"COT = "chain_of_thought"REACT = "reason_act"AGENTIC = "agentic"@dataclass

class LearningContext:student_id: strsubject: strdifficulty_level: intlearning_history: List[str]current_goals: List[str]class IntelligentTutor:def __init__(self):self.memory = {}self.tools = {'search': self.search_knowledge,'assess': self.assess_understanding,'generate_exercise': self.generate_practice_exercise,'track_progress': self.track_learning_progress}async def help_student(self, question: str, context: LearningContext) -> str:"""根据问题复杂度选择合适的推理模式"""complexity = self.analyze_question_complexity(question)if complexity == "simple":return await self.sequential_help(question, context)elif complexity == "moderate":return await self.cot_help(question, context)elif complexity == "complex":return await self.react_help(question, context)else: # very_complexreturn await self.agentic_help(question, context)async def sequential_help(self, question: str, context: LearningContext) -> str:"""简单问题使用Sequential Thinking"""steps = ["理解问题","回忆相关知识","组织答案","验证正确性"]result = []for i, step in enumerate(steps, 1):step_result = await self.process_step(step, question, context)result.append(f"步骤{i}: {step} -> {step_result}")return "\n".join(result)async def cot_help(self, question: str, context: LearningContext) -> str:"""中等复杂度问题使用CoT"""reasoning_prompt = f"""问题: {question}学生背景: {context.subject}, 难度等级{context.difficulty_level}让我一步步分析这个问题:"""reasoning_chain = await self.generate_reasoning_chain(reasoning_prompt)return reasoning_chainasync def react_help(self, question: str, context: LearningContext) -> str:"""复杂问题使用ReAct"""trajectory = []observation = f"学生问题: {question}"for step in range(5): # 最多5个推理-行动循环# 思考步骤thought = await self.think(observation, context)trajectory.append(f"思考{step+1}: {thought}")# 决定行动action = await self.decide_action(thought)trajectory.append(f"行动{step+1}: {action}")# 执行行动observation = await self.execute_action(action, context)trajectory.append(f"观察{step+1}: {observation}")if "答案完整" in observation:breakreturn "\n".join(trajectory)async def agentic_help(self, question: str, context: LearningContext) -> str:"""超复杂问题使用Agentic AI"""agent = LearningAgent(question, context, self.tools)# 设定长期目标agent.set_goal("全面解决学生的学习困惑并制定改进计划")# 自主执行result = await agent.autonomous_execute()# 持续跟进follow_up_plan = agent.create_follow_up_plan()return f"{result}\n\n后续计划:\n{follow_up_plan}"class LearningAgent:def __init__(self, question: str, context: LearningContext, tools: Dict):self.question = questionself.context = contextself.tools = toolsself.goal = Noneself.memory = []self.plan = []def set_goal(self, goal: str):self.goal = goalasync def autonomous_execute(self) -> str:# 制定初始计划await self.create_initial_plan()# 执行计划for task in self.plan:result = await self.execute_task(task)self.memory.append((task, result))# 根据结果调整计划if not result['success']:await self.revise_plan(task, result)# 总结和反思return await self.synthesize_results()async def create_initial_plan(self):"""制定初始学习计划"""self.plan = [{"type": "analyze", "desc": "深度分析学生问题"},{"type": "assess", "desc": "评估学生当前水平"},{"type": "research", "desc": "搜索相关学习资源"},{"type": "design", "desc": "设计个性化学习方案"},{"type": "implement", "desc": "提供具体指导"},{"type": "track", "desc": "制定跟踪计划"}]async def execute_task(self, task: Dict) -> Dict:"""执行具体任务"""task_type = task['type']if task_type == "analyze":return await self.analyze_student_question()elif task_type == "assess":return await self.tools['assess'](self.context)elif task_type == "research":return await self.tools['search'](self.question)elif task_type == "design":return await self.design_learning_plan()elif task_type == "implement":return await self.provide_guidance()elif task_type == "track":return await self.tools['track_progress'](self.context)return {"success": False, "error": "Unknown task type"}def create_follow_up_plan(self) -> str:"""创建后续跟进计划"""return """1. 24小时后检查学生理解情况2. 3天后提供巩固练习3. 1周后评估学习效果4. 根据进展调整学习策略"""# 使用示例

async def main():tutor = IntelligentTutor()context = LearningContext(student_id="student_001",subject="数学",difficulty_level=3,learning_history=["代数基础", "几何入门"],current_goals=["提高应用题解题能力"])# 简单问题simple_question = "什么是勾股定理?"simple_answer = await tutor.help_student(simple_question, context)print("简单问题回答:\n", simple_answer)# 复杂问题complex_question = "我在解决复合函数问题时总是出错,能帮我制定一个系统的学习计划吗?"complex_answer = await tutor.help_student(complex_question, context)print("\n复杂问题回答:\n", complex_answer)if __name__ == "__main__":asyncio.run(main())

七、未来展望:AI推理的下一个十年

技术发展趋势

1. 多模态推理融合

未来的AI将不仅仅处理文本,还将整合视觉、听觉、触觉等多种感知模态:

class MultimodalReasoningAgent:def __init__(self):self.text_processor = TextReasoningEngine()self.vision_processor = VisionReasoningEngine()self.audio_processor = AudioReasoningEngine()self.fusion_layer = MultimodalFusion()def reason(self, inputs):text_features = self.text_processor.process(inputs.text)vision_features = self.vision_processor.process(inputs.image)audio_features = self.audio_processor.process(inputs.audio)fused_representation = self.fusion_layer.fuse([text_features, vision_features, audio_features])return self.generate_reasoning(fused_representation)

2. 群体智能(Swarm Intelligence)

多个AI智能体协作解决复杂问题:

class SwarmReasoningSystem:def __init__(self, num_agents=10):self.agents = [SpecializedAgent(i) for i in range(num_agents)]self.coordinator = SwarmCoordinator()def collective_reasoning(self, problem):# 分配子任务subtasks = self.coordinator.decompose_problem(problem)# 并行推理partial_solutions = []for agent, task in zip(self.agents, subtasks):solution = agent.solve(task)partial_solutions.append(solution)# 融合解决方案final_solution = self.coordinator.merge_solutions(partial_solutions)return final_solution

3. 自进化推理系统

AI系统能够自主改进自己的推理算法:

class SelfEvolvingReasoner:def __init__(self):self.reasoning_strategies = self.load_initial_strategies()self.performance_tracker = PerformanceTracker()self.strategy_evolver = StrategyEvolver()def evolve(self):# 评估当前策略性能performance_data = self.performance_tracker.get_recent_performance()# 识别改进机会improvement_opportunities = self.analyze_weaknesses(performance_data)# 进化新策略for opportunity in improvement_opportunities:new_strategy = self.strategy_evolver.evolve_strategy(self.reasoning_strategies, opportunity)self.reasoning_strategies.append(new_strategy)# 淘汰低效策略self.prune_ineffective_strategies()

应用前景预测

1. 科学研究助手

class ScientificResearchAgent:"""科学研究AI助手"""def conduct_research(self, research_question):# 文献综述literature_review = self.comprehensive_literature_search(research_question)# 假设生成hypotheses = self.generate_testable_hypotheses(literature_review)# 实验设计experimental_designs = []for hypothesis in hypotheses:design = self.design_experiment(hypothesis)experimental_designs.append(design)# 数据分析计划analysis_plan = self.create_analysis_pipeline(experimental_designs)return ResearchPlan(hypotheses, experimental_designs, analysis_plan)

2. 创意合作伙伴

class CreativeCollaborator:"""创意AI合作伙伴"""def collaborate_on_creative_project(self, human_ideas, project_type):# 理解人类创意意图creative_intent = self.understand_creative_vision(human_ideas)# 生成互补性想法complementary_ideas = self.generate_complementary_concepts(creative_intent)# 创意融合fused_concepts = self.fuse_human_ai_creativity(human_ideas, complementary_ideas)# 可行性评估feasible_concepts = self.assess_feasibility(fused_concepts)return CreativeProjectPlan(feasible_concepts)

3. 个人生活智能管家

class LifeManagementAgent:"""个人生活智能管家"""def optimize_daily_life(self, user_preferences, life_context):# 全天候监控与分析life_patterns = self.analyze_life_patterns(user_preferences.activity_history)# 预测性建议upcoming_challenges = self.predict_upcoming_challenges(life_context)proactive_solutions = self.generate_proactive_solutions(upcoming_challenges)# 个性化优化optimization_plan = self.create_optimization_plan(life_patterns, user_preferences, proactive_solutions)return optimization_plan

伦理与挑战

随着AI推理能力的不断增强,我们也面临着前所未有的伦理挑战:

1. 透明性挑战

class ExplainableAI:"""可解释AI系统"""def make_decision_with_explanation(self, input_data):decision = self.make_decision(input_data)explanation = {'reasoning_steps': self.get_reasoning_trace(),'confidence_levels': self.get_confidence_scores(),'alternative_scenarios': self.explore_alternative_outcomes(),'bias_analysis': self.analyze_potential_biases(),'uncertainty_quantification': self.quantify_uncertainties()}return decision, explanation

2. 责任归属问题

class ResponsibleAI:"""负责任的AI系统"""def __init__(self):self.responsibility_tracker = ResponsibilityTracker()self.ethical_guidelines = EthicalGuidelines()self.human_oversight = HumanOversightSystem()def make_high_stakes_decision(self, context):# 伦理检查ethical_assessment = self.ethical_guidelines.assess(context)if ethical_assessment.requires_human_review:return self.human_oversight.request_human_decision(context)# 记录决策过程decision_record = self.make_decision_with_audit_trail(context)self.responsibility_tracker.log_decision(decision_record)return decision_record.decision

八、实践指南:如何选择合适的推理模式

决策流程图

def choose_reasoning_mode(task_complexity, data_availability, time_constraint):"""选择最适合的推理模式"""if task_complexity == "simple" and time_constraint == "tight":return ReasoningMode.SEQUENTIALelif task_complexity == "moderate" and not requires_external_data(task):return ReasoningMode.COTelif requires_external_interaction(task) and data_availability == "real_time":return ReasoningMode.REACTelif task_complexity == "very_high" and time_constraint == "loose":return ReasoningMode.AGENTICelse:# 混合模式return create_hybrid_reasoning_mode(task_complexity, data_availability, time_constraint)def create_hybrid_reasoning_mode(complexity, data_availability, time_constraint):"""创建混合推理模式"""modes = []# 总是从Sequential开始,确保基础逻辑清晰modes.append(ReasoningMode.SEQUENTIAL)# 如果需要深度推理,添加CoTif complexity in ["moderate", "high"]:modes.append(ReasoningMode.COT)# 如果需要外部交互,添加ReActif data_availability == "real_time":modes.append(ReasoningMode.REACT)# 如果是长期任务,使用Agenticif time_constraint == "loose" and complexity == "very_high":modes.append(ReasoningMode.AGENTIC)return HybridReasoningMode(modes)

最佳实践建议

1. 问题分析框架

class ProblemAnalysisFramework:def analyze_problem(self, problem_description):return {'complexity_level': self.assess_complexity(problem_description),'required_knowledge_domains': self.identify_domains(problem_description),'external_dependencies': self.find_dependencies(problem_description),'time_sensitivity': self.assess_urgency(problem_description),'stakeholder_impact': self.analyze_impact(problem_description)}def recommend_approach(self, analysis_result):if analysis_result['complexity_level'] <= 2:return "Sequential + CoT"elif analysis_result['external_dependencies']:return "ReAct"elif analysis_result['stakeholder_impact'] == "high":return "Agentic with human oversight"else:return "Adaptive hybrid approach"

2. 性能监控系统

class ReasoningPerformanceMonitor:def __init__(self):self.metrics = {'accuracy': AccuracyTracker(),'efficiency': EfficiencyTracker(),'explainability': ExplainabilityScorer(),'user_satisfaction': SatisfactionSurvey()}def monitor_reasoning_session(self, session):results = {}for metric_name, tracker in self.metrics.items():results[metric_name] = tracker.evaluate(session)# 生成改进建议improvement_suggestions = self.generate_improvements(results)return PerformanceReport(results, improvement_suggestions)

九、结语:AI思维的未来之路

站在2024年的时间节点上回望,从Sequential Thinking到Agentic AI的发展轨迹就像一部精彩的科幻小说正在变成现实。我们见证了AI从简单的"计算器"进化为能够独立思考和行动的"智能伙伴"。

技术演进的哲学思考

这场推理革命不仅仅是技术的进步,更是我们对"思考"本身理解的深化:

-

Sequential Thinking 教会了我们分解的力量

-

Chain-of-Thought 揭示了推理链条的奥秘

-

ReAct 展示了思考与行动的辩证统一

-

Agentic AI 开启了AI自主性的新纪元

对开发者的建议

-

保持学习心态:AI推理技术发展迅速,要持续关注最新研究进展

-

注重实践应用:理论再精彩,也要通过实际项目来验证和改进

-

重视伦理考量:随着AI能力增强,责任也随之增大

-

培养系统思维:不同推理模式各有优势,要学会系统性地组合使用

对企业的启示

-

渐进式采用:可以从Sequential和CoT开始,逐步引入更复杂的系统

-

投资基础设施:ReAct和Agentic AI需要强大的工具和数据支持

-

培养专业团队:需要既懂AI技术又懂业务场景的复合型人才

-

建立治理体系:制定AI使用的伦理准则和监管机制

未来的畅想

想象一下,在不远的将来:

-

你的AI助手能够理解你的长远目标,主动为你规划人生轨迹

-

科学家与AI伙伴共同探索宇宙奥秘,加速重大发现

-

教育系统中的AI导师为每个学生量身定制最优学习路径

-

企业决策由人类与AI智能体协作完成,效率和准确性大大提升

这不是遥不可及的科幻景象,而是正在我们眼前展开的现实。

写在最后

AI推理能力的飞跃发展让我们看到了人工智能的巨大潜力,但也提醒我们要以负责任的态度来开发和应用这些技术。毕竟,最强大的AI系统,也应该是最符合人类价值观和社会利益的系统。

正如图灵在半个多世纪前所预言的那样,机器总有一天会思考。现在,这个"总有一天"正在变成"就在今天"。而我们每一个技术工作者,都有幸成为这个历史时刻的见证者和参与者。

让我们携手迎接这个充满无限可能的AI推理新时代!

互动讨论

读完这篇文章,你对AI推理的发展有什么看法呢?

🤔 思考题:

-

在你的工作或学习中,哪种推理模式最适合解决你经常遇到的问题?

-

你认为Agentic AI会对你所在的行业带来哪些颠覆性改变?

-

面对越来越强大的AI推理能力,我们人类应该如何保持自己的独特价值?

📝 分享邀请:

-

如果你在实际项目中应用过这些推理技术,欢迎在评论区分享你的经验和心得

-

如果你对某个特定应用场景感兴趣,我们可以进一步讨论技术实现细节

-

如果你有不同的观点或补充,期待与你深入交流

💡 后续计划: 基于大家的反馈,我计划推出以下系列文章:

-

《ReAct实战指南:从零构建智能问答机器人》

-

《Agentic AI开发实战:打造你的第一个AI智能体》

-

《多模态推理系统设计:视觉+语言的完美融合》

让我们一起在AI推理的海洋中探索更多可能性!

作者简介:资深AI工程师,专注于大语言模型推理系统研发,致力于让AI技术更好地服务人类社会。

关键词:#AI推理 #ChainOfThought #ReAct #AgenticAI #SequentialThinking #大语言模型 #人工智能

❝如果这篇文章对你有帮助,欢迎点赞、收藏和转发,让更多人了解AI推理技术的魅力!

更多AIGC文章