Cursor 中的AI模型到底怎么选 ?

最近Cursor发布了最受开发者欢迎的AI模型榜单。

官方数据反映了多数人的选择,其中Claude 3.7 Sonnet稳稳位居榜首,那么是不是就直接无脑选择Claude 3.7 Sonnet就行了?

并不是!

以我个人为例子,使用比例就和官方榜单有很大的出入。

在Cursor中Gemini 2.5 Pro占80%,Claude 3.7 Sonnet占10%,GPT-3.5占5%,最后是GPT-4.1 5%。

在Roo和Cline中,Grok就直接90%,另一个Gemini 2.5 flash占10%,其他模型基本不用。

最近两年,大家都可以看到AI的发展有多快,我国超10亿参数的大模型,在短短一年之内,已经超过了100个,现在还在不断的发掘中,时代在瞬息万变,我们又为何不给自己多一个选择,多一个出路,多一个可能呢?

与其在传统行业里停滞不前,不如尝试一下新兴行业,而AI大模型恰恰是这两年的大风口,整体AI领域2025年预计缺口1000万人,其中算法、工程应用类人才需求最为紧迫!

学习AI大模型是一项系统工程,需要时间和持续的努力。但随着技术的发展和在线资源的丰富,零基础的小白也有很好的机会逐步学习和掌握。【点击蓝字获取】

【2025最新】AI大模型全套学习籽料(可白嫖):LLM面试题+AI大模型学习路线+大模型PDF书籍+640套AI大模型报告等等,从入门到进阶再到精通,超全面存下吧!

这里有哪些考量或者基本原则呢?下面讲讲一些我个人的偏好:

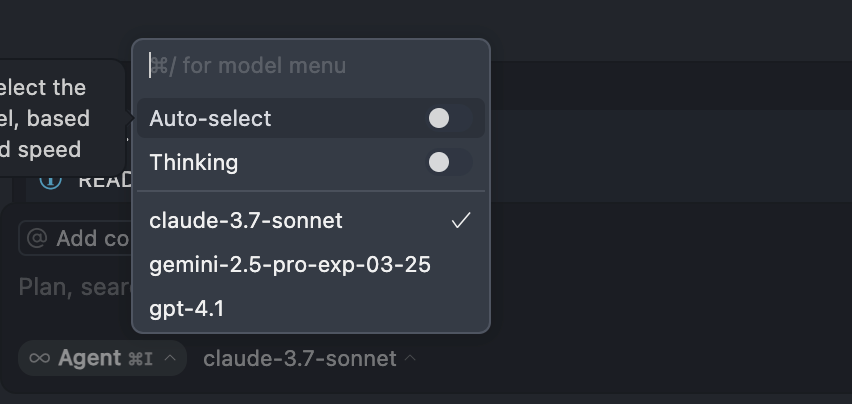

不要使用Auto模式

不使用Auto模式的原因很简单:没有掌控感,官方开设这个选项目的是想让消耗,能力,速度之间达成某种平衡,但实话一分钱一分货,消耗能力和速度本身是不可能三角。

与其让Cursor自动分配到垃圾模型白白浪费点数,还不如手动切换一下选择一个合适的,所以这个选项我基本万年不开。

一定打开Thinking

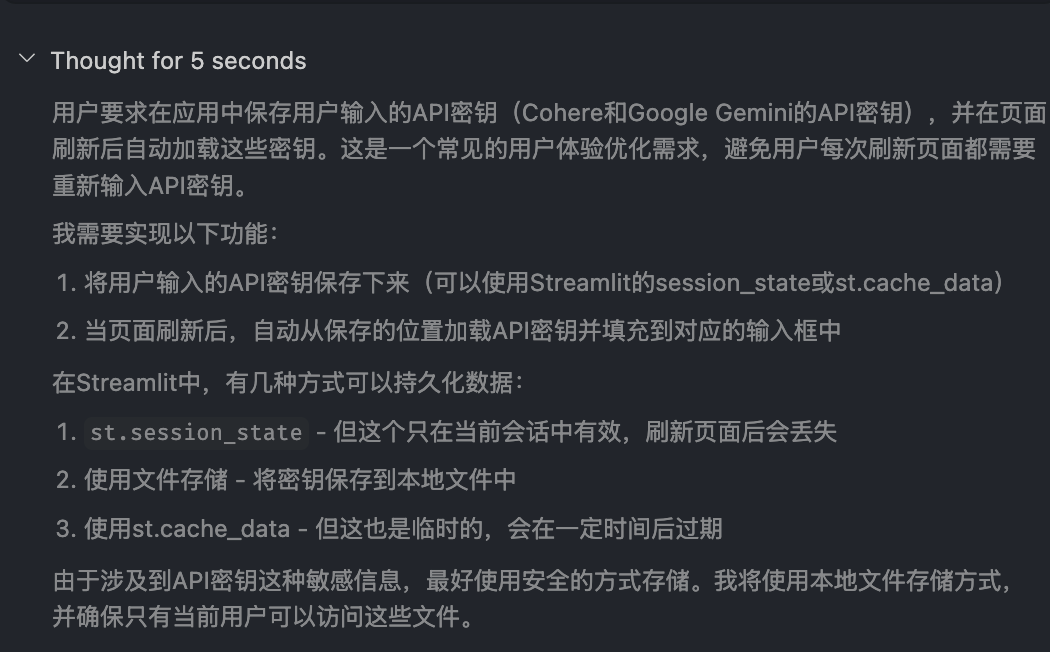

2025年思维链已经成为顶尖模型的标配开启Thinking模式,除了能力的提升之外,详细的思考过程也能让我们一窥模型处理过程,一来可以学习模型的解决问题的方式积累项目经验,二来能快速判断思考过程方向方案是否正确及时进行调整。

模型切换

项目规划,代码梳理,规则生成使用Gemini 2.5 Pro或者Claude 3.7 Sonnet,优先使用Gemini 2.5 Pro,尤其是那种老的迭代过多次的项目。

原因无它:量大一级压死人。

Gemini 2.5 Pro 目前支持高达 100万个令牌(tokens) 的上下文窗口,并计划在未来扩展到 200万个tokens。一次处理相当于数千页文本、整个代码库或大量多模态数据(如文本、图像、音频和视频)的输入。

相比之下,其他主流模型如 OpenAI 的 o3-mini 和 Anthropic 的 Claude 3.7 Sonnet为20万tokens。

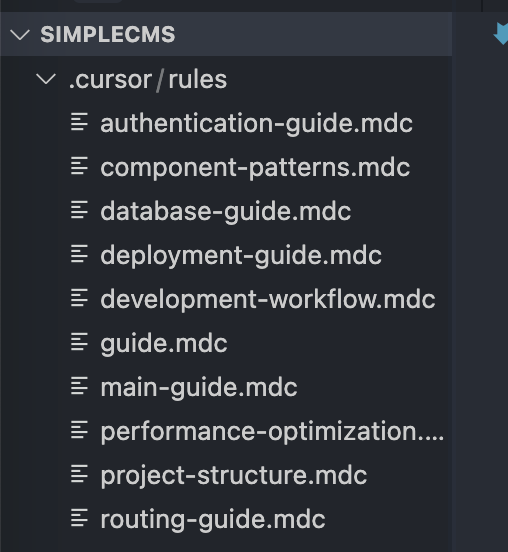

Gemini 2.5 Pro尤其在使用自动生成mdc文件见长,很少会出现明显的幻觉错误问题。

而对于单文件的修改或者模块化开发,建议切换Claude 3.x,Sonnet3.x还是保持了Claude一以贯之的快准狠。

不过这里有个比较两难的问题,到底是选3.7还是选3.5?

其实我个觉得 Claude 3.5 Sonnet 用起来反而比新出的 3.7 Sonnet 更顺手。特别是 3.7 的"思考版",在处理复杂任务或者聊太久之后,经常会陷入一种"改来改去就是不对"的死循环,挺让人抓狂,所以3.5虽然过了两年依然强悍,大部分场景下我还是偏向于使用3.5。

总结一下,如果把Gemini 2.5 Pro看成是运筹帷幄的军师,Claude 3.7 Sonnet 3.x就是临阵杀敌突袭的先锋。

特定任务

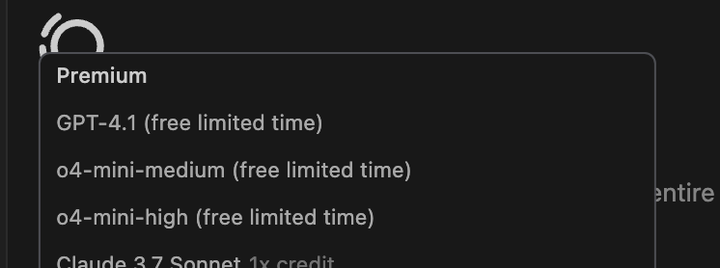

简单 Debug / 小修改: 可考虑使用成本较低或速度较快的模型,比如GPT-4.1 ,目前还处于免费使用的阶段,后期收费后价格将是顶尖模型的1/3点数消耗,小修小补其实完全够用。

比如一个TS的类型不对,这个时候杀猪就完全不需要使用牛刀了(当然土豪这条可以自动跳过)。

多模态任务:比如根据图片生成相关的网页,Claude 3.x Sonnet的审美和生成能力无出其右,Claude也是这些模型里面视觉和界面生成最优秀的。

Roo Cline

和Cursor不一样,在Cline使用Grok3算是没得选择的选择吧,使用其他模型成本太高,根本扛不住,Gemini 系列虽然免费,但是存在速率的限制,多跑几条就会报错,Grok3老马大方的每月提供了近150刀的额度,白嫖的150刀有了着落,Grok 3 API正式上线。

OpenAI开源了命令行版Cursor!Codex CLI配置接入Grok3 使用

另外,我大量的MCP使用场景都是在Cline下进行的,这个时候我会结合使用Gemini-flash版本。义如其名,Flash版本不仅速度快,而且有充足的上下文,对于MCP的理解精准度很高,反应迅速,综合考量下只有这个Flash模型能够在处理MCP任务的时候做到又快又准。

总结下来,最佳实践不是固定使用单一模型,而是在不同场景下动态切换。

在快速请求额度内使用高性能模型(如 Claude 3.7 或 Gemini 2.5 Pro),额度用尽后切换到性价比高的 4.1。手动切换灵活选择灵活性才是比较有效方式 。

当然不管黑猫白猫能抓到老鼠的就是好猫,能解决问题的方案才是好的方案,以上仅仅是个人的体感和观察,仅供参考。

最近两年,大家都可以看到AI的发展有多快,我国超10亿参数的大模型,在短短一年之内,已经超过了100个,现在还在不断的发掘中,时代在瞬息万变,我们又为何不给自己多一个选择,多一个出路,多一个可能呢?

与其在传统行业里停滞不前,不如尝试一下新兴行业,而AI大模型恰恰是这两年的大风口,整体AI领域2025年预计缺口1000万人,其中算法、工程应用类人才需求最为紧迫!

学习AI大模型是一项系统工程,需要时间和持续的努力。但随着技术的发展和在线资源的丰富,零基础的小白也有很好的机会逐步学习和掌握。【点击蓝字获取】

【2025最新】AI大模型全套学习籽料(可白嫖):LLM面试题+AI大模型学习路线+大模型PDF书籍+640套AI大模型报告等等,从入门到进阶再到精通,超全面存下吧!