药物抓取准确率97.3%!YOLO-EASB+IAFFGA-Net:如何让智能药房机器人靠视觉算法征服杂乱场景?

【 导读 】

针对药物形状多变、堆叠遮挡难题,本文提出 YOLO-EASB+IAFFGA-Net 多阶段框架,结合视觉增强与自适应算法:

-

图像预处理:改进SRCNN提升分辨率,强化细节;

-

分割优化:YOLO-EASB融合双注意力机制,精准定位遮挡药物(mAP 95.8%);

-

动态抓取:IAFFGA-Net预测位姿,机械臂轨迹规划时间缩短18%;

实际测试中,UR5机械臂对10类复杂药物(如胶囊、药盒)抓取成功率高达97.3%,响应速度满足实时需求。该方案为医疗自动化提供高鲁棒性技术路径,显著提升药房分拣效率与适应性。

论文题目:

Optimizing Drug Delivery in Smart Pharmacies: A Novel Framework of Multi-Stage Grasping Network Combined with Adaptive Robotics Mechanism

论文链接:

https://arxiv.org/pdf/2410.00753

目录

一、引言

二、方法

多级抓取网络结合自适应机器人机制的框架

多级抓取网络框架

基于仿真 SRCNN 的图像超分割预处理

YOLO-EASB实例分割模型

机械臂轨迹规划框架

三、Coovally AI模型训练与应用平台

无需代码,训练结果即时可见!

大模型加持,智能辅助模型调优!

千款模型+海量数据,开箱即用!

从实验到落地,全程高速零代码!

四、实验

实验设置

实例分割实验

结论

一、引言

现代医疗系统因患者激增和需求扩张,推动智能药房成为传统药房转型的关键方案。尽管智能药房通过机械臂和自动化设备提升了效率,但药品配送仍面临核心挑战:机械臂受限于药物形态多样性,难以应对动态配药场景,而主流的斜槽分拣法易导致药品无序堆叠、角度混乱,叠加数量与形状的随机性,进一步加剧机器人抓取难度。早期系统依赖固定程序与条形码识别,环境适应性薄弱,而计算机视觉技术的引入(如高分辨率摄像头结合AI算法)通过直接识别药品特征显著提升了灵活性与准确性。然而,在药品随机排列、过度搭接等复杂场景中,系统性能仍受限,动态环境下的实时调整能力不足,导致药房仍需依赖人工补足自动化缺陷。这一技术演进揭示了医疗自动化向智能化转型的路径,但复杂场景处理与系统自适应能力仍是当前突破的关键瓶颈。

我们工作的主要贡献如下:

-

新型多阶段抓取框架使用改进的超分辨率卷积神经网络(SRCNN)对图像进行预处理,从而提高了图像质量和模型预测速度。预处理后的图像被输入 YOLO-EASB 实例分割算法,该算法完善了 YOLOv5 spp 和 FPN 结构,并引入了自适应的双重关注机制,以便在混沌闭塞情况下进行准确的药物分割。通过评估分割掩码的完整性来确定最佳抓取药物,IAFFGA-Net 可确保精确抓取。

-

时间最优机械臂轨迹规划算法结合了蚁群算法和3-5-3间隔规划。它为粒子初始化引入了双混沌 Logit-Tent 映射,并采用非线性递减策略调整惯性权重,解决了标准粒子群算法中收敛过早和收敛缓慢的问题。

-

实现并验证了药物分发机器人系统能在混沌和障碍环境中准确抓取不同形状和类型的药物,最接近真实的智能药房药物分发环境。它在实际应用中表现出了明显的适应性和有效性。

二、方法

-

多级抓取网络结合自适应机器人机制的框架

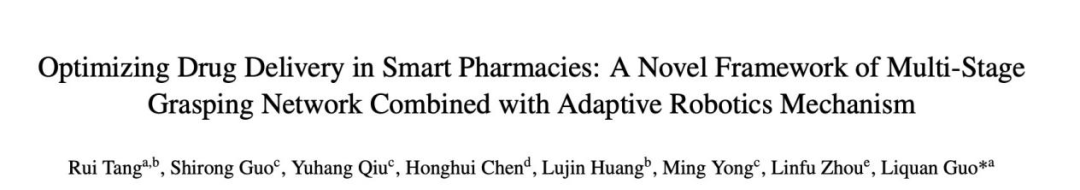

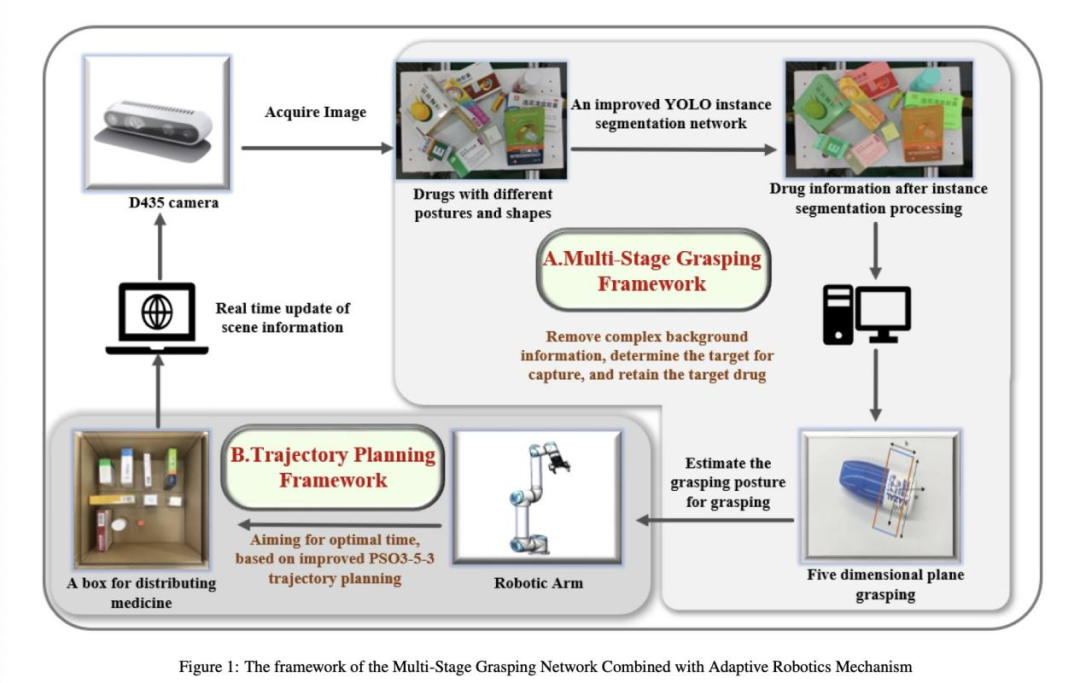

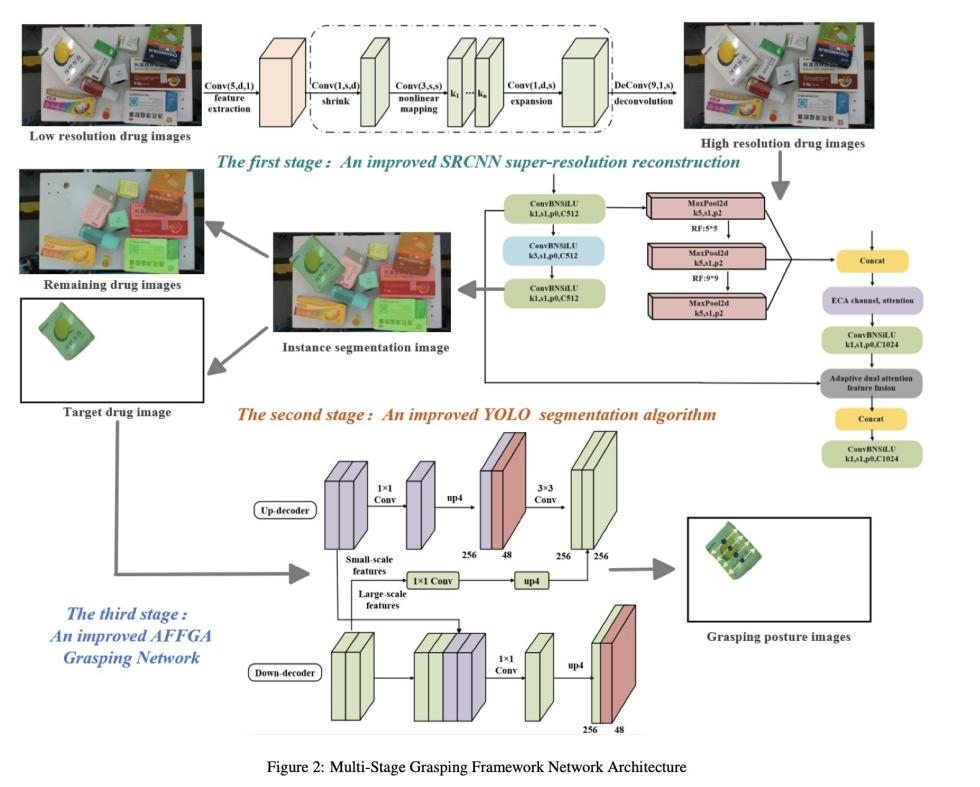

如图 1 所示,本文提出了一种综合的抓取系统架构,该架构集成了 SRCNN改进算法、YOLO-EASB 和 IAFFGA- Net,以实现对药盒的精确抓取。首先,D435 双目摄像头捕捉杂乱和重叠的药品。然后,多级抓取网络框架抓取药品。利用优化的粒子群算法对机械臂轨迹进行动态规划,使抓取网络能够在有限的时间内找到到达抓取位置的最佳路径,并将抓取过程中的潜在风险降至最低。总之,通过多级技术的协同效应,所提出的抓取保护系统架构成功地实现了复杂环境下药物抓取操作的准确、高效和稳定。

-

多级抓取网络框架

AFFGA-Net在检测过程中会消耗大量计算资源,复杂的背景信息也会降低其准确性。为此,首先使用超分割技术重建原始图像,然后将高分辨率图像输入 YOLO- EASB。这一过程消除了复杂的背景信息,提取出需要抓取的物体轮廓。然后将目标对象的遮罩作为中间图像输入 IAFFGA-Net。这种方法大大提高了操作速度,减少了环境对目标的影响,从而提高了抓取精度。网络结构如图 2 所示。

-

基于仿真 SRCNN 的图像超分割预处理

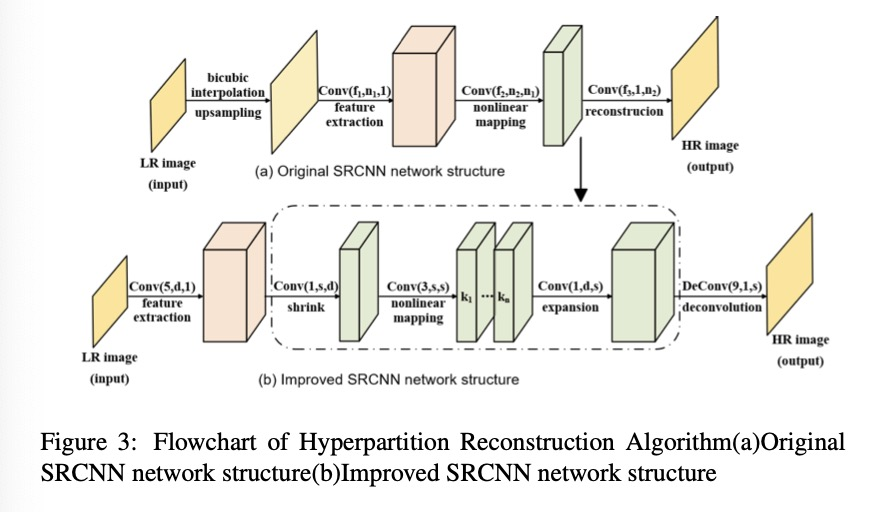

SRCNN 算法

对药物图像进行超分辨率重建可以有效提高后续药物分割的准确性。基于深度学习的 SRCNN 超分辨率重建方法主要包括四个部分:上采样、特征提取与表示、非线性映射和重建。如图 3(a)所示,该方法首先使用双三次插值算法对原始低分辨率(LR)图像进行预处理,将原始输入图像的比例放大到设定比例。然后对放大的低分辨率图像进行卷积运算,得到高维(n1 维)特征向量表示。该 n1 维特征向量被映射为 n2 维特征向量,用于重建高分辨率特征表示。最后,通过对预测的重叠高分辨率块进行平均,得到重建的高分辨率(HR)图像。与传统建模方法相比,SRCNN 可获得更高的重建图像质量,但依赖于图像区域信息,推理速度较慢。

改进的 SRCNN 算法

为满足获取高分辨率图像时对实时性的要求,提出了改进的 SRCNN 算法。该算法不对输入图像进行二次插值,而是使用原始低分辨率图像作为输入,并在

网络末端引入反卷积层进行上采样。此外,SRCNN 中的非线性映射层被收缩、映射和外扩散操作所取代,利用了更小的卷积核和更深的网络结构。与原始模型相比,这种方法收敛更有效,从而在保持较高重建质量的同时降低了误差。图 3(b) 所示为经过验证的算法流程。

-

YOLO-EASB实例分割模型

由于药品形态多变、尺度差异显著且背景环境复杂,导致药品实例分割精度较低。为此提出基于YOLOv5改进的药品实例分割方法,下文将详细介绍对YOLOv5中SPP模块的改进以及构建BiFPN跨尺度特征融合网络的具体方法。

E-A-SPPFCSPC模块

多尺度药品处理会导致模型难以捕捉细节信息,且计算量增加会降低检测速度。为增强模型处理不同尺度目标的能力,同时减少计算量并提高检测速度,将YOLOv5中的SPPF模块替换为包含空间金字塔池化、快捷连接和跨阶段部分网络(CSPNet)的SPPFCSPC模块。基于SPPFCSPC模块生成的多尺度特征,引入高效通道注意力(ECA)和提出的自适应双注意力特征融合(ADaFF)模块。这些模块使模型能自适应分配各通道响应权重,在部分遮挡时突出非遮挡区域关键特征,有效实现跨层特征整合并抑制冗余,使网络既能从深层网络提炼高级抽象特征,又能充分利用浅层输入的精细纹理信息。

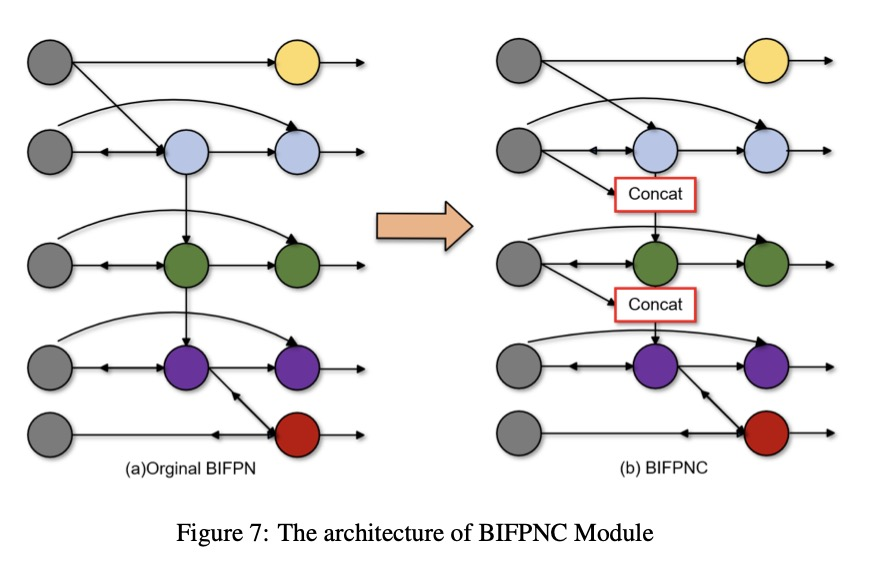

BiFPNC结构

原YOLOv5特征融合网络采用FPN(Lin et al., 2017a)+PAN结构,通过级联方式将特征图融合至相同分辨率,限制了特征信息的充分利用。针对药品目标类别多样、尺寸差异大且形状复杂的问题,在FPN+PAN特征融合网络基础上引入BiFPN进行改进,以实现深层语义信息与浅层空间信息更全面的交互。

如图7(a)所示,原始BiFPN通过引入学习参数来表达各输入特征图的权重,使模型能学习训练过程中哪些特征层更重要,通过对权重归一化实现高效特征融合。但BiFPN在特征权重选择时倾向于上层特征,可能导致融合过程忽略浅层特征的重要信息,特别是对目标检测和分割至关重要的细粒度细节。

因此本文提出通过跳跃连接增强特征融合的策略,如图7(b)所示。通过将浅层特征直接引入深层特征融合,使网络不仅考虑前一层的特征,还兼顾初始层的特征,从而同时利用高层语义信息和低层空间信息。通过将浅层特征与加权归一化的深层特征拼接,有效保留浅层特征,扩展特征图的表征能力,使网络能在更大范围内捕捉目标药品的细节,提升对边界和纹理的感知能力。

-

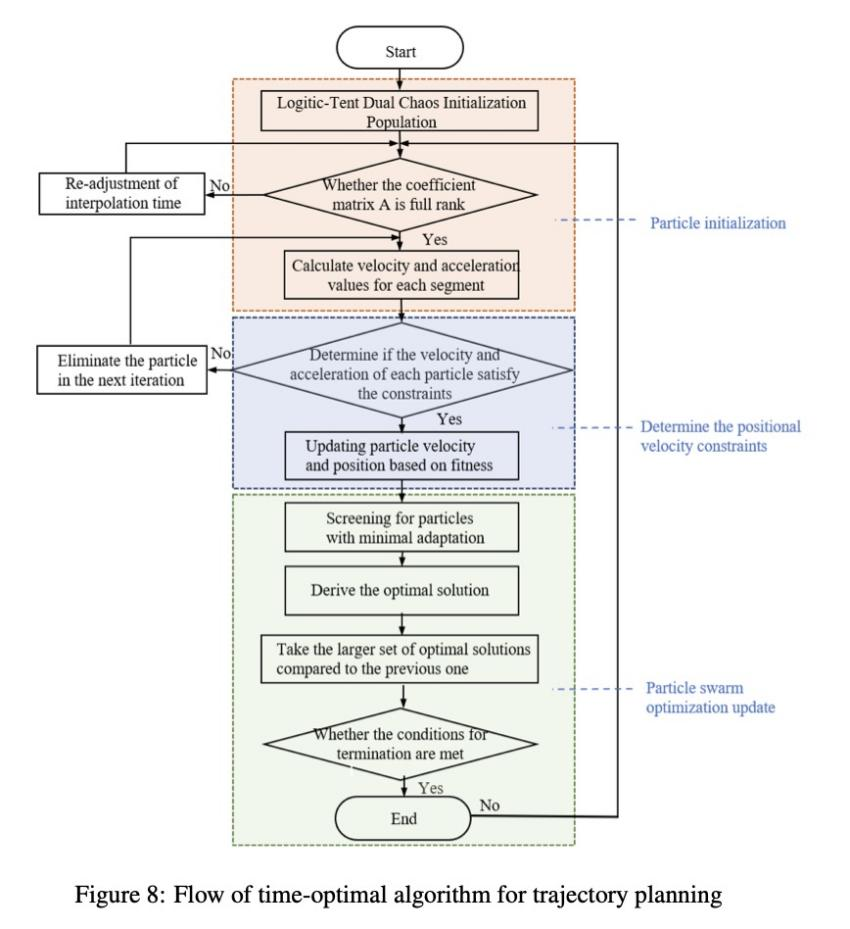

机械臂轨迹规划框架

为提高机械臂抓取轨迹的平滑性与稳定性,同时优化作业时间,提出采用改进PSO粒子群算法优化3-5-3分段多项式插值时间的轨迹规划方法,以满足机械臂运行速度和加速度约束。首先构建3-5-3分段多项式插值函数,然后基于各段插值时间建立目标函数,最后在预设约束条件下采用改进PSO粒子群算法优化插值时间,以最小化机械臂作业时间。算法流程如图8所示。

三、Coovally AI模型训练与应用平台

你是否也想要使用模型进行训练或改进,Coovally——新一代AI开发平台,为研究者和产业开发者提供极简高效的AI训练与优化体验!

-

无需代码,训练结果即时可见!

在Coovally平台上,上传数据集、选择模型、启动训练无需代码操作,训练结果实时可视化,准确率、损失曲线、预测效果一目了然。无需等待,结果即训即看,助你快速验证算法性能!

-

大模型加持,智能辅助模型调优!

若对模型效果不满意?Coovally即将推出大模型智能调参能力,针对你的数据集与任务目标,自动推荐超参数优化方案,让模型迭代事半功倍!

-

千款模型+海量数据,开箱即用!

平台汇聚国内外开源社区超1000+热门模型,覆盖YOLO系列、Transformer、ResNet等主流视觉算法。同时集成丰富公开数据集,涵盖图像分类、目标检测、语义分割等场景,一键下载即可投入训练,彻底告别“找模型、配环境、改代码”的繁琐流程!

-

从实验到落地,全程高速零代码!

无论是学术研究还是工业级应用,Coovally均提供云端一体化服务:

✅ 免环境配置:直接调用预置框架(PyTorch、TensorFlow等);

✅ 免复杂参数调整:内置自动化训练流程,小白也能轻松上手;

✅ 高性能算力支持:分布式训练加速,快速产出可用模型;

✅ 无缝部署:训练完成的模型可直接导出,或通过API接入业务系统。

!!点击下方链接,立即体验Coovally!!

平台链接:https://www.coovally.com

无论你是算法新手还是资深工程师,Coovally以极简操作与强大生态,助你跳过技术鸿沟,专注创新与落地。访问官网,开启你的零代码AI开发之旅!

四、实验

本节介绍验证所提多阶段抓取框架的实验设置与结果,包括药品选择、数据集准备和性能评估。通过准确率、精确率和召回率等关键指标,结合机械臂轨迹规划和抓取检测网络的性能测试,验证系统处理复杂药品分拣任务的有效性。实验结果证明该系统在真实场景下具有显著的抓取准确性、效率和适应性提升。

-

实验设置

-

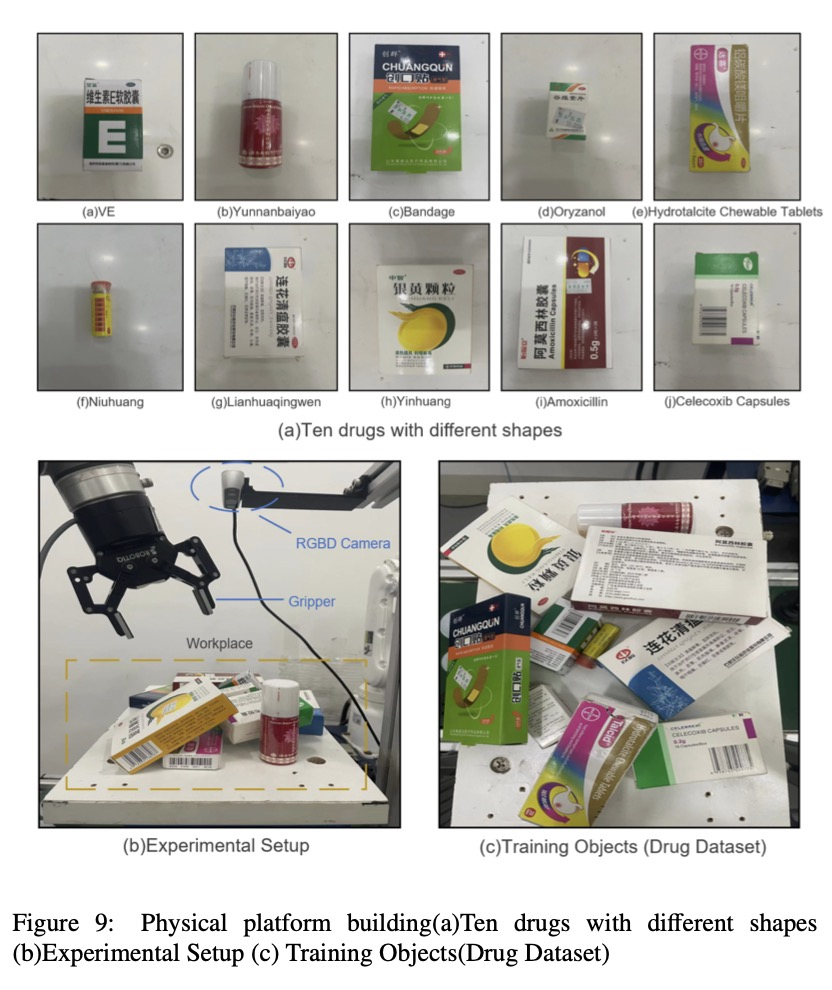

药品选择与实物平台搭建

实际实验选取中国某药房的10种常见药品(如图9(a))评估模型性能,包括云南白药、创可贴、谷维素、铝碳酸镁咀嚼片、牛黄解毒颗粒、连花胶囊、银黄颗粒、阿莫西林、维生素E胶囊和塞来昔布胶囊。药品形态各异:多个长宽高不同的长方体,以及直径高度不同的圆柱体。拍摄地点为中国福建泉州(北纬24°52′32.0″,东经118°40′20.5″)。采用安装在实验药品分拣平台上的D435相机采集药品图像,初始图像尺寸为640像素×480像素,共采集600张图像构建数据集,图像格式为RGB。

长方体药品因形状规则易堆叠,边缘和表面紧密接触。这会导致遮挡,使得边缘检测困难,特别是当颜色纹理相似时,遮挡部分可能被误判为背景或其他药品。长方体和圆柱体药品的不规则遮挡都会带来复杂边缘检测和形状识别问题。圆柱体药品因曲面特性,其遮挡可能被识别为曲线部分,堆叠时易滚动导致堆叠稳定性低于长方体药品。实物实验平台如图9(b)所示,药品图像由固定在UR5机械臂末端的Realsense D435相机获取,二指夹爪用于抓取。药品摆放如图9(c)所示,以不同姿态相互重叠。

-

自建药品数据集

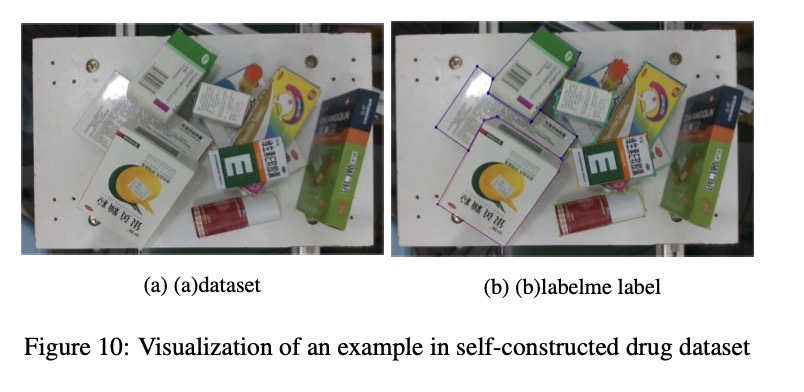

本任务使用的药品检测数据集为自定义数据集,由安装在实验药品分拣平台上的D435相机拍摄的640像素×480像素图像组成。如图10所示,每幅图像包含1-10个堆叠物体,共600张图像并使用LabelMe标注。数据集按7:2:1比例划分,训练集420张,测试集120张,验证集60张。

-

实验配置

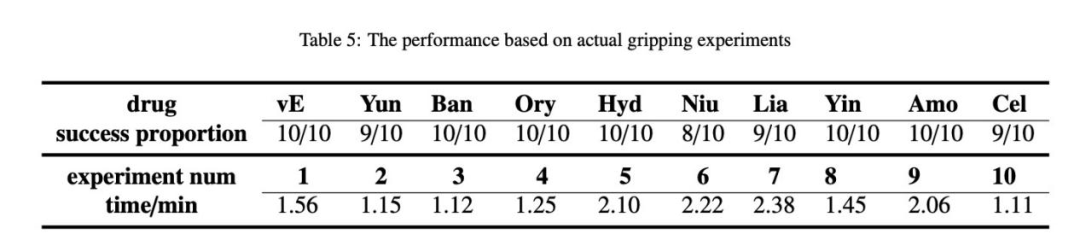

本研究采用Ubuntu 20.04系统,Intel(R) Core(TM) i5-8500 CPU,16GB内存,NVIDIA GeForce RTX 3060 GPU(8GB显存)。使用Python 3.8和PyTorch 1.9.1作为深度学习框架。实验数据集中药品名称采用前三个字母缩写:云南白药(Yun)、创可贴(Ban)、谷维素(Ory)、铝碳酸镁(Hyd)、牛黄解毒颗粒(Niu)、连花胶囊(Lia)、银黄颗粒(Yin)、阿莫西林(Amo)、维生素E胶囊(VE)和塞来昔布胶囊(Cel)。

-

实例分割实验

-

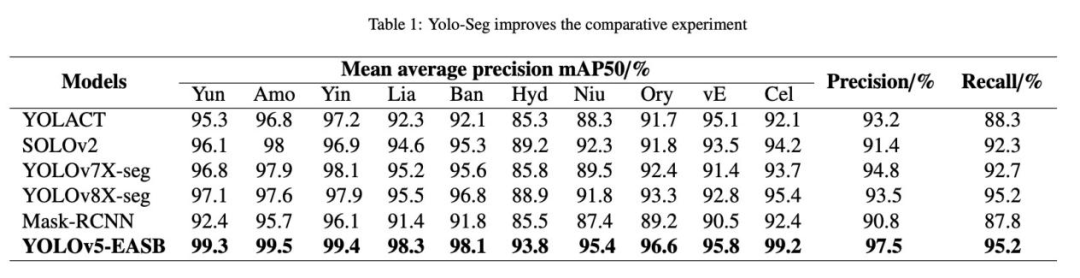

对比实验

为验证模型性能,在相同环境下将基于改进YOLOv5的YOLO-EASB模型与YOLOACT(Bolya et al., 2019)、SOLOv2(Wang et al., 2020)、YOLOv7-seg(Wang et al., 2023)、YOLOv8-seg(Dumitriu et al., 2023)及Mask-RCNN(He et al., 2017)等主流实例分割算法模型进行对比,结果如表1和表2所示。可见本章方法在mAP50、精确率和召回率指标上均优于其他方法,较现有流行模型YOLOv7X-seg和YOLOv8X-seg分别获得2.7%和4%的精确率提升,以及2.9%和2.5%的召回率提升。相比经典模型Mask-RCNN,精确率提高6.7%,召回率提高7.4%。与单阶段方法YOLACT和SOLOv2相比,本章模型精确率分别高出4.3%和6.1%。这些结果表明本文YOLO-EASB模型取得了良好分割性能,但在VE等小目标药品分割上mAP仅95.8%,为模型后续改进指明了方向。

-

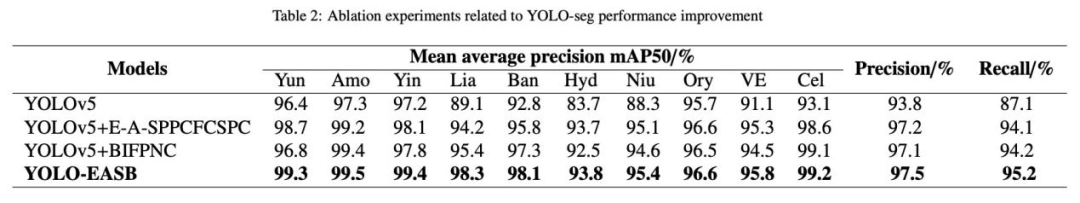

消融实验

本小节通过消融研究评估YOLO-EASB各组件对性能的影响,所有网络均在自建药品数据集上训练测试,结果如表所示。引入SPPCFCSPC和BiFPNC可不同程度提升mAP,具体而言,YOLOv5+E-A-SPPCFCSPC和YOLOv5+BiFPNC相比YOLOv5分别提升药品分割精度3.4%和3.3%。本文提出的改进方案相比YOLOv5提升药品分割精度3.7%,证明YOLO-EASB能有效提升药品相互遮挡场景下的实例分割能力。如表1和表2所示,YOLO-EASB相比单独引入各模块的实例分割算法具有更高召回率、mAP和精确率。

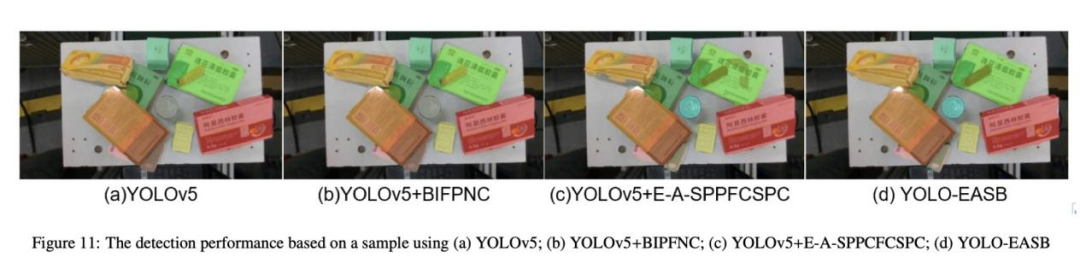

结果可视化显示:对于圆柱形药品云南白药,YOLOv5和YOLOv5+BIFPNC均因药品圆柱表面接近白色与背景色相似而干扰模型识别,导致漏检。yolov5+E-A-SPPFCSPC模型的分割结果如图11(c)所示,虽检测到云南白药,但对药品达喜的边缘分割不均。图11(d)表明YOLO-EASB模型能有效进行实例分割并清晰分割全部药品。通过可视化验证,YOLO-EASB模型对包含重叠和视觉相似药品的图像处理效果显著更优。

-

抓取检测网络实验

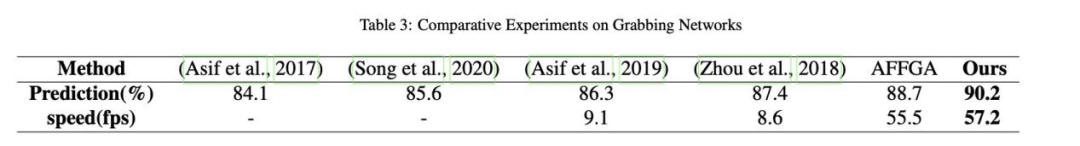

表3将IAFFGA-Net与代表性平面抓取检测方法在相同实验条件下的公开Cornell数据集进行对比。该数据集为自建药品数据集,所选抓取检测方法的数据输入格式均与本文方法相同采用RGB格式。Focal Loss参数设为α=0.25和Γ=2。结果表明在杂乱重叠场景下,本文提出的IAFFGA-Net相比其他抓取网络具有更高准确率且检测速度略快。

-

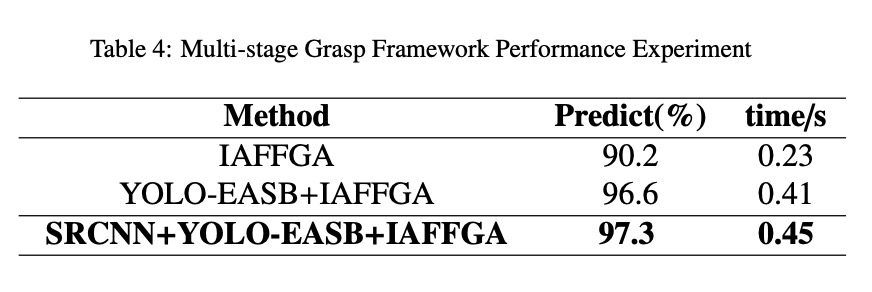

多阶段抓取框架性能

为验证本文提出的多阶段抓取框架,分别对IAFFGA、YOLO-EASB+IAFFGA和SRCNN+YOLO-EASB+IAFFGA进行性能测试,结果如表4所示。由表4可见,多阶段抓取框架在数据集图像上的准确率达到97.3%,虽然运行时间有所增加,但仍满足本文讨论的智慧药房药品分拣场景的实时性需求。

-

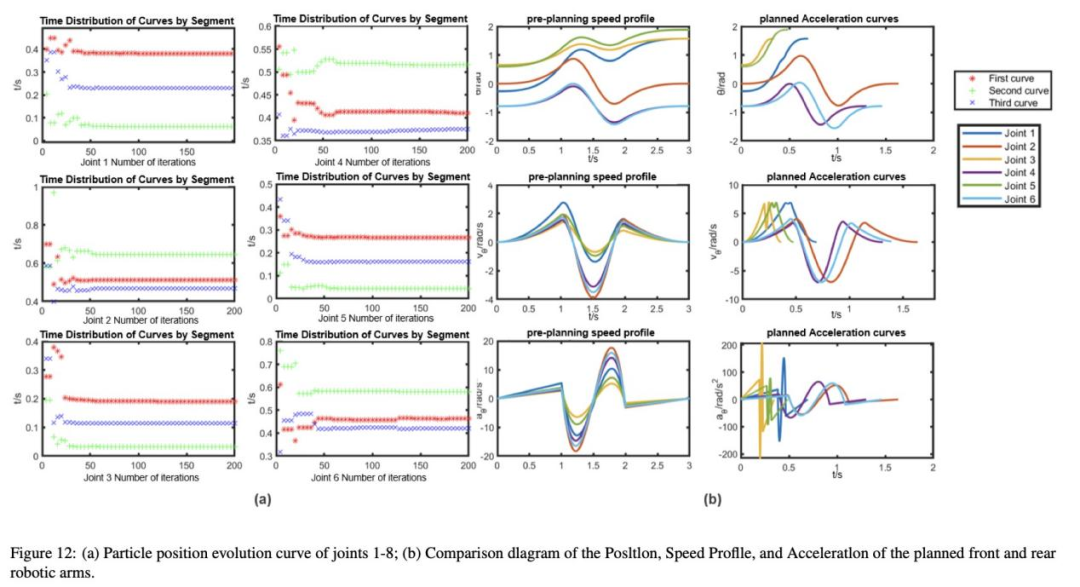

机械臂轨迹规划仿真实验

实验过程中改进粒子群算法约25次迭代即实现渐近收敛,而标准粒子群算法约需55次迭代,表明改进粒子群算法效率提升45%。图12(a)展示了通过求解时间优化问题获得的机械臂各关节优化后的3段插值时间值。

同时对比规划前后机械臂位置、速度和加速度情况,如图12(b)所示。可见改进粒子群算法优化下的机械臂位移、速度和加速度曲线连续无突变,表明能平滑通过各路径点,且机械臂各关节速度加速度均满足给定约束。同时时间减少1.1秒,显著提升系统抓取效率。

-

实际系统抓取实验

本文开发了由UR5机械臂、二指机械夹爪和D435深度相机组成的机械臂抓取检测系统。实验台面上方安装D435深度相机获取高质量RGB-D信息。实验设置如图13所示,机械臂从初始位置出发,接收相机传感器位置信息后移动至药品分拣区域进行抓取,随后记录各药品成功抓取次数。并与AFFGA-Net进行对比,实际抓取实验结果如表5所示。

表中显示实际抓取实验中,vE、Ban、Ory、Hyd、Yin和Amo达到100%成功率,而Yun、Lia和Cel十次实验中出现一次抓取失败。此外较小圆柱体药品Niu出现两次抓取失败,说明需提升本抓取检测网络对小目标和圆柱体的性能,这仍是未来工作目标。实验室测试中为安全考虑将机械臂速度限制在250毫米/秒,十次实验中抓取十粒药品最高耗时2.38分钟,满足实时操作需求。

结论

本文开发并评估了一种集成先进软件算法与硬件功能的创新型智能药品分拣系统,以解决智慧药房中的复杂抓取难题。提出采用改进SRCNN模型对药品图像进行超分辨率重建的多阶段抓取框架,提升特征捕获准确性,为抓取决策提供清晰视觉输入。提出YOLO-EASB实例分割模型实现药品高精度空间定位与特征提取,经目标药品分割、背景剔除后输入IAFFGA-net获取药品抓取角度与宽度。为解决机械臂轨迹平滑与执行效率问题,采用改进PSO算法进行时间优化,提升系统作业能力并确保轨迹规划的平滑高效。实验结果证明多阶段抓取框架在优化智慧药房作业方面的优越性。相比现有方法,本系统在复杂环境中实现高精度实时药品分拣,准确率和效率显著提升,在实际应用中展现出卓越的适应性和有效性。

未来工作将重点优化对小目标和圆柱体药品的抓取性能,将系统扩展至更多药品类型和更复杂药房环境。为此将探索领域自适应技术(Qiu et al., 2024)以增强模型在不同药房设置中的泛化能力,确保即使遇到训练时未覆盖的新药品类型或操作条件仍能保持稳健性能。此外将通过硬件加速和算法优化提升实时处理能力,并探索人机协作以增强系统灵活性和智能性。