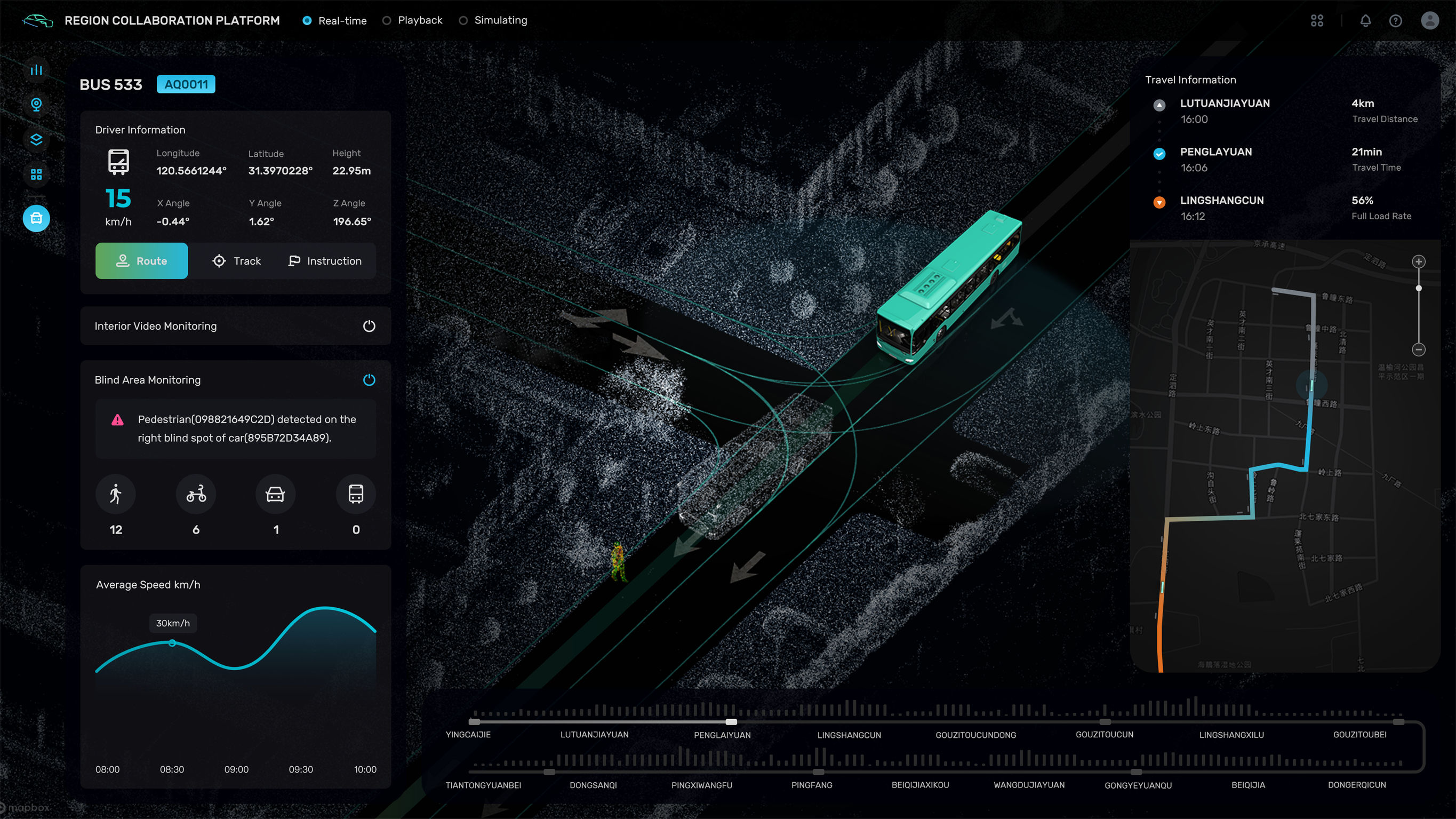

数字孪生技术为UI前端赋能:实现产品性能的实时监测与预警

hello宝子们...我们是艾斯视觉擅长ui设计、前端开发、数字孪生、大数据、三维建模、三维动画10年+经验!希望我的分享能帮助到您!如需帮助可以评论关注私信我们一起探讨!致敬感谢感恩!

过去十年,前端技术栈翻天覆地:React/Vue/Angular、Webpack/Vite、Serverless、微前端……但有一个顽疾始终没被根治——“用户侧黑盒”。

- 真实用户网络千差万别:5G/4G/3G、Wi-Fi/长宽/校园网;

- 设备碎片化:旗舰机、千元机、老旧安卓、iOS 越狱机;

- 运行时环境:浏览器插件、小程序容器、WebView 内核版本。

任何一个变量都可能让精心调优的页面“现场翻车”。传统做法是:

- 埋点上报 → 2. 离线分析 → 3. 第二天定位 → 4. 发版修复。

这套流程平均耗时 24~72 小时,期间用户流失、品牌受损。

数字孪生(Digital Twin)带来的最大颠覆,是把“事后分析”压缩成“毫秒级镜像+秒级预警”,让前端工程师第一次有机会“在火还没烧起来时就把它扑灭”。

数字孪生:把“物理产品”搬到“云端镜像”

2.1 定义再通俗化

数字孪生 = 物理实体的高保真数字化复制 + 实时双向数据流。

在前端领域,“物理实体”就是跑在用户终端上的真实页面;“数字化复制”则是在云端或边缘节点运行的“影子页面”。影子页面具备三大特征:

- 行为一致性:DOM 结构、JS 执行路径、网络请求 1:1 映射;

- 状态同步:滚动位置、输入框内容、内存/CPU/网络指标实时回传;

- 干预能力:可在孪生体中做“假设实验”,再把最优策略下发到真实端。

2.2 与“传统埋点”的本质区别

传统埋点是“采样+聚合”,数字孪生是“镜像+回放”。

- 采样:1000 个用户里挑 1% 上报,可能漏掉极端场景;

- 镜像:1000 个用户对应 1000 个影子,颗粒度到“单个用户会话”。

实时性能监测:让前端页面长出一双“透视眼”

3.1 监测维度全景

- 网络:DNS、TCP、TLS、首包、传输、HTTP/2 复用率;

- 渲染:FP、FCP、LCP、CLS、FID、TTI;

- 运行时:主线程阻塞、长任务、内存泄漏、FPS、卡顿帧;

- 业务:接口成功率、超时率、重试率、异常日志。

3.2 采集技术栈

(1) 浏览器端 SDK

- PerformanceObserver + Long Tasks API;

- requestAnimationFrame 自行计算 FPS;

- WebGL context loss 事件监听 GPU 崩溃;

- SendBeacon + CompressionStream(gzip/br)批量上报。

(2) 影子端(Node.js 环境) - puppeteer-cluster 启动无头 Chrome;

- chrome-launcher 复用 DevTools Protocol 采集 Tracing;

- 通过 WebSocket 与真实端保持心跳同步。

3.3 数据通道与协议

- 协议:基于 MQTT over WebSocket,保持长连接;

- 序列化:Protocol Buffers 压缩,节省 60% 流量;

- QoS:重要指标(崩溃、白屏)QoS=2,普通指标 QoS=0。

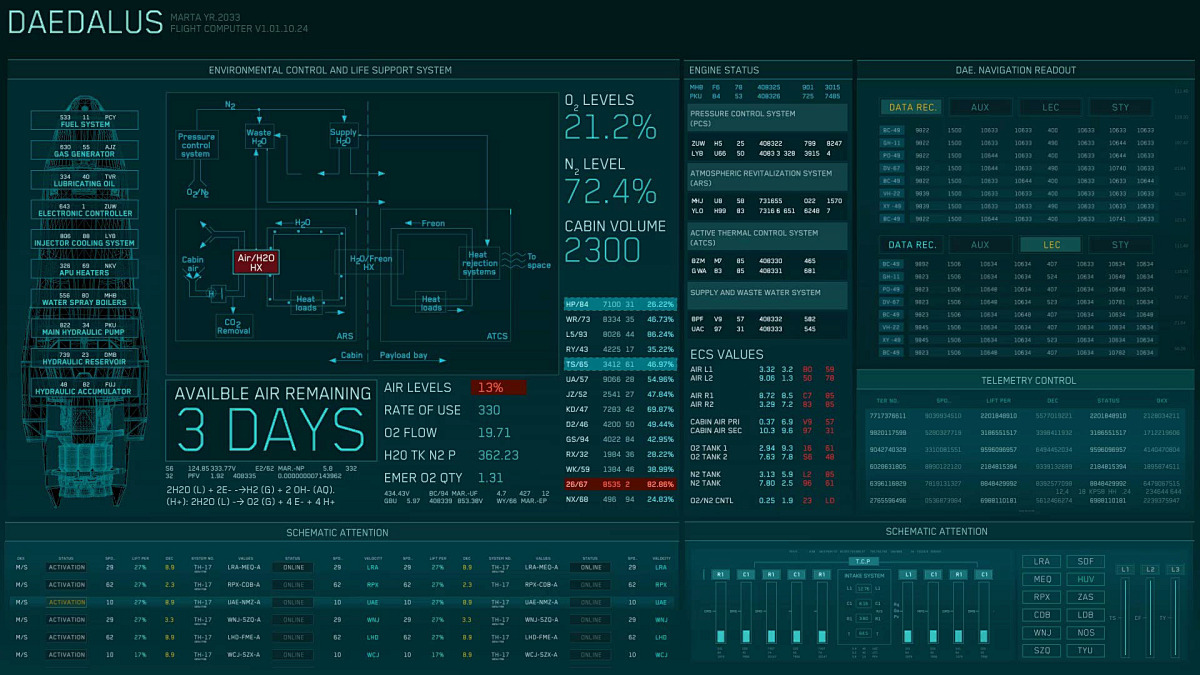

预警体系:从“事后告警”到“事前干预”

4.1 规则引擎

- 静态阈值:LCP > 2.5s、CLS > 0.1、接口超时率 > 5%;

- 动态阈值:基于 Holt-Winters 时序预测,自动调整基线;

- 机器学习:Isolation Forest 检测多维指标异常(GPU 内存+接口延迟+FPS 同时抖动)。

4.2 干预动作矩阵

表格

复制

预警级别 | 触发条件 | 自动化动作 | UI 前端反馈 | 人工确认 |

L0 提醒 | 单用户异常 | 上报日志 | 无 | 否 |

L1 通知 | 5% 用户受影响 | 钉钉/Slack 告警 | 小黄条提示“网络不佳” | 否 |

L2 干预 | 20% 用户受影响 | CDN 切流、回滚静态资源 | 弹窗“正在优化体验” | 可配置 |

L3 熔断 | 关键指标雪崩 | 自动降级到简化版页面 | 全屏遮罩+一键刷新 | 是 |

4.3 干预通道

- Service Worker:下发缓存策略,强制预加载关键脚本;

- Edge Config:通过 Vercel/Cloudflare Edge Middleware 控制回源比例;

- 小程序:利用微信/支付宝云函数动态下发分包加载顺序。

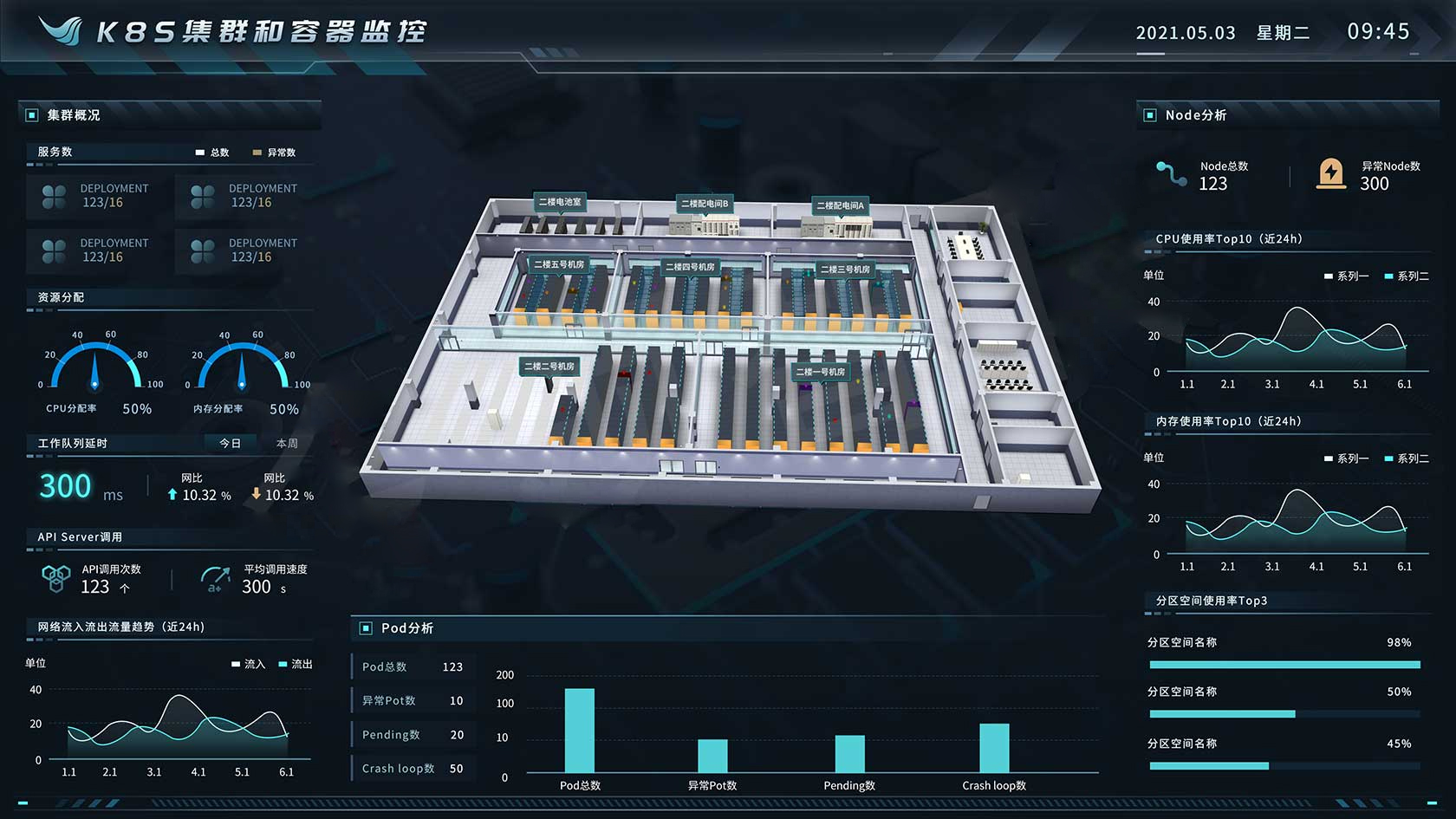

技术落地全景:架构、选型、关键代码与踩坑

5.1 整体架构图

真实端(浏览器/小程序) ←→ 边缘网关(Nginx+MQTT) ←→ Kafka ←→

→ 孪生集群(容器化 Puppeteer) ←→ 实时计算(Flink) ←→ 规则引擎 ←→

→ 告警通道 ←→ 前端可视化(React+WebGL)。

5.2 关键代码片段

(1) SDK 初始化

TypeScript

复制

import { TwinSDK } from '@digital-twin/web-sdk';

TwinSDK.init({projectId: 'shop-2024',endpoint: 'wss://twin-gateway.xxx.com/mqtt',sampleRate: 1, // 全量镜像rules: ['lcp>2500', 'cls>0.1', 'api-timeout>5%']

});(2) 影子端创建会话

JavaScript

复制

// Node.js 端

const browser = await puppeteer.launch({args: ['--use-gl=swiftshader', '--no-sandbox'],defaultViewport: { width: 375, height: 667 } // 与真机一致

});

const page = await browser.newPage();

await page.evaluateOnNewDocument(() => {window.navigator.__defineGetter__('userAgent', () => 'CustomUA');

});(3) 规则引擎 DSL

yaml

复制

rule: apiErrorSpike

expr: |rate(http_requests_total{status=~"5.."}[2m]) > 0.05

actions:- type: pushGatewaylevel: L2- type: swMessagepayload: '{"cmd":"preload","urls":["/static/vendor.js"]}'踩坑与对策

- 影子资源消耗:Chrome 无头实例单机 1k 并发即 CPU 满载 → 采用 Serverless 容器,按需弹性到 0。

- 时钟漂移:真实端与影子端时间戳不一致 → 引入 NTP + Lamport Clock 双保险。

- 跨域限制:孪生体需模拟登录态 → 使用 Chrome DevTools 的 Network.setExtraHTTPHeaders 注入 Cookie。

案例深剖:某电商平台从 0 到 1 的孪生改造

6.1 背景

- 场景:大促期间商品详情页(SKU 4 万+,日均 PV 8000 万)。

- 痛点:首屏 LCP 波动大,3G 网络下白屏率 2.8%,人工定位平均耗时 4 小时。

6.2 实施步骤

- 埋点瘦身:将原有 43 个埋点事件缩减到 6 个核心指标,SDK 体积从 120 KB 降到 38 KB;

- 影子集群:Kubernetes 部署 200 个 Puppeteer Pod,按地域(华北、华南、北美)就近调度;

- 规则落地:

- LCP > 2.5s 且 3G 网络 → 触发 CDN 边缘降级,把 2 MB 的 WebP 切成 200 KB 的 Progressive JPEG;

- 接口错误率 > 3% → Service Worker 立即把商品图切换成占位符,优先保证可购买流程。

6.3 效果

- 白屏率从 2.8% 降到 0.6%;

- 异常定位时长从 4 小时降到 3 分钟;

- 大促期间因体验问题导致的订单流失减少 12%。

未来展望:AIGC+数字孪生的下一代体验运营

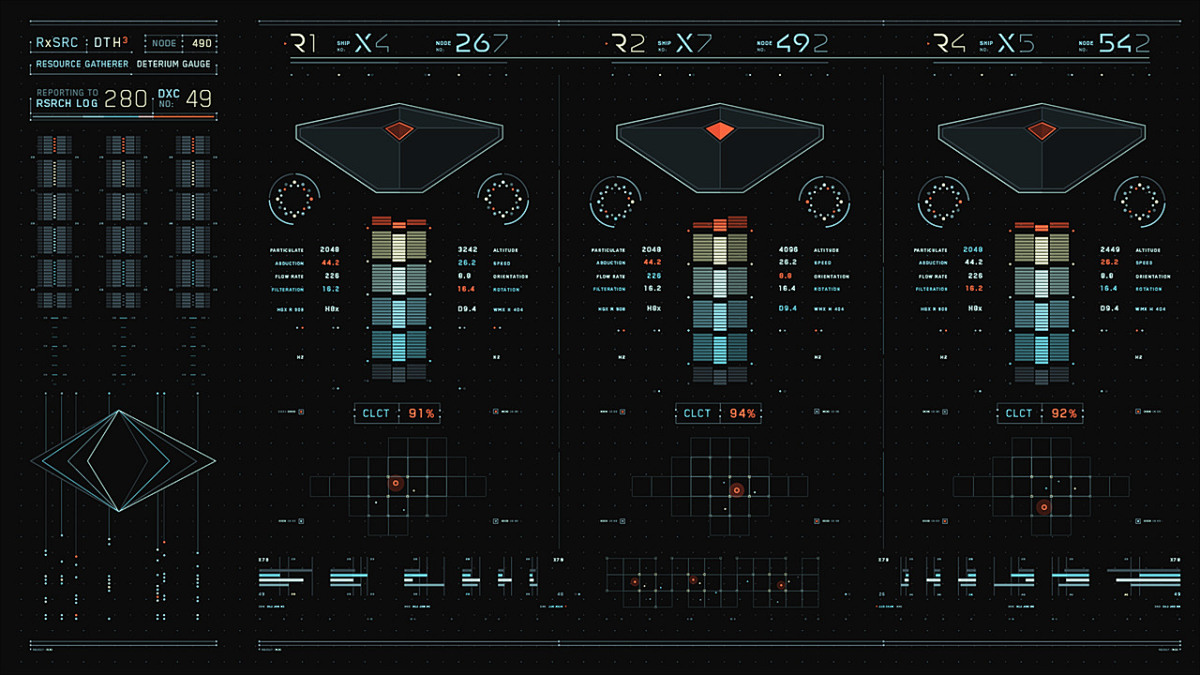

- AIGC 生成“千人千面”的影子:基于用户画像自动拼装差异化 UI,孪生体提前跑一遍性能,确保个性化不降低体验。

- LLM 驱动的根因分析:告警触发后,由大模型直接解读火焰图、链路追踪,输出“人话版”事故报告。

- 边缘孪生:把影子下沉到 5G MEC,延迟 <10 ms,实现“本地发现、本地修复”,连中心机房告警都省了。

结语:把不确定性关进笼子里

数字孪生对 UI 前端最大的价值,是把“不可见的用户现场”搬到“可控的云端实验室”。

当每一个 DOM 变动、每一次 API 抖动都能在孪生体提前演练,我们就可以:

- 把“用户抱怨”变成“系统自检”;

- 把“通宵救火”变成“秒级修复”;

- 把“经验主义”变成“数据驱动”。

别再等用户打电话来骂人了——让他在感知卡顿之前,我们就已经把补丁推到了他的浏览器。

hello宝子们...我们是艾斯视觉擅长ui设计、前端开发、数字孪生、大数据、三维建模、三维动画10年+经验!希望我的分享能帮助到您!如需帮助可以评论关注私信我们一起探讨!致敬感谢感恩!