【13-向量化-高效计算】

研究者能够扩展神经网络并构建非常大型网络的原因之一,就是神经网络可以被向量化,vectorized;可以非常高效地用矩阵地乘法实现。

事实上,并行计算硬件,例如GPU,一些CPU的功能,非常擅长进行非常大的矩阵乘法,矢量化的神经网络是如何工作的。

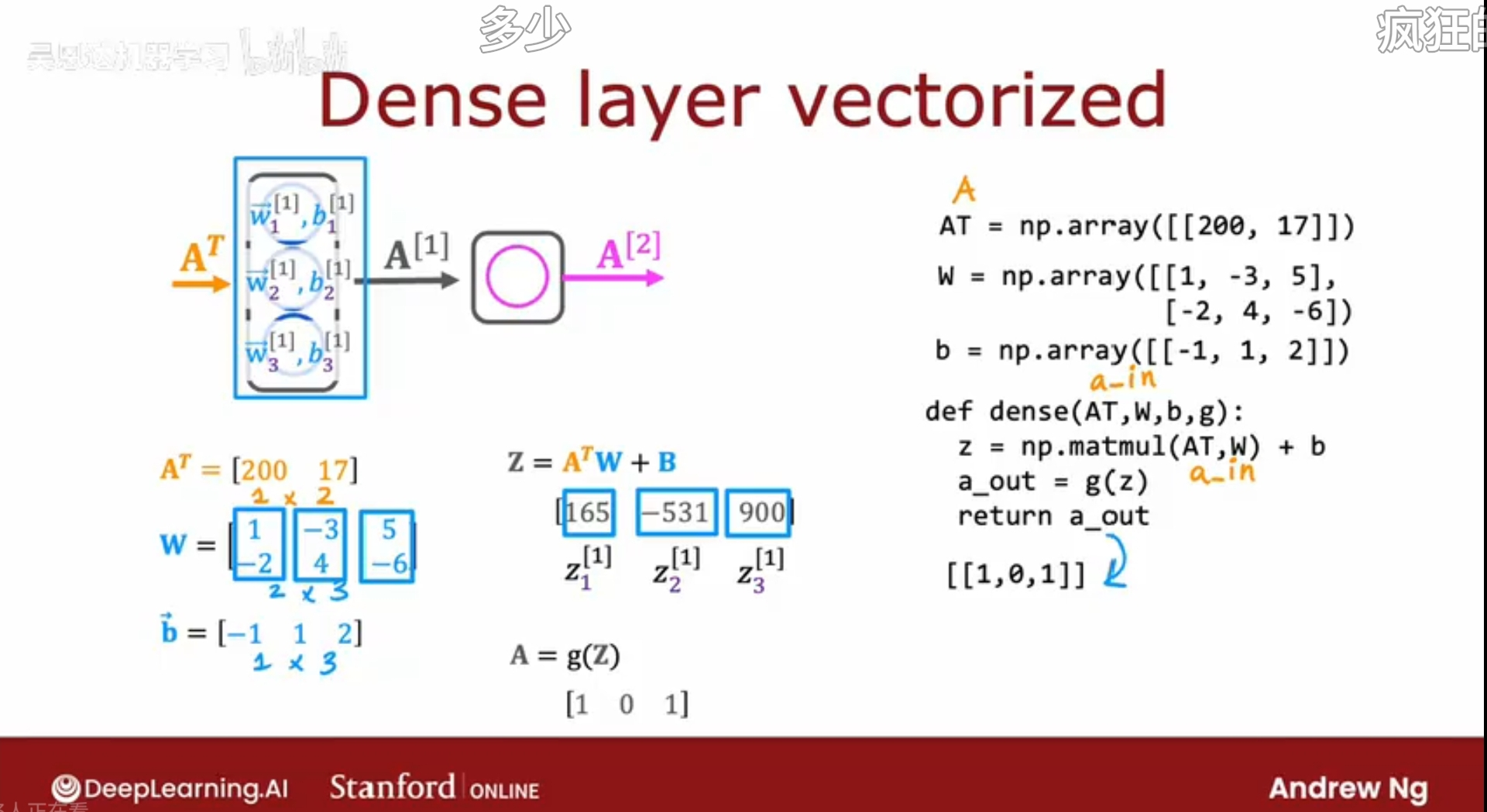

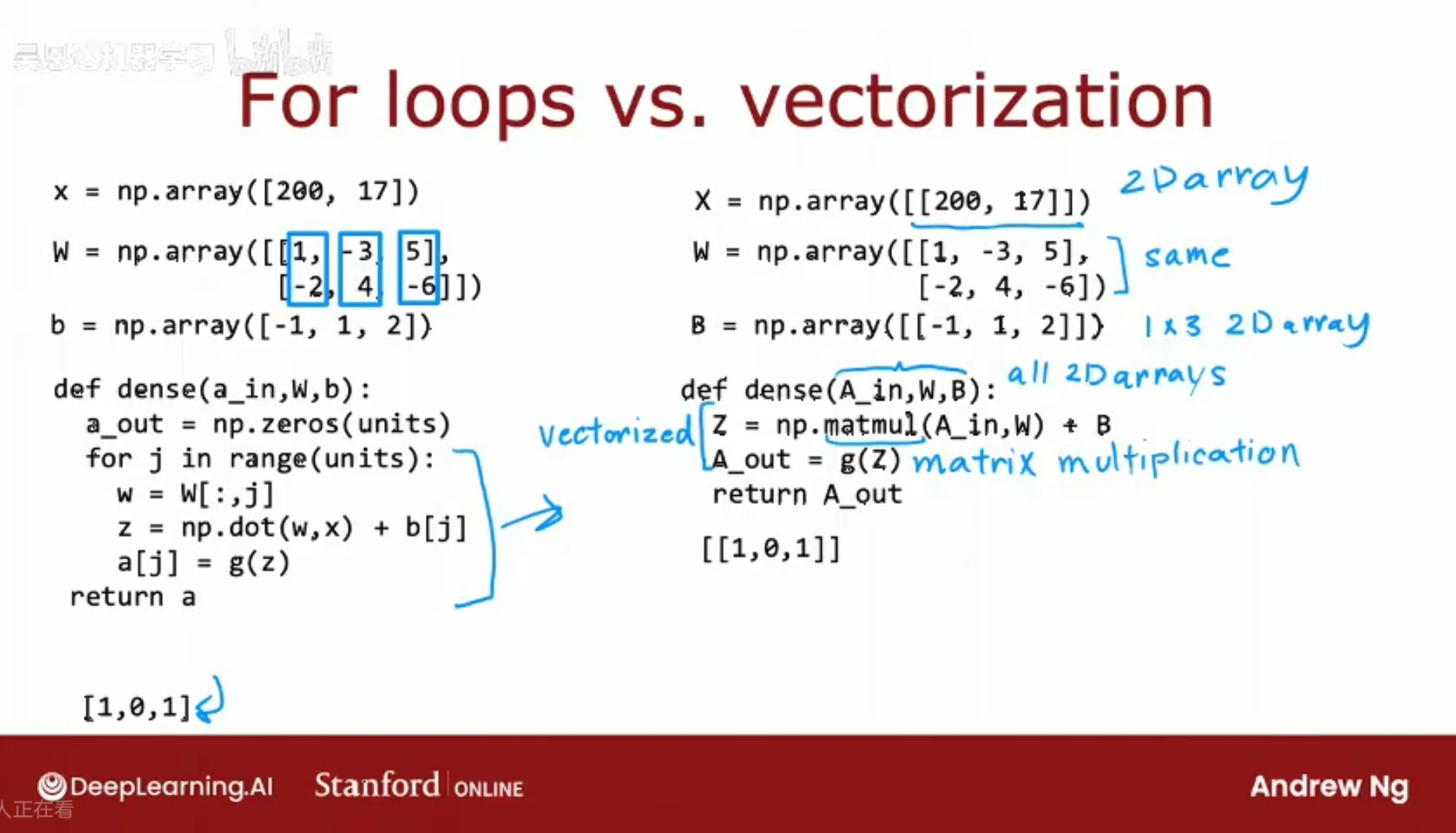

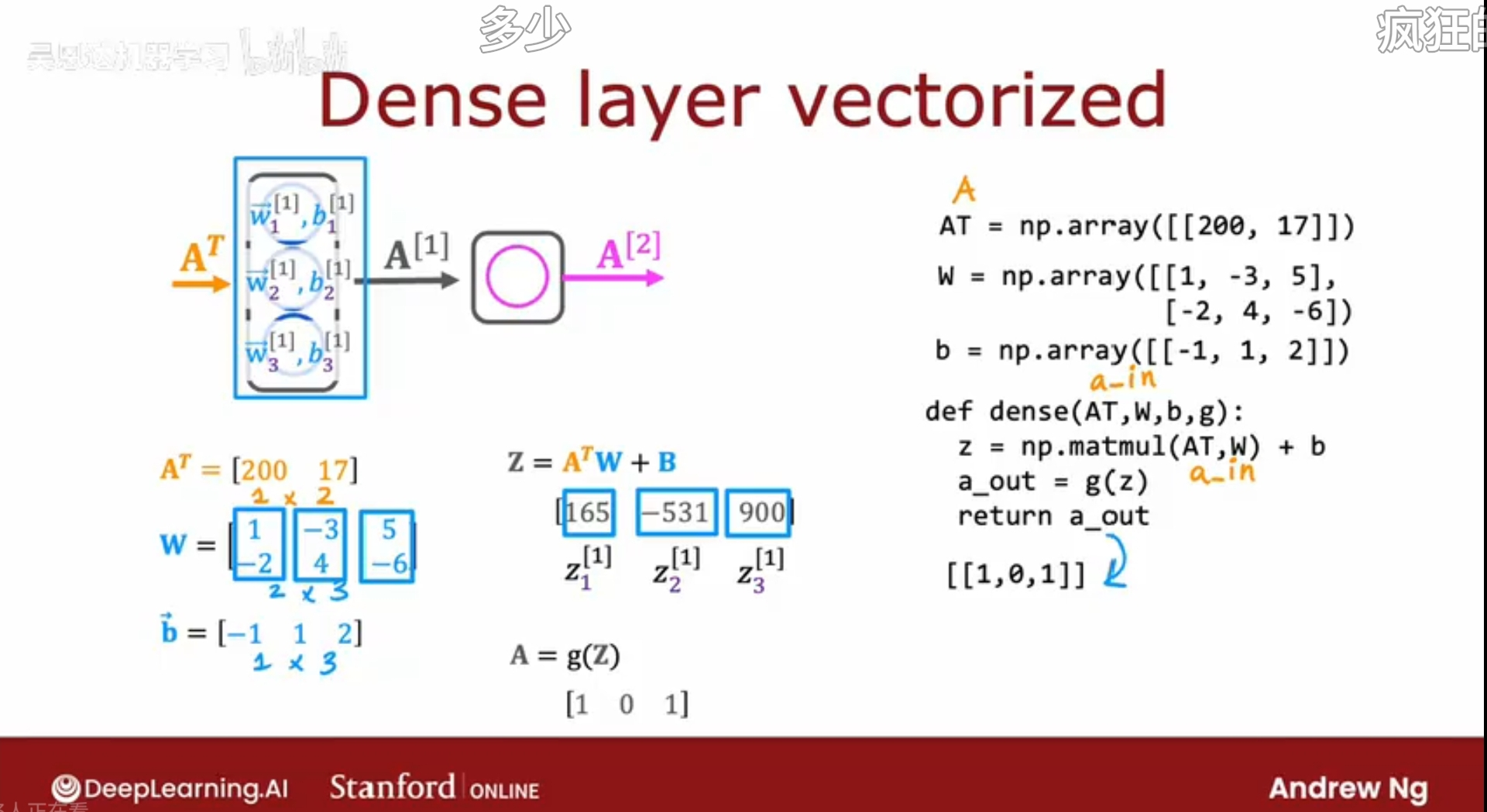

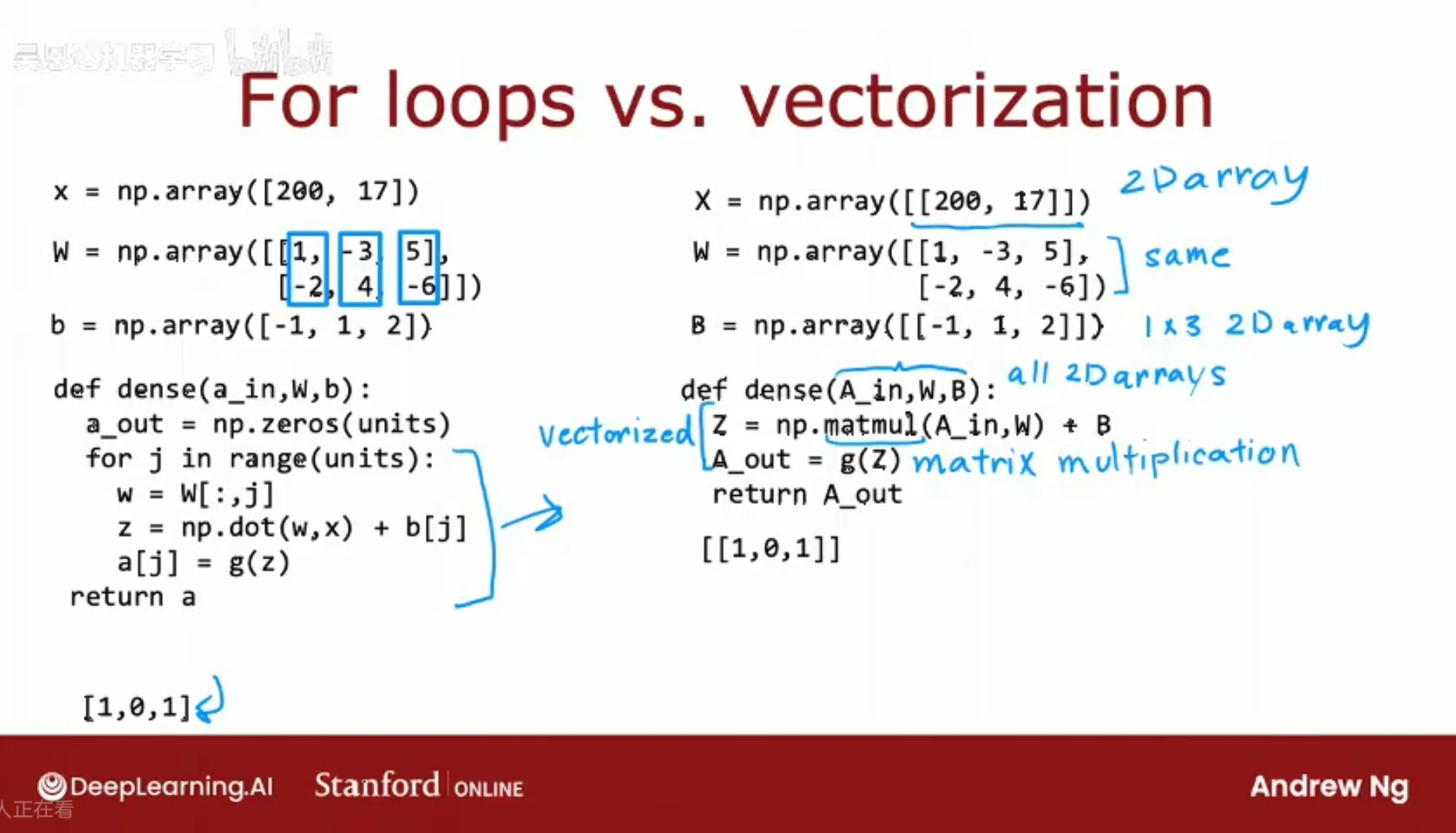

将参数X, W, B, A_in, A_out 全部当作矩阵处理,会非常高效地得到某一层的输出A_out,matmul是NumPy中的矩阵乘法;

研究者能够扩展神经网络并构建非常大型网络的原因之一,就是神经网络可以被向量化,vectorized;可以非常高效地用矩阵地乘法实现。

事实上,并行计算硬件,例如GPU,一些CPU的功能,非常擅长进行非常大的矩阵乘法,矢量化的神经网络是如何工作的。

将参数X, W, B, A_in, A_out 全部当作矩阵处理,会非常高效地得到某一层的输出A_out,matmul是NumPy中的矩阵乘法;