线性回归算法

1, 公式 y=ax+b

2,mse均方误差 = 1/n ( 实际值减去预测值的平方和 )

计算得到一个 6a平方+9b平方+12ab-12a-6b类似这样一个函数,则称为损失函数

3,损失函数:均方误差函数是一种常见的损失函数

4,梯度下降:梯度下降法是一种常用的优化算法,通过迭代更新参数,使其沿负梯度方向移动以最小化目标函数。核心步骤包括初始化参数、计算梯度、更新参数和判断停止条件,广泛应用于机器学习和深度学习中的模型参数优化。

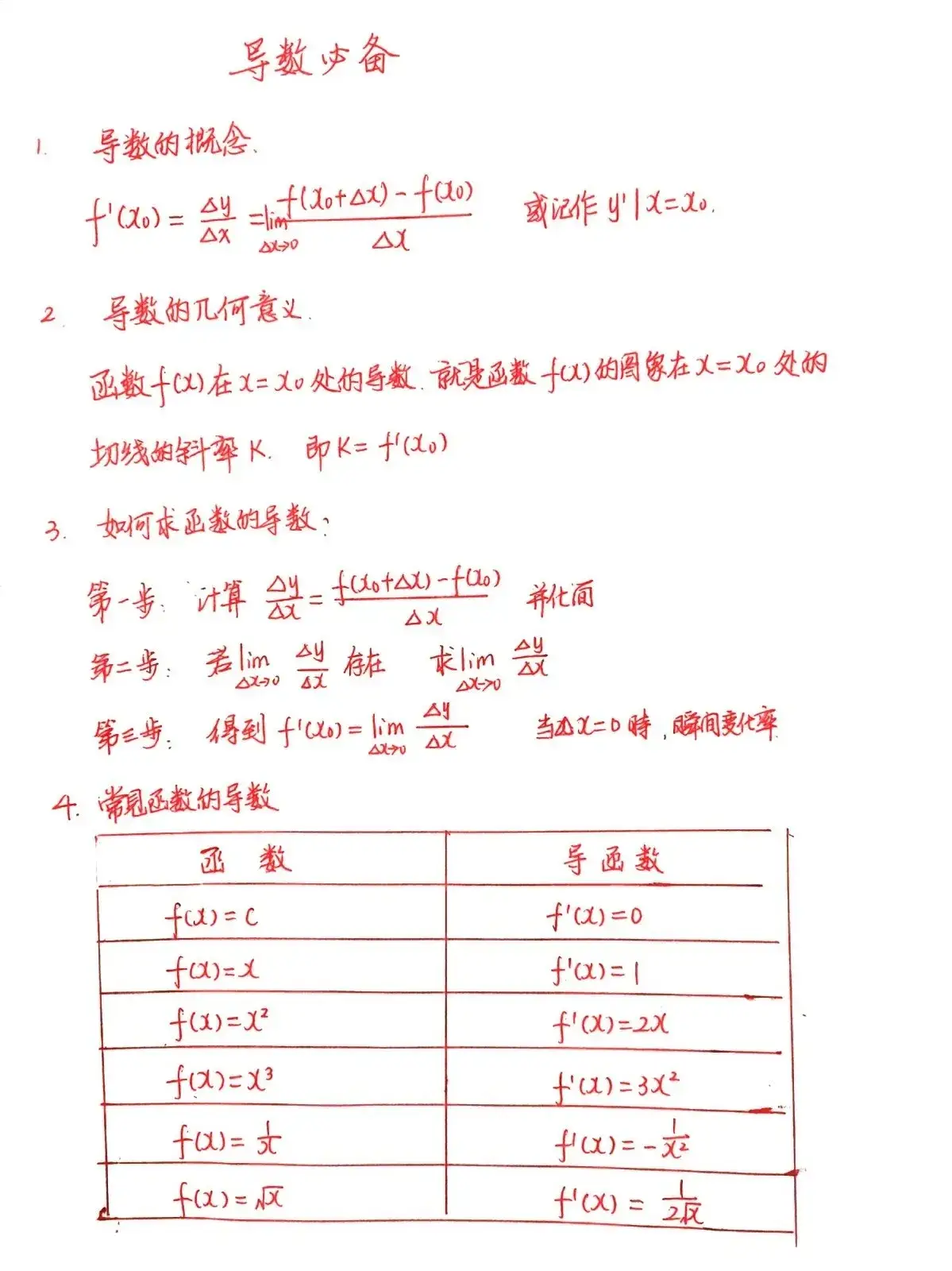

● 梯度:梯度是函数在某个给定点的切线的斜率,指出了函数在该点的上升最快的方向。梯度也就是导数

● 学习率:学习率是一个人为设定的值,用来控制梯度下降的步长。学习率过大可能导致算法无法收敛,而过小则会导致收敛速度缓慢。

梯度下降法在多个最小值的情况下,求出的可能是局部最小值

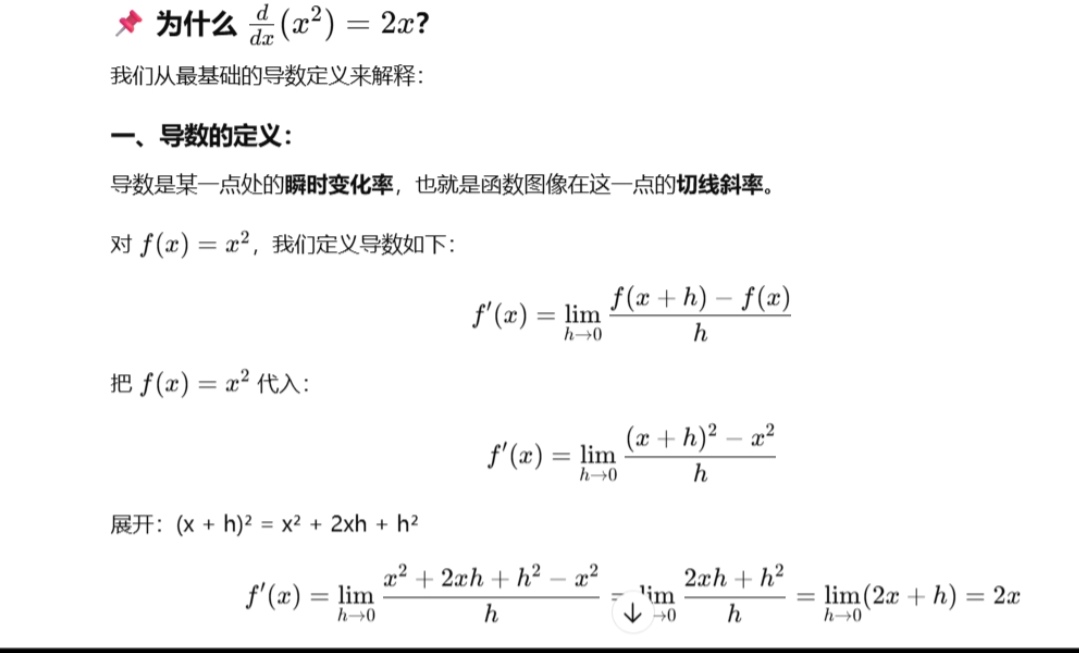

5,导数:它表示当自变量的增量趋近于零时,因变量的增量与自变量的增量之商的极限。

6,导数推导