【完整源码+数据集+部署教程】工地建筑进度监测系统源码和数据集:改进yolo11-SDI

背景意义

随着城市化进程的加快,建筑行业面临着越来越大的压力,尤其是在工期管理和资源调配方面。传统的建筑进度监测方法多依赖人工巡查和现场记录,这不仅耗时耗力,还容易受到人为因素的影响,导致监测结果的准确性和及时性下降。因此,构建一个高效、智能的建筑进度监测系统显得尤为重要。近年来,计算机视觉技术的快速发展为建筑进度监测提供了新的解决方案,尤其是基于深度学习的目标检测和实例分割技术,能够在复杂的工地环境中自动识别和分类不同的建筑材料和构件。

本研究旨在基于改进的YOLOv11模型,开发一套高效的工地建筑进度监测系统。该系统将利用包含1200张图像的数据集,这些图像涵盖了四类主要建筑材料:混凝土、模板、钢筋和瓷砖。通过对这些材料的实时监测,系统能够有效评估施工进度,识别潜在的延误因素,并为项目管理提供数据支持。YOLOv11作为一种先进的目标检测模型,具备高效的实时处理能力和优越的检测精度,能够在复杂的工地环境中实现对建筑材料的准确识别和分类。

此外,建筑进度监测不仅关乎施工效率,还直接影响到项目的成本控制和资源配置。通过引入智能化的监测系统,能够实现对施工现场的动态管理,提升项目的透明度和可控性,从而为建筑行业的数字化转型提供有力支持。综上所

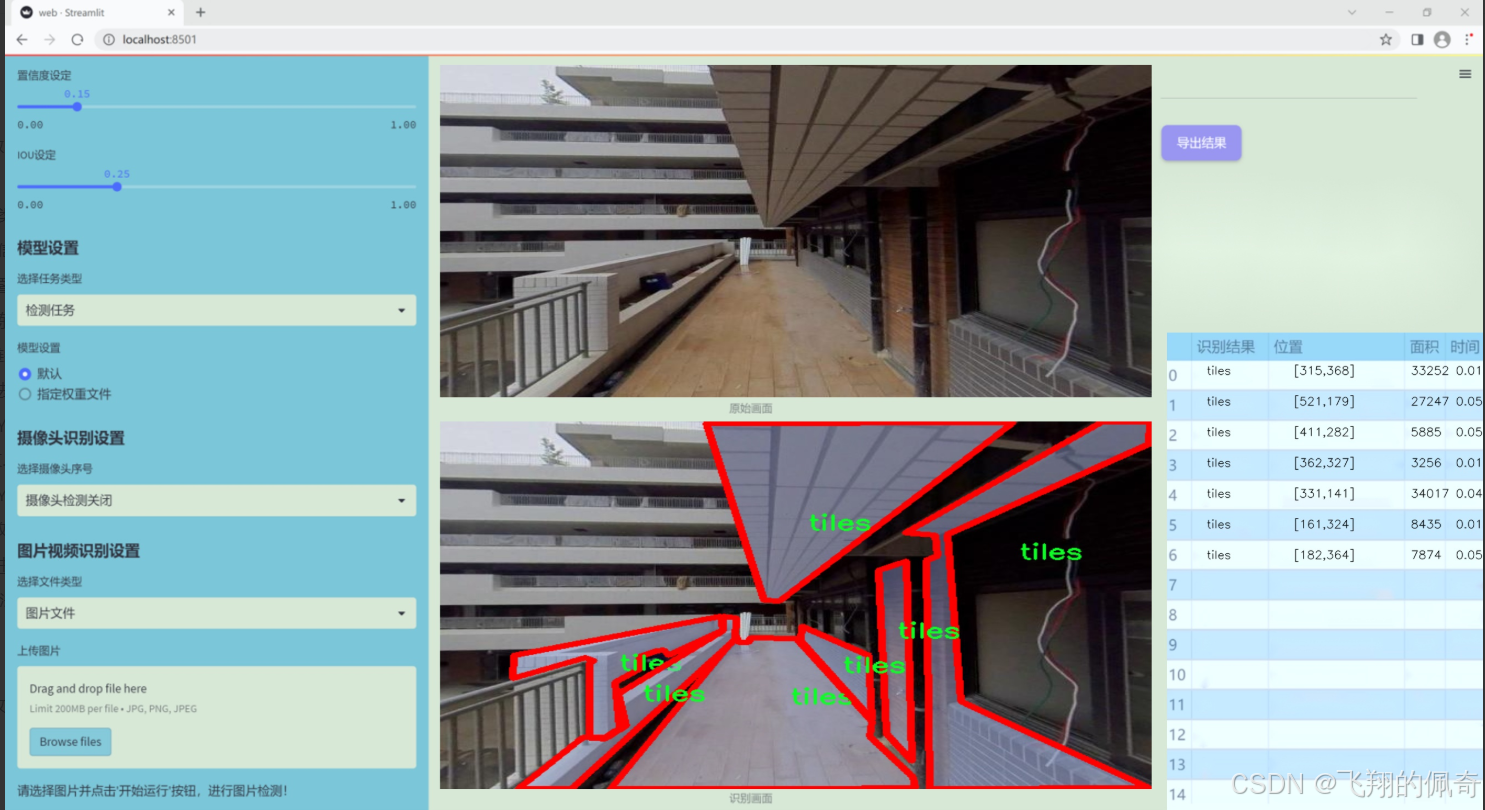

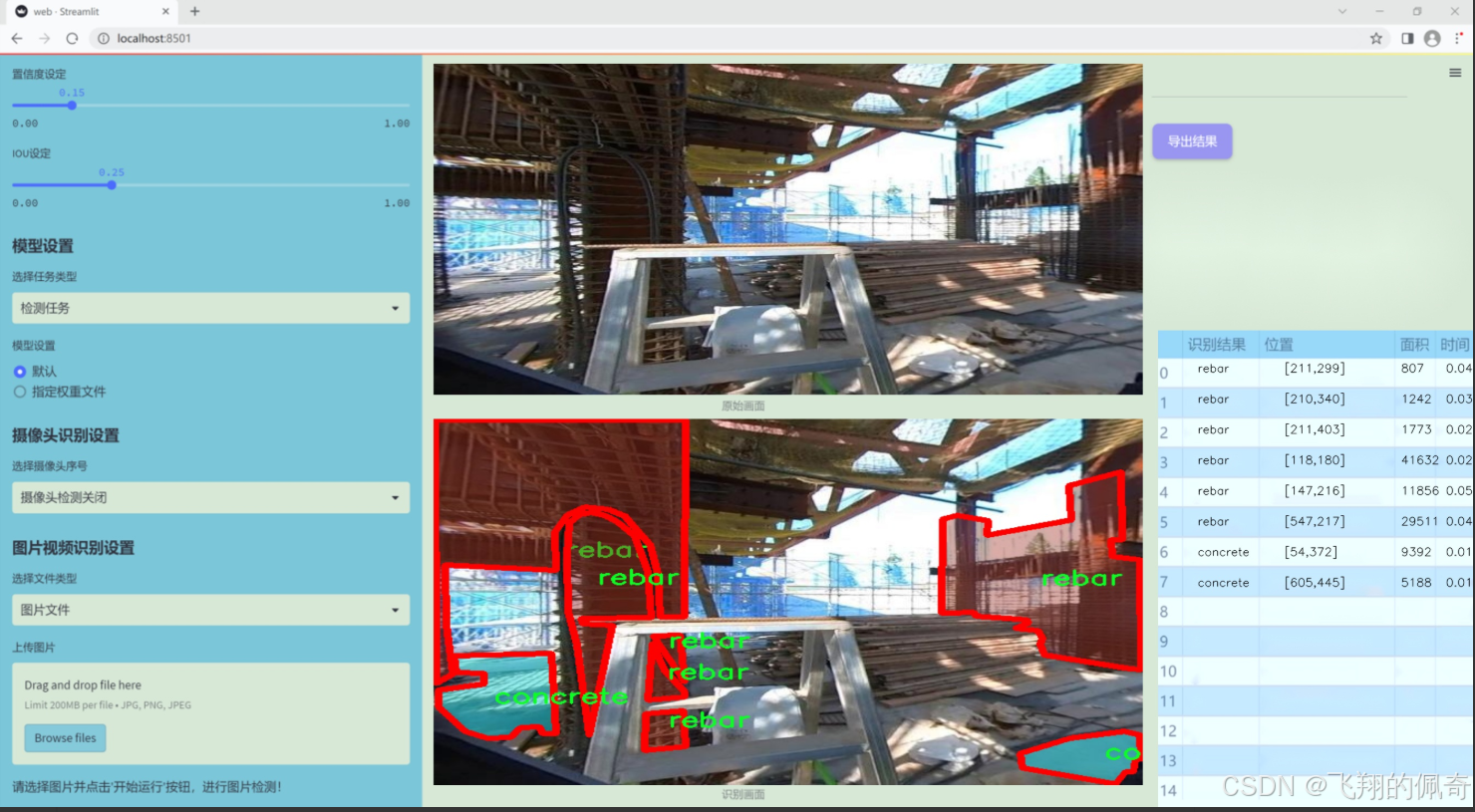

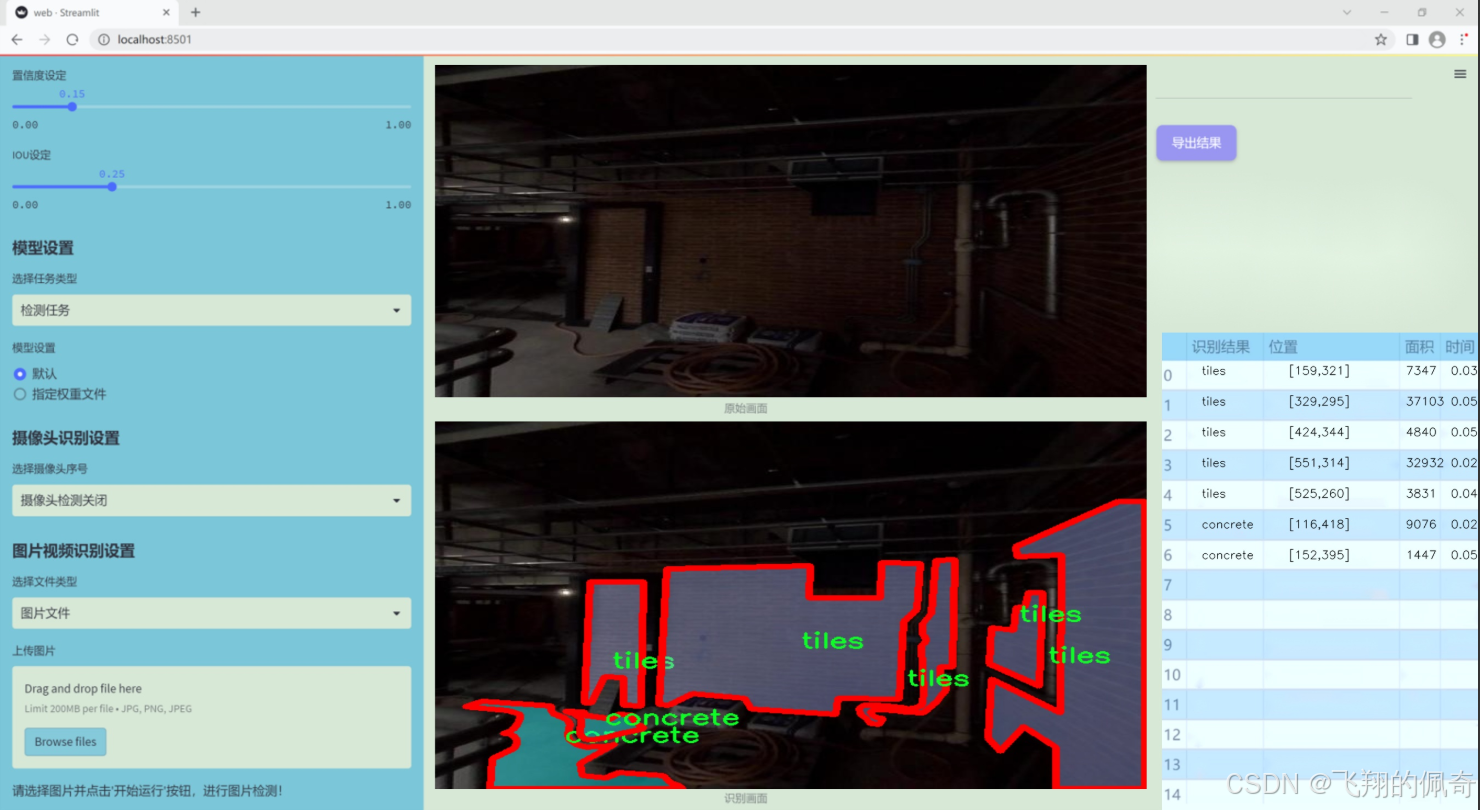

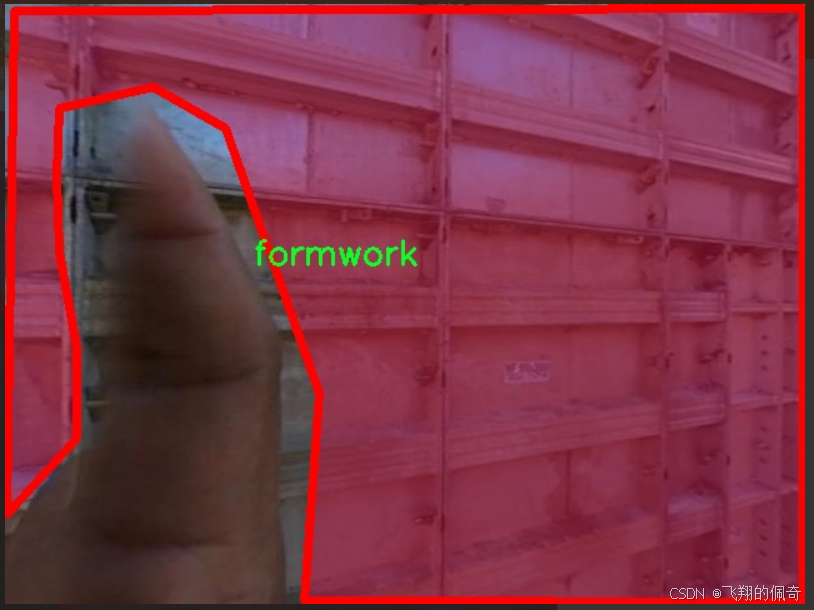

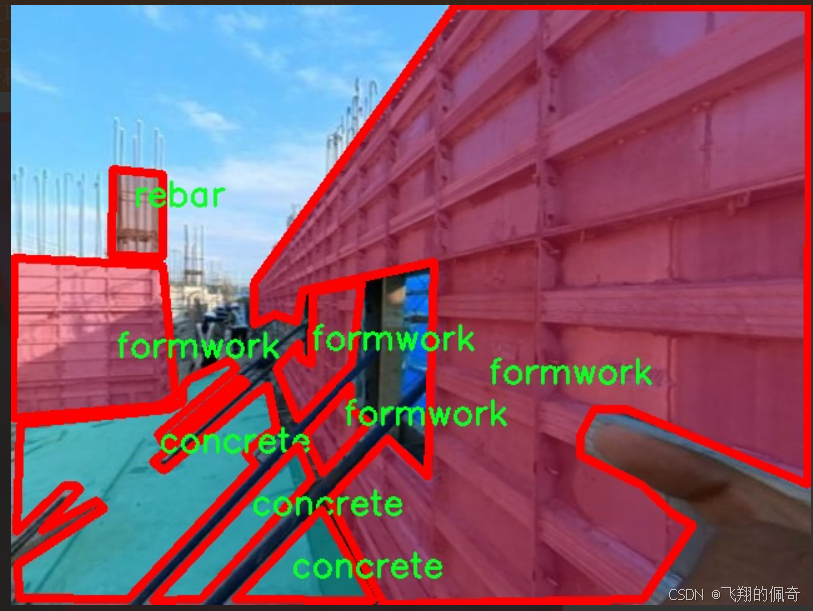

图片效果

数据集信息

本项目旨在改进YOLOv11模型,以实现高效的工地建筑进度监测系统。为此,我们构建了一个专门针对“Construction Progress Monitoring”主题的数据集,该数据集包含四个主要类别,分别为混凝土(concrete)、模板(formwork)、钢筋(rebar)和瓷砖(tiles)。这些类别涵盖了建筑施工过程中关键的材料和构件,能够有效反映出施工进度的不同阶段。

在数据集的构建过程中,我们收集了大量来自实际工地的图像数据,确保样本的多样性和代表性。这些图像不仅包括不同施工阶段的场景,还涵盖了不同天气条件、光照变化和视角的情况,以增强模型的鲁棒性。每个类别的图像均经过精心标注,确保在训练过程中能够准确识别和分类。这种精确的标注对于提升YOLOv11的检测性能至关重要,因为它直接影响到模型的学习效果和最终的监测精度。

此外,数据集还考虑到了实际应用中的挑战,例如施工现场的复杂性和动态变化。通过引入多样化的场景和材料,我们希望模型能够适应不同的施工环境,从而在实际监测中提供可靠的支持。随着建筑行业对智能化监测系统需求的不断增加,本项目的数据集不仅为YOLOv11的训练提供了坚实的基础,也为未来在建筑进度监测领域的研究和应用开辟了新的方向。通过对该数据集的深入分析和应用,我们期望能够推动建筑施工管理的智能化进程,提高施工效率和安全性。

核心代码

以下是代码中最核心的部分,并附上详细的中文注释:

import torch

import torch.nn as nn

from timm.models.layers import DropPath, trunc_normal_

class ConvBN(torch.nn.Sequential):

“”"

定义一个卷积层后接批归一化层的组合模块。

“”"

def init(self, in_planes, out_planes, kernel_size=1, stride=1, padding=0, dilation=1, groups=1, with_bn=True):

super().init()

# 添加卷积层

self.add_module(‘conv’, torch.nn.Conv2d(in_planes, out_planes, kernel_size, stride, padding, dilation, groups))

# 如果需要,添加批归一化层

if with_bn:

self.add_module(‘bn’, torch.nn.BatchNorm2d(out_planes))

# 初始化批归一化层的权重和偏置

torch.nn.init.constant_(self.bn.weight, 1)

torch.nn.init.constant_(self.bn.bias, 0)

class Block(nn.Module):

“”"

StarNet中的基本模块,包含深度可分离卷积和MLP结构。

“”"

def init(self, dim, mlp_ratio=3, drop_path=0.):

super().init()

# 深度可分离卷积

self.dwconv = ConvBN(dim, dim, 7, 1, (7 - 1) // 2, groups=dim, with_bn=True)

# MLP的两个线性变换

self.f1 = ConvBN(dim, mlp_ratio * dim, 1, with_bn=False)

self.f2 = ConvBN(dim, mlp_ratio * dim, 1, with_bn=False)

# 线性变换后接批归一化

self.g = ConvBN(mlp_ratio * dim, dim, 1, with_bn=True)

# 第二个深度可分离卷积

self.dwconv2 = ConvBN(dim, dim, 7, 1, (7 - 1) // 2, groups=dim, with_bn=False)

self.act = nn.ReLU6() # 激活函数

self.drop_path = DropPath(drop_path) if drop_path > 0. else nn.Identity() # 随机深度

def forward(self, x):input = x # 保存输入x = self.dwconv(x) # 经过深度可分离卷积x1, x2 = self.f1(x), self.f2(x) # MLP的两个分支x = self.act(x1) * x2 # 元素级乘法x = self.dwconv2(self.g(x)) # 经过线性变换和第二个卷积x = input + self.drop_path(x) # 残差连接return x

class StarNet(nn.Module):

“”"

StarNet网络结构,包含多个阶段和基本模块。

“”"

def init(self, base_dim=32, depths=[3, 3, 12, 5], mlp_ratio=4, drop_path_rate=0.0, num_classes=1000, **kwargs):

super().init()

self.num_classes = num_classes

self.in_channel = 32

# stem层

self.stem = nn.Sequential(ConvBN(3, self.in_channel, kernel_size=3, stride=2, padding=1), nn.ReLU6())

dpr = [x.item() for x in torch.linspace(0, drop_path_rate, sum(depths))] # 随机深度

# 构建各个阶段

self.stages = nn.ModuleList()

cur = 0

for i_layer in range(len(depths)):

embed_dim = base_dim * 2 ** i_layer # 当前阶段的嵌入维度

down_sampler = ConvBN(self.in_channel, embed_dim, 3, 2, 1) # 下采样层

self.in_channel = embed_dim

blocks = [Block(self.in_channel, mlp_ratio, dpr[cur + i]) for i in range(depths[i_layer])] # 当前阶段的模块

cur += depths[i_layer]

self.stages.append(nn.Sequential(down_sampler, *blocks)) # 将下采样层和模块组合

def forward(self, x):features = [] # 特征列表x = self.stem(x) # 经过stem层features.append(x)for stage in self.stages:x = stage(x) # 经过每个阶段features.append(x)return features # 返回所有阶段的特征

定义不同规模的StarNet模型

def starnet_s1(pretrained=False, **kwargs):

model = StarNet(24, [2, 2, 8, 3], **kwargs)

return model

def starnet_s2(pretrained=False, **kwargs):

model = StarNet(32, [1, 2, 6, 2], **kwargs)

return model

def starnet_s3(pretrained=False, **kwargs):

model = StarNet(32, [2, 2, 8, 4], **kwargs)

return model

def starnet_s4(pretrained=False, **kwargs):

model = StarNet(32, [3, 3, 12, 5], **kwargs)

return model

代码说明:

ConvBN: 这是一个组合模块,包含卷积层和可选的批归一化层,方便构建网络。

Block: 这是StarNet的基本构建块,包含深度可分离卷积和多层感知机(MLP),并通过元素级乘法进行特征融合。

StarNet: 这是整个网络的主体,包含多个阶段,每个阶段由下采样层和多个Block组成。网络的前向传播会返回每个阶段的特征。

模型构建函数: starnet_s1到starnet_s4是不同规模的StarNet模型构建函数,可以根据需要创建不同的网络结构。

这个程序文件实现了一个名为StarNet的神经网络模型,主要用于图像处理任务。StarNet的设计目标是简化网络结构,以突出元素级乘法的关键贡献。代码中没有使用层级缩放和训练过程中的指数移动平均(EMA),这些设计选择可能会进一步提升模型性能。

文件开头部分包含了模块的基本信息,包括作者的名字和联系方式,以及最后修改的日期。接下来,程序导入了必要的库,包括PyTorch和一些特定的模块,如DropPath和trunc_normal_。

程序定义了一个包含多个模型的列表,允许用户选择不同的StarNet变体(如starnet_s050、starnet_s100等)。每个模型都有对应的预训练权重的下载链接,方便用户加载预训练模型。

ConvBN类是一个简单的卷积层与批归一化(Batch Normalization)的组合。构造函数中初始化了卷积层和可选的批归一化层,并对其权重和偏置进行了初始化。

Block类实现了StarNet的基本构建块。它包含了深度可分离卷积、两个全连接层和一个元素级乘法操作。前向传播过程中,输入经过深度卷积、两个全连接层处理后,经过ReLU6激活函数,再进行元素级乘法,最后通过另一个卷积层和残差连接输出。

StarNet类是整个网络的主体。它包含了一个stem层(初始卷积层),以及多个阶段(stages),每个阶段由一个下采样层和多个Block组成。构造函数中还实现了权重初始化的方法。前向传播过程中,输入数据经过stem层和各个阶段,最终返回特征图。

最后,程序定义了多个函数(如starnet_s1、starnet_s2等),用于创建不同配置的StarNet模型,并提供了加载预训练权重的选项。这些函数允许用户根据需求快速构建和使用不同规模的StarNet模型。

整体来看,这个程序文件展示了StarNet模型的结构和实现细节,强调了其在设计上的简洁性和有效性。

10.4 activation.py

import torch

import torch.nn as nn

class AGLU(nn.Module):

“”“AGLU激活函数模块,来源于https://github.com/kostas1515/AGLU。”“”

def __init__(self, device=None, dtype=None) -> None:"""初始化AGLU激活函数模块。"""super().__init__()# 使用Softplus作为基础激活函数,beta设为-1.0self.act = nn.Softplus(beta=-1.0)# 初始化lambda参数,使用均匀分布self.lambd = nn.Parameter(nn.init.uniform_(torch.empty(1, device=device, dtype=dtype))) # 初始化kappa参数,使用均匀分布self.kappa = nn.Parameter(nn.init.uniform_(torch.empty(1, device=device, dtype=dtype))) def forward(self, x: torch.Tensor) -> torch.Tensor:"""计算AGLU激活函数的前向传播。"""# 将lambda参数限制在最小值0.0001,以避免除零错误lam = torch.clamp(self.lambd, min=0.0001)# 计算AGLU激活函数的输出return torch.exp((1 / lam) * self.act((self.kappa * x) - torch.log(lam)))

代码核心部分说明:

类定义:AGLU类继承自nn.Module,表示一个自定义的神经网络模块。

初始化方法:

self.act:定义了一个Softplus激活函数,beta参数设为-1.0。

self.lambd和self.kappa:这两个参数是可学习的参数,分别初始化为均匀分布的值。

前向传播方法:

lam:对self.lambd进行限制,确保其值不小于0.0001,以避免在后续计算中出现除零错误。

返回值:计算并返回AGLU激活函数的输出,利用Softplus和指数函数进行变换。

这个程序文件 activation.py 定义了一个名为 AGLU 的激活函数模块,主要用于深度学习模型中的激活函数计算。文件中使用了 PyTorch 库来实现这一功能。

首先,文件导入了必要的 PyTorch 模块,包括 torch 和 torch.nn。接着,定义了一个名为 AGLU 的类,该类继承自 nn.Module,这是 PyTorch 中所有神经网络模块的基类。

在 AGLU 类的构造函数 init 中,首先调用了父类的构造函数 super().init()。然后,初始化了一个 Softplus 激活函数,参数 beta 设置为 -1.0。Softplus 是一种平滑的激活函数,常用于替代 ReLU。接下来,定义了两个可学习的参数 lambd 和 kappa,它们被初始化为均匀分布的随机值,并通过 nn.Parameter 包装,使得这两个参数可以在训练过程中被优化。

在 forward 方法中,定义了前向传播的计算过程。该方法接收一个张量 x 作为输入。首先,对 lambd 参数进行限制,确保其最小值为 0.0001,以避免数值不稳定。然后,计算并返回激活函数的输出。输出的计算过程涉及到对输入 x 进行线性变换(乘以 kappa),并通过 Softplus 函数进行处理,最后结合 lambd 参数进行指数运算。

总的来说,这个模块实现了一种新的激活函数,结合了 Softplus 和可学习的参数,旨在提高深度学习模型的表现。

源码文件

源码获取

欢迎大家点赞、收藏、关注、评论啦 、查看👇🏻获取联系方式