【AI论文】像素修补师(PixelHacker):具有结构和语义一致性的图像修复(Image Inpainting)

摘要:图像修复是图像编辑和图像生成之间的一个基础研究领域。 最近最先进的方法(SOTA)探索了新的注意力机制、轻量级架构和上下文感知建模,展示了令人印象深刻的性能。 然而,他们经常在复杂的结构(如纹理、形状、空间关系)和语义(如颜色一致性、对象恢复和逻辑正确性)上遇到困难,导致伪影和不适当的生成。 为了应对这一挑战,我们设计了一个简单而有效的修复范例,称为潜在类别指导,并进一步提出了一个基于扩散的模型,称为PixelHacker。 具体来说,我们首先通过注释前景和背景(分别为116和21个潜在类别)构建了一个包含1400万个图像-掩码对的大型数据集。 然后,我们通过两个固定大小的嵌入分别对潜在的前景和背景表示进行编码,并通过线性注意力将这些特征间歇性地注入到去噪过程中。 最后,通过在我们的数据集上进行预训练,并在开源基准上进行微调,我们获得了PixelHacker。 广泛的实验表明,PixelHacker 在广泛的数据集(Places2、CelebA-HQ 和 FFHQ)上全面超越了 SOTA,并且在结构和语义上表现出显著的一致性。 项目页面位于https://hustvl.github.io/PixelHacker。Huggingface链接:Paper page,论文链接:2504.20438

一、研究背景和目的

研究背景:

图像修复(Image Inpainting)作为计算机视觉领域中的一个基础研究方向,位于图像编辑与图像生成技术的交汇点。其核心目标在于,针对图像中因遮挡、损坏或用户指定区域而缺失的部分,通过算法生成视觉上合理且自然的像素内容,以恢复图像的完整性和视觉连贯性。近年来,随着深度学习技术的飞速发展,图像修复领域取得了显著进展,涌现出众多基于生成对抗网络(GANs)、卷积神经网络(CNNs)以及扩散模型(Diffusion Models)的先进方法。

尽管现有方法在图像修复任务上展现出了强大的能力,但它们在处理复杂结构和保持语义一致性方面仍面临诸多挑战。具体而言,这些方法在处理具有丰富纹理、复杂形状以及精细空间关系的图像区域时,往往难以生成与原始图像无缝衔接的修复结果。此外,在颜色一致性、对象恢复以及逻辑正确性等语义层面,现有方法也时常出现不恰当的生成,导致修复后的图像出现伪影或不符合逻辑的内容。

研究目的:

本研究旨在解决上述挑战,提出一种名为PixelHacker的图像修复模型,该模型致力于在修复过程中同时保持图像的结构一致性和语义一致性。具体而言,研究目的包括:

-

提升复杂结构修复能力:通过设计有效的算法策略,使PixelHacker能够更准确地捕捉和重建图像中的复杂纹理、形状和空间关系,从而生成与原始图像高度一致的修复结果。

-

增强语义一致性:确保修复后的图像在颜色、对象特征和逻辑结构上与原始图像保持一致,避免出现伪影或不恰当的生成内容。

-

推动图像修复技术的发展:通过提出一种新的图像修复范例和模型,为图像修复领域的研究提供新的思路和方法,推动该领域技术的进一步发展。

二、研究方法

1. 潜在类别指导(Latent Categories Guidance, LCG)设计:

本研究创新性地提出了潜在类别指导这一图像修复范例。LCG的核心思想在于,通过构建包含大量图像-掩码对的数据集,并对前景和背景进行标注(前景包含116个潜在类别,背景包含21个潜在类别),从而引导模型在修复过程中关注图像的结构和语义信息。具体而言,LCG通过两个固定大小的嵌入向量分别对潜在的前景和背景表示进行编码,并在去噪过程中通过线性注意力机制将这些特征间歇性地注入到模型中。

2. PixelHacker模型构建:

基于LCG范例,本研究进一步提出了PixelHacker这一基于扩散的图像修复模型。PixelHacker的整体架构包括编码器、去噪网络和解码器三个主要部分。在编码器阶段,模型将输入的噪声图像、清洁掩码和清洁掩码图像拼接后送入变分自编码器(VAE)的编码器中,将特征从像素空间转换到潜在空间。在去噪网络阶段,LCG构建的图像-掩码对基于前景和背景标签被用于指导模型的学习过程。两个固定大小的嵌入向量分别用于编码潜在的前景和背景特征,并通过线性注意力机制将这些特征注入到去噪过程中。最后,在解码器阶段,编码后的潜在特征被送入VAE的解码器中,以重建修复后的图像。

3. 数据集构建与预训练:

为了训练PixelHacker模型,本研究构建了一个包含1400万个图像-掩码对的大型数据集。该数据集通过整合多个公开数据集(如COCONut-Large、Object365V2、GoogleLandmarkV2等)并采用自动标注框架获得前景和背景的细粒度分割掩码。在数据集构建过程中,本研究采用了四种类型的掩码(对象语义掩码、场景语义掩码、随机画笔掩码和随机对象掩码),并根据一定的概率分配给前景或背景嵌入。通过在大规模数据集上进行预训练,并在开源基准数据集(如Places2、CelebA-HQ和FFHQ)上进行微调,PixelHacker模型得以优化并展现出卓越的性能。

三、研究结果

1. 定量评估结果:

在Places2数据集上,PixelHacker模型在多种评估指标(如FID、LPIPS等)上均取得了显著优于现有SOTA方法的结果。特别是在大规模掩码区域(40-50%)的修复任务中,PixelHacker展现出了强大的结构恢复和语义保持能力。此外,在CelebA-HQ和FFHQ等人脸图像数据集上,PixelHacker同样表现出了卓越的性能,生成了高质量且语义一致的修复结果。

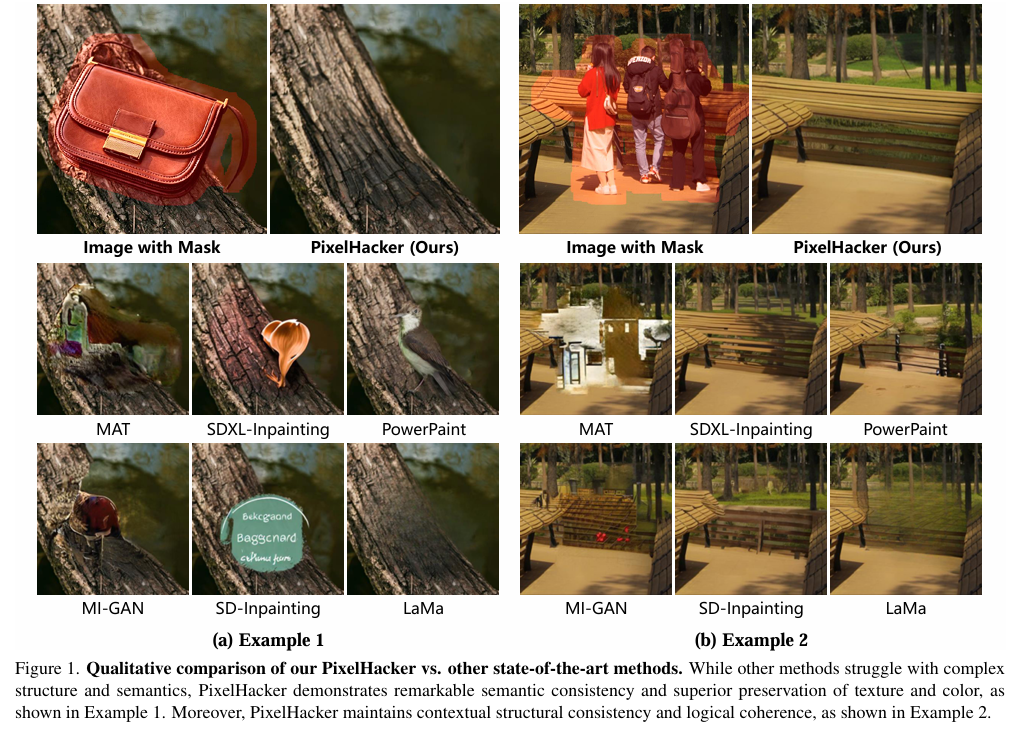

2. 定性评估结果:

通过定性比较,可以直观地观察到PixelHacker模型在修复复杂结构和保持语义一致性方面的优势。与其他SOTA方法相比,PixelHacker生成的修复结果更加自然、连贯,且颜色、纹理和对象特征等方面与原始图像高度一致。此外,PixelHacker在处理极端掩码区域(如几乎覆盖整个图像的掩码)时仍能保持出色的修复性能,进一步验证了其模型的鲁棒性和有效性。

3. 消融实验结果:

为了验证LCG范例中各个组件的有效性,本研究进行了详细的消融实验。实验结果表明,使用对象语义掩码、场景语义掩码、随机画笔掩码和随机对象掩码的组合能够取得最佳的性能表现。此外,通过调整嵌入维度和指导尺度等超参数,本研究还进一步优化了PixelHacker模型的性能。

四、研究局限

尽管PixelHacker模型在图像修复任务上取得了显著成果,但仍存在一些局限性:

-

计算资源需求较高:由于PixelHacker模型采用了大规模的数据集进行预训练,并在去噪过程中注入了大量的潜在特征,因此其训练过程对计算资源的需求较高。这在一定程度上限制了模型在资源受限环境下的应用。

-

对极端掩码区域的修复能力有限:尽管PixelHacker在处理大规模掩码区域时展现出了强大的修复能力,但在面对几乎覆盖整个图像的极端掩码区域时,其修复性能仍有一定的提升空间。

-

对新颖类别的泛化能力有待提高:由于LCG范例在构建数据集时采用了固定的前景和背景类别标签,因此PixelHacker模型在处理新颖类别时可能存在一定的泛化能力不足的问题。

五、未来研究方向

针对PixelHacker模型的局限性和图像修复领域的未来发展趋势,本研究提出以下未来研究方向:

- 优化模型架构与训练策略:

未来研究可以进一步探索更高效的模型架构和训练策略,以降低PixelHacker模型对计算资源的需求。例如,可以采用轻量级架构、模型剪枝或量化等技术来减少模型的参数量和计算量;同时,可以研究更有效的数据增强和正则化方法,以提高模型的泛化能力和训练效率。

- 提升极端掩码区域的修复能力:

针对极端掩码区域的修复问题,未来研究可以探索更先进的修复算法和策略。例如,可以研究基于多尺度特征融合、注意力机制或生成式对抗网络的方法,以更好地捕捉和重建图像中的复杂结构和语义信息;同时,可以结合图像先验知识或外部信息(如文本描述、场景上下文等)来辅助修复过程。

- 增强对新颖类别的泛化能力:

为了提高PixelHacker模型对新颖类别的泛化能力,未来研究可以探索更灵活的类别表示和学习方法。例如,可以采用无监督学习或自监督学习的方法来利用未标注数据进行模型预训练;同时,可以研究基于元学习或迁移学习的方法来快速适应新颖类别,并减少对大量标注数据的依赖。

- 拓展应用场景与领域:

除了传统的图像修复任务外,未来研究还可以探索PixelHacker模型在其他相关领域的应用潜力。例如,可以将PixelHacker应用于视频修复、图像超分辨率重建、图像风格迁移等任务中;同时,可以结合其他计算机视觉技术(如目标检测、语义分割等)来构建更复杂的视觉处理系统。

- 关注伦理与社会影响:

随着图像修复技术的不断发展,其伦理和社会影响也日益受到关注。未来研究应更加注重技术的伦理和社会责任,确保PixelHacker等图像修复模型在保护个人隐私、防止恶意使用以及促进社会公平等方面发挥积极作用。例如,可以研究如何通过技术手段来防止图像修复技术被用于制造虚假信息或进行网络攻击;同时,可以探索如何利用图像修复技术来帮助弱势群体或改善社会福祉。