GPT OSS深度解析:OpenAI时隔6年的开源模型,AI民主化的新里程碑?

名人说:博观而约取,厚积而薄发。——苏轼《稼说送张琥》

创作者:Code_流苏(CSDN)(一个喜欢古诗词和编程的Coder😊)

目录

- 一、OpenAI的"变脸":从闭源巨头到开源先锋

- 1. 什么是GPT OSS?

- 2. 为什么要开源?

- 二、技术解密:MoE架构让AI更聪明更高效、

- 1. 什么是MoE技术?

- 2. GPT OSS的技术亮点

- 3. 可调推理级别

- 三、性能表现:媲美o4-mini的开源奇迹

- 1. 基准测试结果

- 2. 实际应用能力

- 四、部署体验:手机也能跑大模型

- 1. 硬件门槛大幅降低

- 2. 多平台支持

- 五、应用前景:开启AI应用的无限可能

- 1. 企业级应用

- 2. 教育与研究

- 3. 创新创业

- 六、未来展望:AI民主化的新时代

很高兴你打开了这篇博客,更多AI知识,请关注我、订阅专栏《AI知识图谱》,内容持续更新中…

大家好👋,我是流苏

今天一起来聊聊OpenAI前几天发布的GPT OSS,这是OpenAI时隔六年之后交出的开源"答卷",它怎么样,为什么要开源,用了什么核心技术,性能如何,一起来看看吧!

一、OpenAI的"变脸":从闭源巨头到开源先锋

想象一下,2025年8月5日,OpenAI正式发布其首批开源人工智能模型gpt-oss-120b与gpt-oss-20b。这是该公司自2019年推出GPT-2后,时隔六年再度开放语言模型权重。这就像是苹果突然宣布iOS开源一样震撼!

奥特曼在国内时间8月5号晚上近12点的时候,就开始预告:有一些大但小的东西🤔

然后在国内时间凌晨1点的时候,宣布推出gpt-oss:

紧接着奥特曼补充了一段长的推文:

大致意思是说gpt-oss的优点:小但却强大,然后再次强调了OpenAI最初研究的初心和使命:AGI造福全人类,也就是AI民主化。

GPT OSS(GPT Open Source Series)的发布,这标志着OpenAI从"闭源王者"向开源生态的一次转变,更是战略推动的一次转变,是AI行业格局的一次重新洗牌,一次重新布局。

1. 什么是GPT OSS?

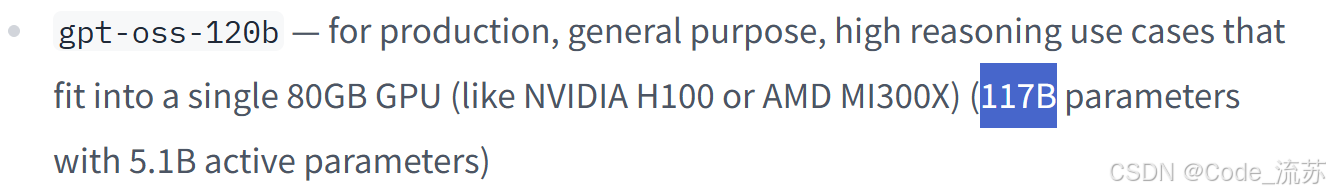

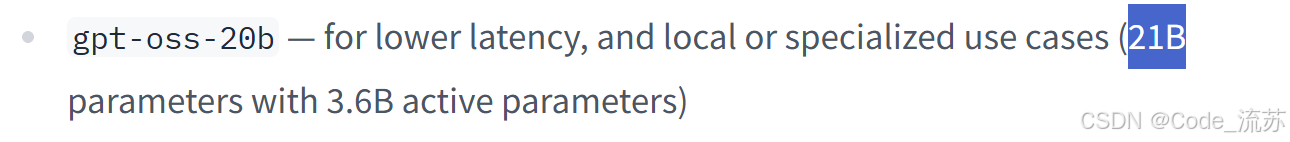

GPT OSS是OpenAI备受期待的开源权重发布,专为强大的推理、代理任务和多样化的开发者用例而设计。它包含两个模型:一个拥有117B参数的大模型(gpt-oss-120b),和一个拥有21B参数的小模型(gpt-oss-20b)。

1️⃣gpt-oss-120b

Hugging Face仓库(120b):https://huggingface.co/openai/gpt-oss-120b

1️⃣gpt-oss-20b

Hugging Face仓库(20b):https://huggingface.co/openai/gpt-oss-20b

简单来说,开源的意义可以类比成共享成果,就像OpenAI把自己的"看家本领"拿出来与全世界分享,让每个人都能使用、修改和部署这些强大的AI模型,同样地,我国的DeepSeek、Qwen、GLM等也都是很优秀的、且长期在做开源的AI厂商。

那这个时候不禁好奇,那为啥要做开源?是AI厂商错误的战略吗?其实不然

2. 为什么要开源?

OpenAI此次开源的背后有着深层考量:

- 竞争压力:面对Meta、Google、DeepSeek等公司的开源攻势,大量公司在做开源,通过模型迭代开源模型越来越优秀,在市场占据较多份额。

- 生态建设:通过开源社区的力量推动技术发展,如果OpenAI长期做闭源,就会缺失很多优秀的开源社区开发者的建设能力,和听到开发者等对模型反馈的声音。

- AI民主化:让更多开发者和研究者能够接触到先进的AI技术,这个是OpenAI一开始的初心和使命,中间有没有"变质",这个我们不予评价,单从这次开源来说,是有意义且做到了的。

二、技术解密:MoE架构让AI更聪明更高效、

OpenAI在官网介绍的时候,说明了其预训练与模型使用的架构——MoE技术。

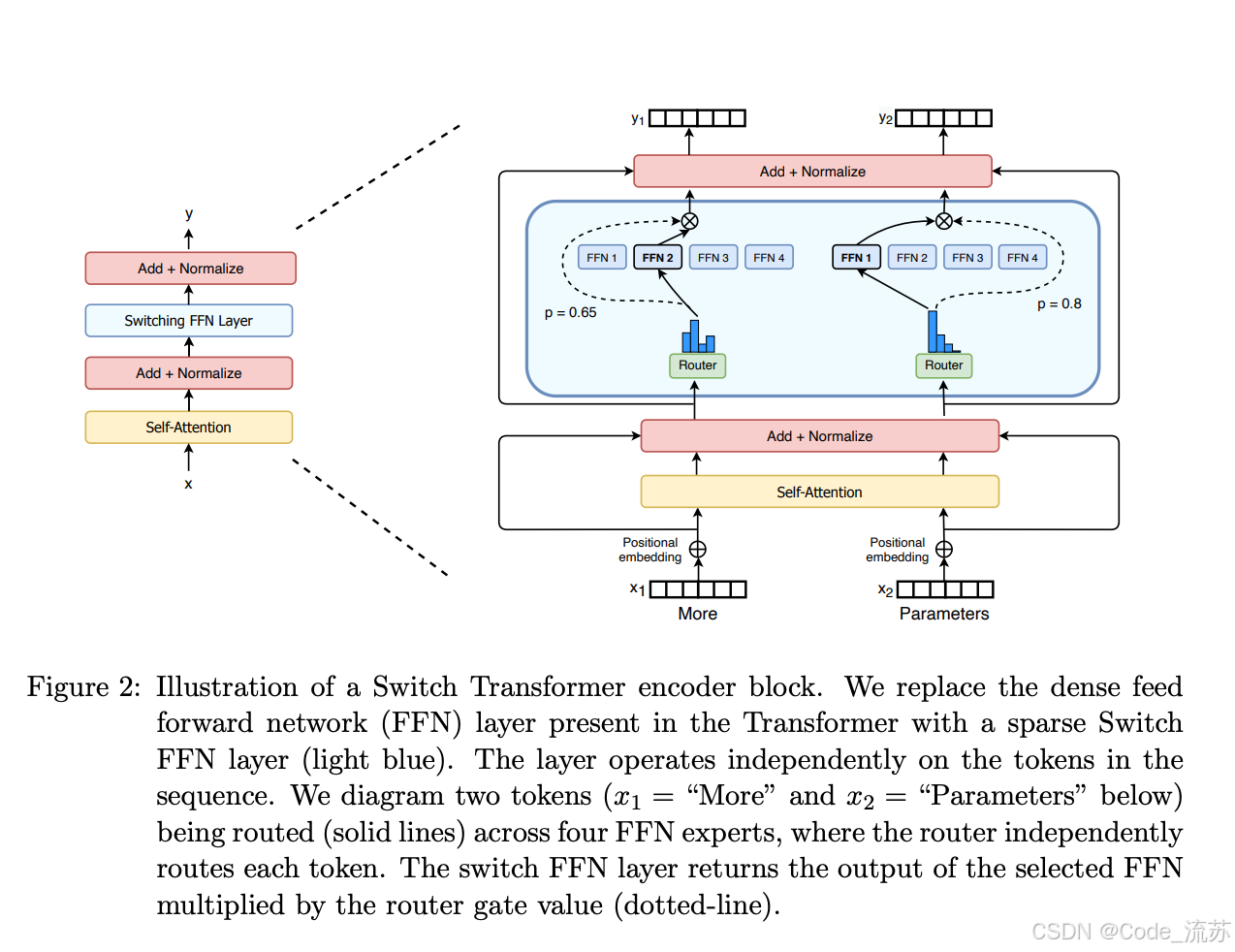

1. 什么是MoE技术?

MoE(Mixture of Experts,混合专家模型)是一种机器学习方法,将AI模型分割成多个"专家"模型,每个专家都专门处理输入数据的特定子集。

打个比方:传统模型就像一个全科医生,什么病都要看;而MoE模型像一个医院,有心脏科、脑科、骨科等专家,根据病情选择最合适的医生。

如果看到这里,大家想详细了解这个技术,可以看一下hugging face上的一篇博客介绍:

https://huggingface.co/blog/zh/moe

2. GPT OSS的技术亮点

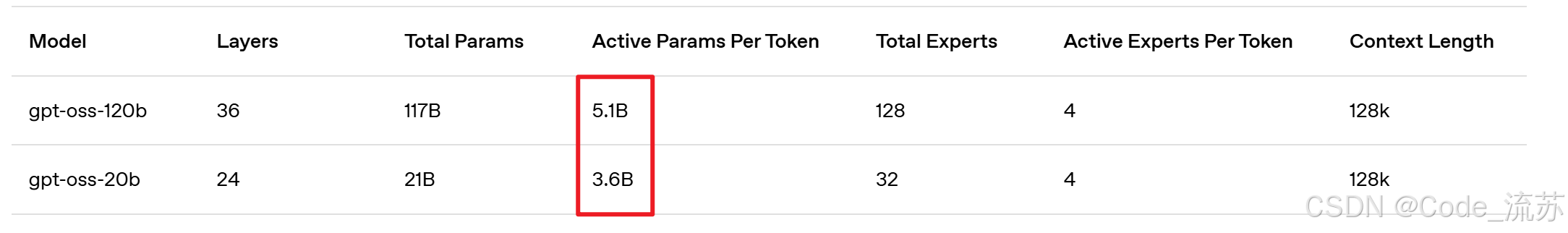

1️⃣参数规模与激活效率:

- gpt-oss-120b包含120B参数,但每个token只激活5.1B参数

- gpt-oss-20b包含21B参数,每个token激活3.6B参数

这就像一个拥有120个房间的酒店,但客人入住时只需要用到其中5-6个房间,大大提高了效率。

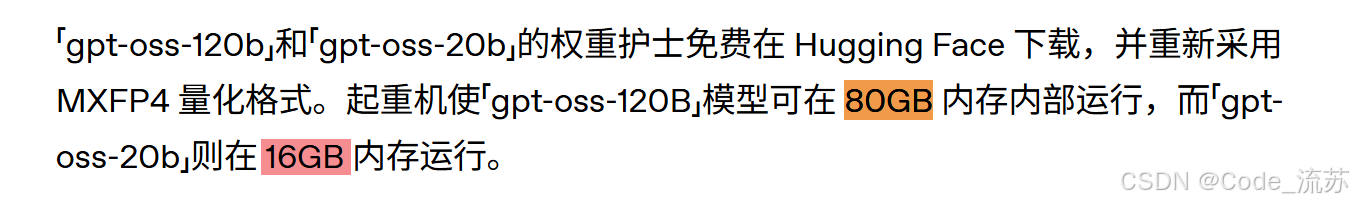

2️⃣4位量化技术:

采用4位量化技术,使120B版本能在单个80GB GPU上运行;20B版本更是适配16GB显存的消费级硬件。这意味着普通开发者也能在自己的电脑上运行这些强大的模型!

3. 可调推理级别

GPT OSS最有趣的特性之一是可调推理级别。这就像汽车的驾驶模式:

- 简单任务:经济模式,快速响应

- 复杂推理:运动模式,深度思考

- 超难问题:赛车模式,全力以赴

三、性能表现:媲美o4-mini的开源奇迹

1. 基准测试结果

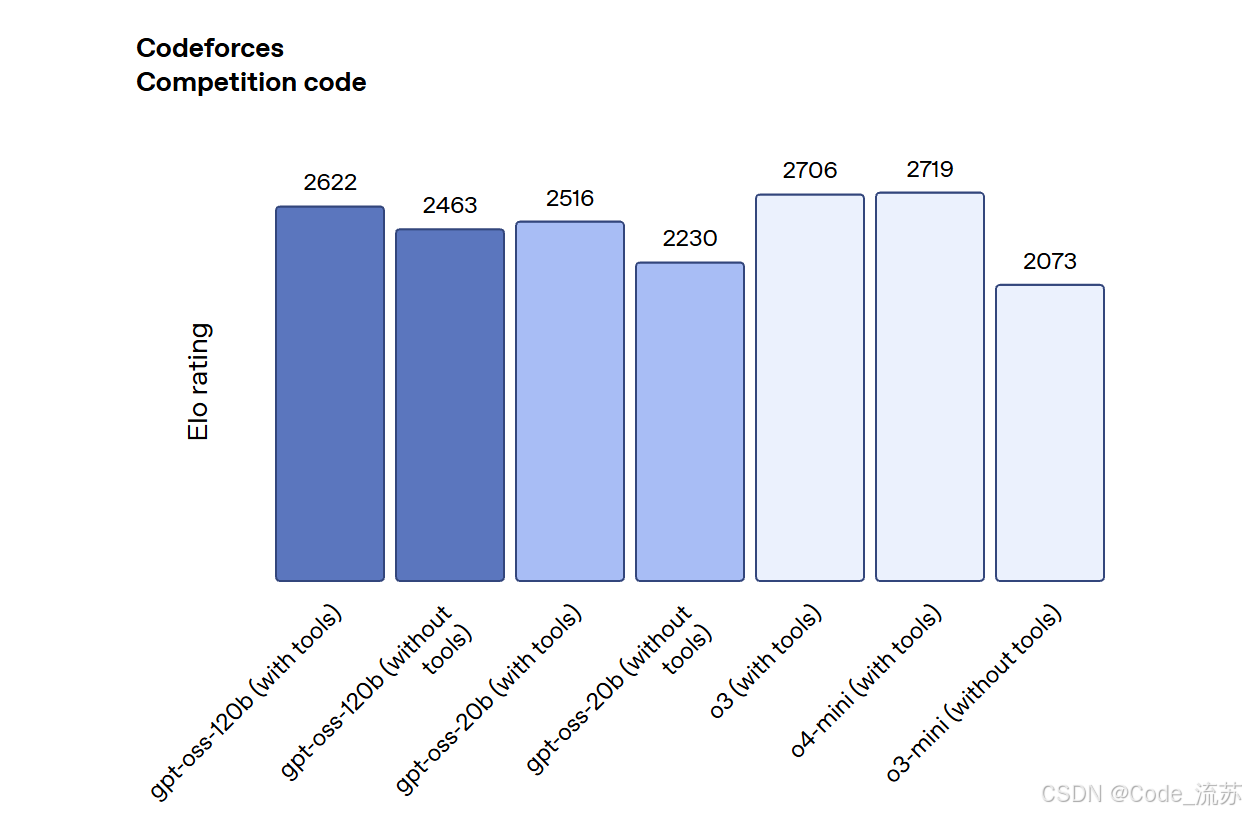

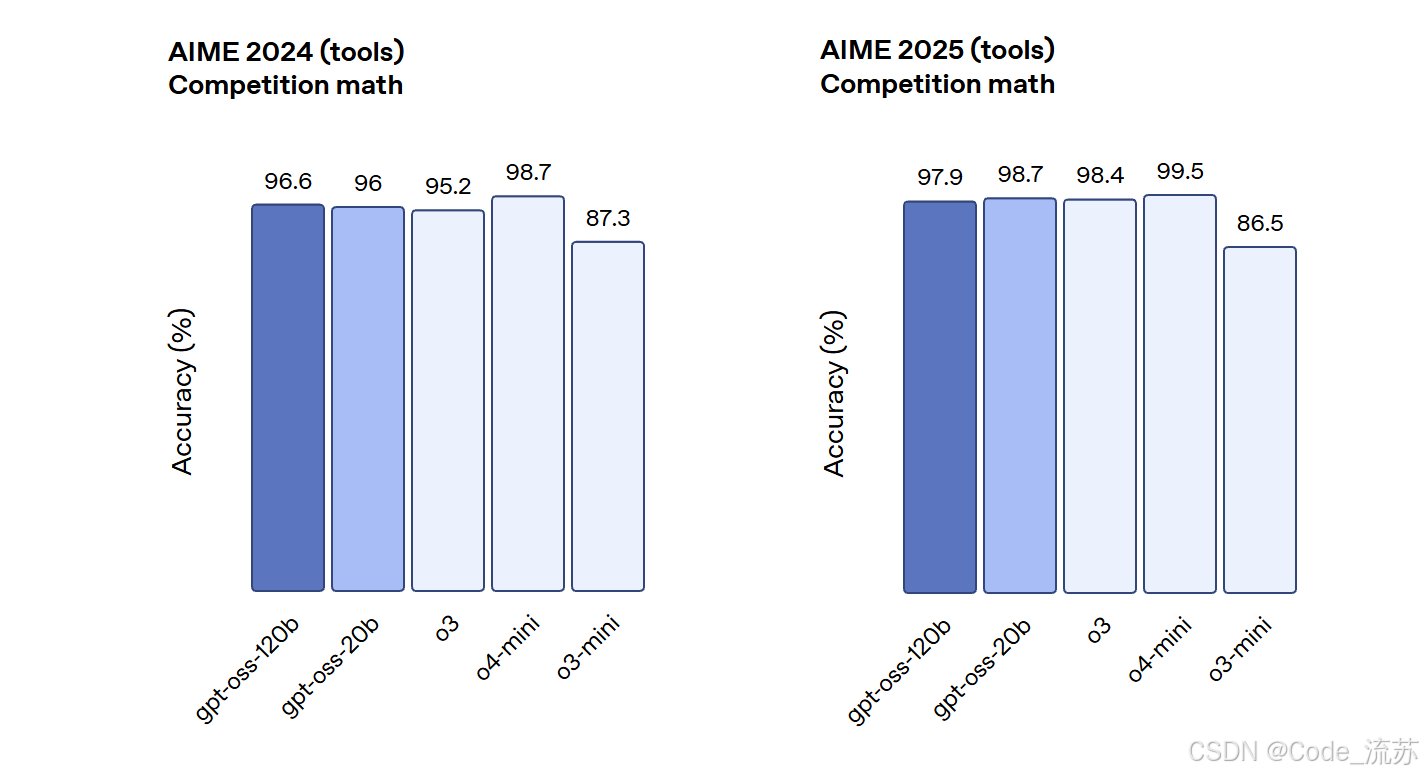

gpt-oss-120b在竞赛编程(Codeforces)、竞赛数学方面方面超越OpenAI o3‑mini,与o4-mini相当。

- 编程竞赛 (Codeforces):

- 数学竞赛 (AIME 2024 和 2025) :

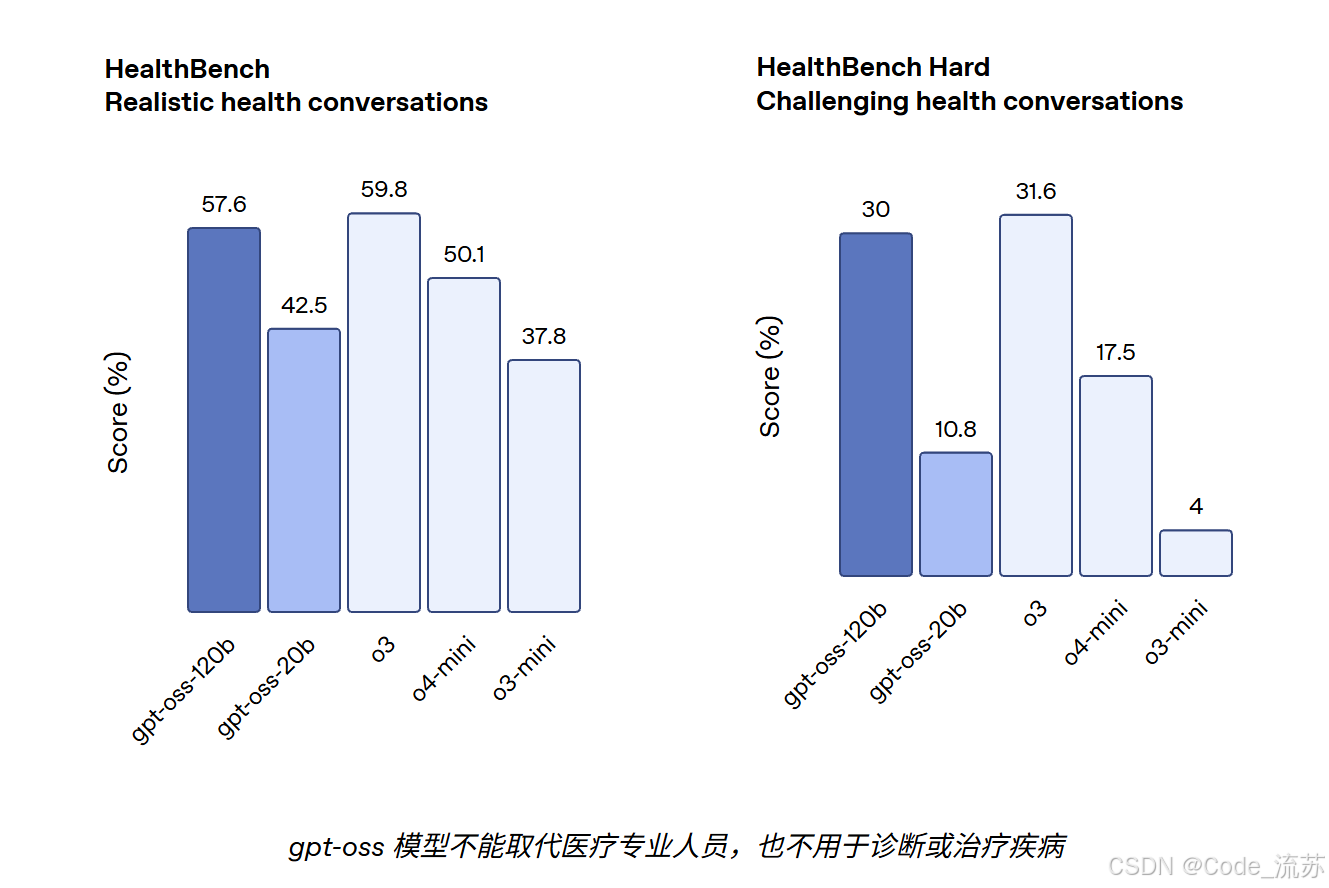

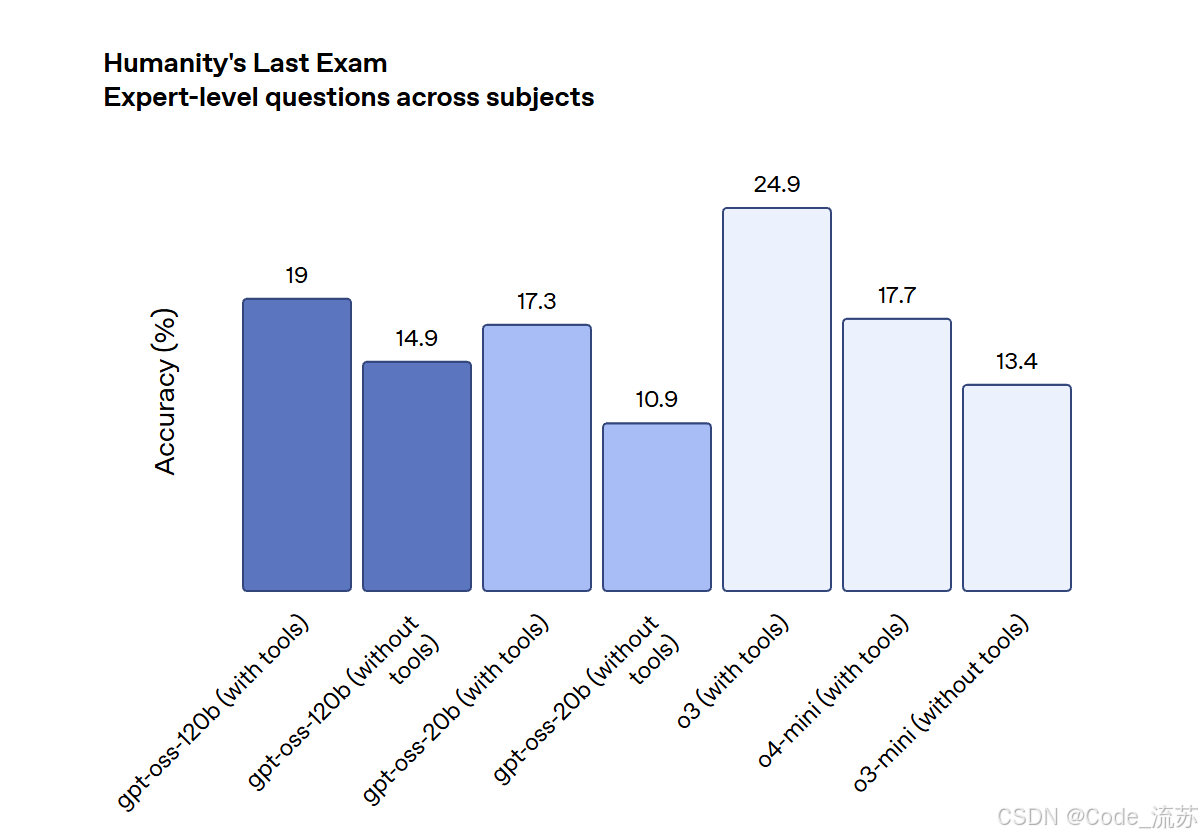

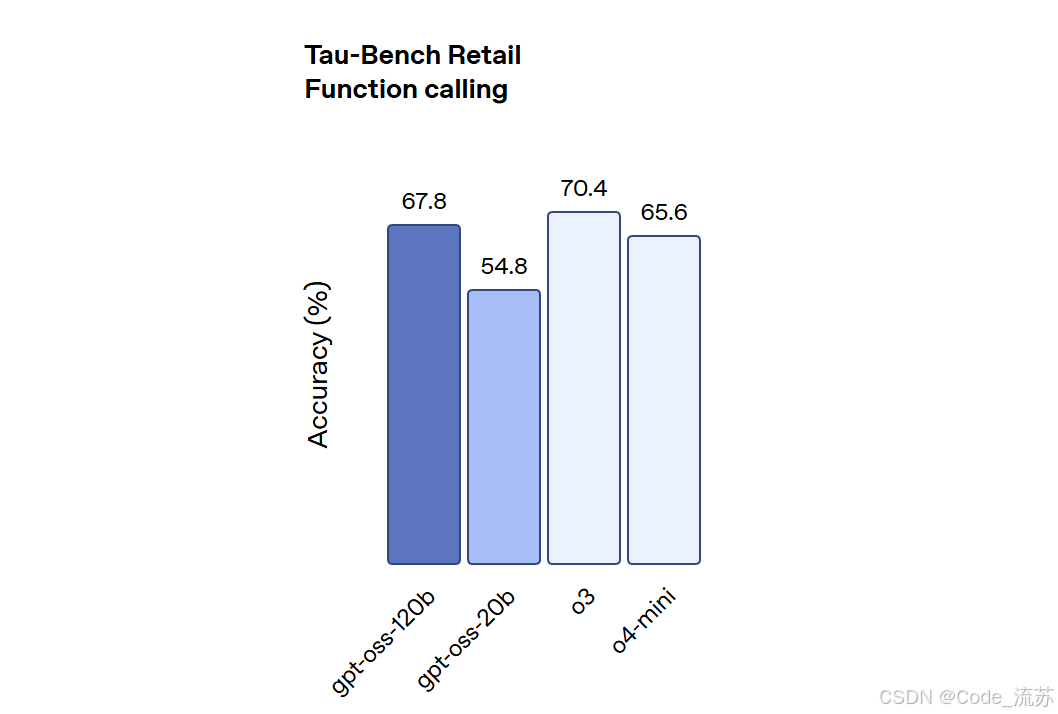

在健康相关查询(HealthBench)、通用问题解决 HLE、工具调用(TauBench)等方面,gpt-oss-120b甚至超越了o4-mini。

- 健康相关查询 (HealthBench):

- 通用问题解决 HLE:

- 工具调用(TauBench):

2. 实际应用能力

想象这样的场景:

- 代码编程:能够理解复杂的编程需求,生成高质量代码

- 数学推理:解决高难度数学竞赛题目

- 工具调用:智能调用各种API和工具

- 健康咨询:提供专业的医疗健康建议

这些能力让GPT OSS不仅仅是个聊天机器人,更像是一个全能的AI助手。

四、部署体验:手机也能跑大模型

1. 硬件门槛大幅降低

最令人兴奋的是,这两款模型在推理能力和安全性方面都实现了实质性提升,同时硬件要求却大幅降低:

gpt-oss-120b:

- 推荐配置:80GB显存GPU

- 最低配置:通过量化技术,普通显卡也可运行

gpt-oss-20b:

- 消费级显卡:16GB显存即可流畅运行

- 移动设备:优化后甚至可以在手机上运行

2. 多平台支持

GPT OSS现已登陆多个平台:

- Hugging Face:最受欢迎的AI模型分享平台

- Azure AI Foundry:微软云AI服务

- IBM watsonx.ai:IBM的企业AI平台

- Ollama:本地部署工具

这就像把高档餐厅的美食做成了方便面,人人都能享受到出色的AI体验。

五、应用前景:开启AI应用的无限可能

1. 企业级应用

-

私有化部署:企业可以将GPT OSS部署在自己的服务器上,确保数据安全和隐私保护。

-

定制化开发:基于开源权重,企业可以针对特定行业和场景进行模型微调,打造专属的AI助手。

2. 教育与研究

-

学术研究:研究者可以深入分析模型架构,推动AI理论发展。

-

教学实践:学生可以直接使用最先进的模型进行学习和实验。

3. 创新创业

-

降低门槛:初创公司无需巨额成本即可使用出色的AI技术。

-

创新应用:开发者可以基于GPT OSS创造出前所未有的AI应用。

六、未来展望:AI民主化的新时代

GPT OSS,这两个采用Apache 2.0许可证的开源权重推理模型,不仅技术先进、性能卓越,更重要的是它们打破了AI技术的壁垒,让每个人都有机会参与到AI的发展中来。

GPT OSS的发布不仅仅是技术的进步,更是AI发展哲学的转变。它预示着:

1.技术普及化:AI技术不再是少数大公司的专利,而是全社会共享的资源。

2.创新加速化:开源生态将催生更多创新应用,推动AI技术快速发展。

3.竞争良性化:开源与闭源模型的竞争将推动整个行业向前发展。

无论你是企业决策者、技术开发者,还是AI爱好者,GPT OSS作为开源模型,都给大家多了一个选择。这不是结束,而是一个全新的开始——一个人人都能拥有"AI超能力"的时代!

创作者:Code_流苏(CSDN)(一个喜欢古诗词和编程的Coder😊)