MMDG++:构筑多模态人脸防伪新防线,攻克伪造攻击与场景漂移挑战

在人脸识别技术日益融入我们生活的今天,从手机解锁到门禁考勤,安全性成为衡量系统可信性的关键。然而,随着攻击手段日益升级,特别是以3D面具、视频翻拍、打印照片等形式出现的伪造攻击(Presentation Attack)不断威胁着人脸识别系统的稳定性与鲁棒性。如何实现更安全、更通用、更稳健的人脸活体检测,成为人工智能与生物识别领域的重要课题。

近日,北航、中科院自动化所、大湾区大学、南洋理工大学等联合团队提出新一代多模态人脸防伪框架 —— MMDG++,为人脸识别系统提供强有力的安全护盾。该研究成果已被计算机视觉领域权威期刊**IEEE Transactions on Pattern Analysis and Machine Intelligence(TPAMI)**正式录用。

Xun Lin, Ajian Liu, Zitong Yu, IEEE, Rizhao Cai, Shuai Wang, Yi Yu, Jun Wan, Zhen Lei, Xiaochun Cao, Alex Kot. Reliable and Balanced Transfer Learning for Generalized Multimodal Face Anti-Spoofing. TPAMI, 2025

一、多模态融合下的“两大顽疾”

当前,多模态人脸防伪方法已成为主流,例如将可见光、深度图、红外图等多源信息进行融合,来提升攻击识别能力。然而,这一方向仍面临两大核心瓶颈:

-

模态不可靠性:不同模态在跨设备、跨场景时,极易产生“域偏移”现象,如某些设备采集的深度图失真、红外图噪声大,导致融合效果大打折扣。

-

模态失衡性:模型在训练过程中往往对某一模态过度依赖,忽视其他模态的有效信息。一旦主模态失效(如被遮挡或攻击转移),整体性能将大幅下降。

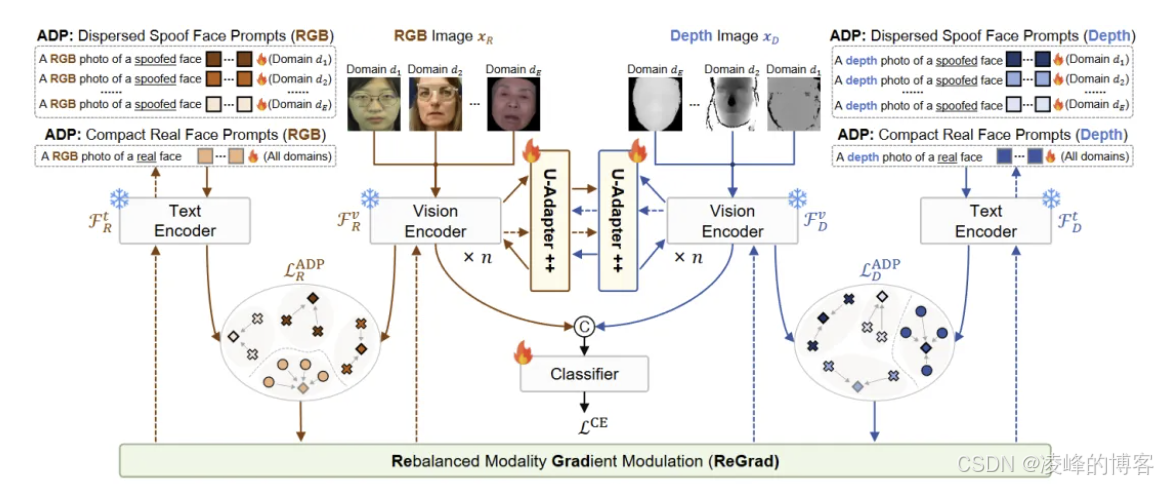

二、MMDG++:破解不可靠与失衡的三大利器

为应对上述挑战,研究团队在融合策略、优化机制与跨模态学习等方面提出系统性创新,构建了多模态人脸防伪新范式——MMDG++,包含三大核心模块:

-

U-Adapter++:可信区域动态筛选

通过引入不确定性感知机制,模型可对每种模态输入的局部区域进行动态判断与筛选,自动抑制干扰区域、保留高置信度区域,实现更鲁棒的模态交互。

-

ReGrad:模态梯度重平衡机制

为防止某一模态“带飞”模型,ReGrad在优化过程中对各模态的梯度流进行实时调节,引导模型均衡学习每种模态的有效特征,减缓主模态主导现象。

-

非对称提示学习机制(Asymmetric Prompt Learning)

结合预训练的CLIP模型,MMDG++引入语言引导式提示学习方法,将语言先验信息融入判别过程,构建更具泛化力的跨模态判别边界,有效提升对未知攻击和跨场景的适应能力。

三、打造真实可用的评测基准

团队还构建了一个覆盖更广泛部署环境的新型多模态人脸防伪评测基准,涵盖多种模态组合、攻击类型和设备来源,旨在全面评估模型在真实应用中的落地表现。

实验结果:性能全面领先

在多个公开协议和测试集上的实验证明,MMDG++相较现有先进方法,在鲁棒性、通用性与泛化能力方面均有显著优势。无论是已知攻击识别还是未知攻击防御,MMDG++均展示出强劲性能,为可信AI在人脸识别安全领域的广泛应用提供了坚实支撑。