为什么神经网络网络算法比机器学习模型算法更加强大?

神经网络(尤其是深度神经网络)相比传统机器学习模型(如线性回归、决策树、支持向量机等)的“强大”主要体现在其更强的表达能力、自适应特征学习能力以及对复杂模式的建模能力。但这种“强大”并非绝对,而是有特定条件和适用场景的。以下是具体分析:

1. 表达能力:从线性到非线性的飞跃

- 传统机器学习模型:

多数传统模型(如线性回归、逻辑回归)本质上是线性模型,或通过简单非线性变换(如核方法)扩展能力。它们的假设空间有限,难以拟合高度复杂的非线性关系。

例子:线性回归只能拟合直线或超平面,无法直接建模图像中的边缘、纹理等层次化特征。 - 神经网络:

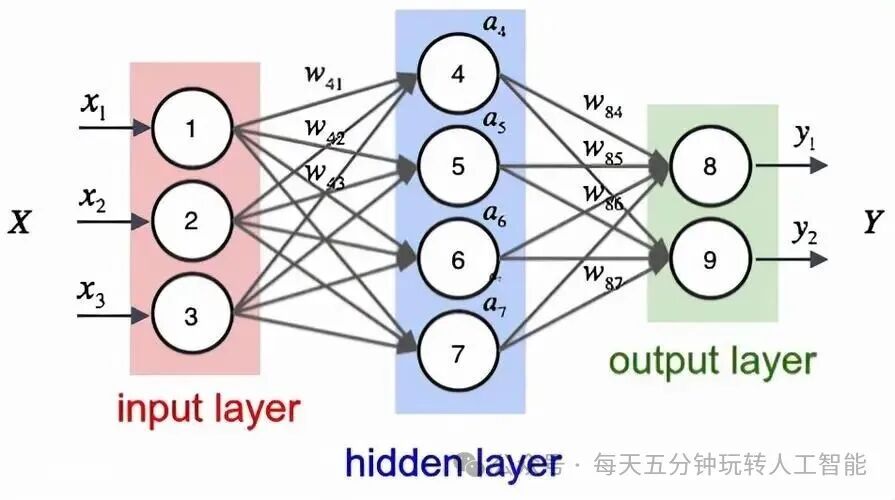

通过多层非线性激活函数(如ReLU、Sigmoid)的叠加,神经网络可以构建高度非线性的函数。理论上,足够深的神经网络可以逼近任意复杂度的连续函数(通用近似定理)。

例子:卷积神经网络(CNN)通过局部感受野和层次化卷积操作,能自动学习从像素到边缘、再到物体部件的抽象特征。

2. 特征学习:从手工设计到自动提取

-

传统机器学习模型:

依赖手工特征工程,即需要领域专家根据任务设计特征(如SIFT特征用于图像、TF-IDF用于文本)。特征的质量直接影响模型性能,且过程耗时费力。

例子:在图像分类任务中,传统方法需先提取颜色直方图、纹理特征等,再输入分类器。 -

神经网络:

通过端到端学习,神经网络可以直接从原始数据(如像素、文本序列)中自动学习层次化特征。深层网络逐层抽象: -

- 低层:检测简单模式(如边缘、角点);

- 中层:组合成部件或局部结构(如眼睛、鼻子);

- 高层:形成全局语义表示(如人脸、汽车)。

例子:ResNet等深度CNN在ImageNet上直接输入像素即可达到超人类水平的分类准确率。

3. 数据规模与复杂度适应性

-

传统机器学习模型:

在小规模数据上表现良好,但数据量增大时,模型复杂度受限(如线性模型无法利用海量数据中的复杂模式),且易过拟合。

例子:决策树在数据量少时可能过拟合,而支持向量机的核函数选择对大数据效率低。 -

神经网络:

-

-

大数据优势

:神经网络(尤其是深度学习)是“数据驱动”的模型,数据量越大,其性能提升越显著。例如,GPT-3等大语言模型通过海量文本数据学习到丰富的语言模式。

-

正则化技术

:通过Dropout、批量归一化(BatchNorm)、权重衰减等技术,神经网络能有效控制过拟合,适应复杂任务。

-

4. 任务通用性与迁移能力

-

传统机器学习模型:

通常针对特定任务设计(如分类、回归),迁移到其他任务需重新训练或调整特征。

例子:为图像分类设计的SVM无法直接用于机器翻译。 -

神经网络:

-

-

多任务学习

:通过共享底层表示,神经网络可同时处理多个相关任务(如目标检测+语义分割)。

-

迁移学习

:预训练模型(如BERT、ResNet)可在新任务上微调,显著减少数据需求。例如,在医疗影像分析中,使用在ImageNet上预训练的CNN作为特征提取器,可快速适应新疾病分类任务。

-

5. 硬件与算法优化支持

- 计算效率:

神经网络通过反向传播算法和**随机梯度下降(SGD)**实现高效优化,且受益于GPU/TPU的并行计算能力,可处理大规模矩阵运算。

例子:训练一个千亿参数的GPT-3模型需数千块GPU和数周时间,但训练完成后可快速生成文本。 - 算法创新:

深度学习领域持续涌现新架构(如Transformer、图神经网络)和训练技巧(如自监督学习、对比学习),进一步扩展了神经网络的应用边界。

神经网络的局限性:并非“万能钥匙”

尽管神经网络强大,但也存在以下限制:

-

数据依赖性

:需要大量标注数据,小样本任务表现可能不如传统方法(如小样本学习场景)。

-

可解释性差

:深层网络的“黑箱”特性使其在医疗、金融等需解释性的领域应用受限。

-

计算成本高

:训练和推理需大量算力,可能不适合资源受限的环境(如嵌入式设备)。

-

对抗样本脆弱性

:易受微小扰动攻击(如图像分类中添加噪声导致误分类)。

神经网络“强大”的适用场景

神经网络在以下情况下表现显著优于传统机器学习模型:

-

数据规模大

(如互联网级数据);

-

任务复杂度高

(如计算机视觉、自然语言处理、语音识别);

-

需自动特征学习

(如从原始传感器数据中提取模式);

-

有足够计算资源

(如GPU集群支持)。

而在小数据、简单任务或需强解释性的场景中,传统机器学习模型(如随机森林、XGBoost)或统计方法可能更合适。因此,选择算法需根据具体问题、数据和资源权衡,而非盲目追求“强大”。

最后

选择AI大模型就是选择未来!最近两年,大家都可以看到AI的发展有多快,我国超10亿参数的大模型,在短短一年之内,已经超过了100个,现在还在不断的发掘中,时代在瞬息万变,我们又为何不给自己多一个选择,多一个出路,多一个可能呢?

与其在传统行业里停滞不前,不如尝试一下新兴行业,而AI大模型恰恰是这两年的大风口,整体AI领域2025年预计缺口1000万人,人才需求急为紧迫!

由于文章篇幅有限,在这里我就不一一向大家展示了,学习AI大模型是一项系统工程,需要时间和持续的努力。但随着技术的发展和在线资源的丰富,零基础的小白也有很好的机会逐步学习和掌握。

【2025最新】AI大模型全套学习籽料(可白嫖):LLM面试题+AI大模型学习路线+大模型PDF书籍+640套AI大模型报告等等,从入门到进阶再到精通,超全面存下吧!

获取方式:有需要的小伙伴,可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

包括:AI大模型学习路线、LLM面试宝典、0基础教学视频、大模型PDF书籍/笔记、大模型实战案例合集、AI产品经理合集等等

大模型学习之路,道阻且长,但只要你坚持下去,一定会有收获。本学习路线图为你提供了学习大模型的全面指南,从入门到进阶,涵盖理论到应用。

L1阶段:启航篇|大语言模型的基础认知与核心原理

L2阶段:攻坚篇|高频场景:RAG认知与项目实践

L3阶段:跃迀篇|Agent智能体架构设计

L4阶段:精进篇|模型微调与私有化部署

L5阶段:专题篇|特训集:A2A与MCP综合应用 追踪行业热点(全新升级板块)

AI大模型全套学习资料【获取方式】