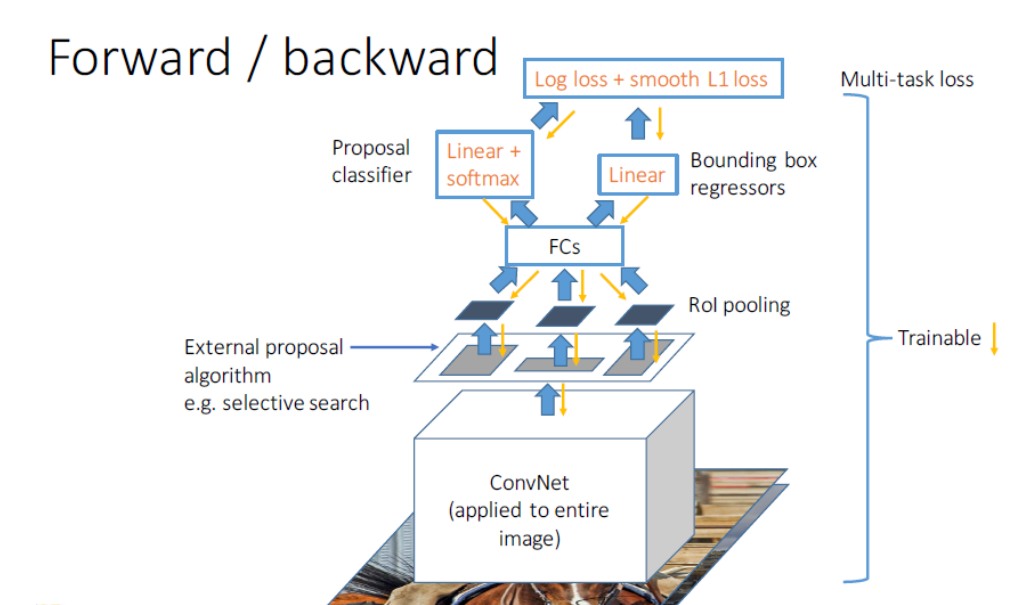

深度学习模型在目标检测任务中的前向传播(forward)和反向传播(backward)过程

这是一个典型的深度学习模型在目标检测任务中的前向传播(forward)和反向传播(backward)过程,具体来说,它描述了类似于R-CNN(Region-based Convolutional Neural Network)的架构。以下是对图中各个部分的详细解释:

### 1. **ConvNet (applied to entire image)**

- 这是整个网络的基础,表示一个卷积神经网络(ConvNet),它被应用于整张输入图像。

- 卷积神经网络通过一系列的卷积层、池化层等操作提取图像的特征,生成一个特征图(feature map)。这个特征图包含了图像中不同区域的高级特征表示。

### 2. **External proposal algorithm e.g. selective search**

- 在应用卷积神经网络之后,使用外部的候选区域生成算法(如选择性搜索)来生成一系列可能包含目标对象的候选区域(proposals)。

- 这些候选区域是从原始图像中提取出来的矩形框,它们覆盖了图像的不同部分,目的是确保真正的目标对象至少有一个对应的候选区域。

### 3. **RoI pooling**

- 对于每个候选区域,从卷积神经网络生成的特征图中提取相应的特征。这一步骤通常通过RoI(Region of Interest)池化层完成。

- RoI池化层将每个候选区域映射到固定大小的特征图上,以便后续的全连接层可以处理这些特征。这样做的好处是可以处理不同大小和形状的候选区域。

### 4. **FCs (Fully Connected Layers)**

- 提取到的特征被送入一系列全连接层(FCs),这些层进一步对特征进行抽象和组合,以生成更高级的特征表示。

- 全连接层的作用是将局部特征整合为全局特征,从而能够更好地捕捉到目标对象的整体特性。

### 5. **Proposal classifier and Bounding box regressors**

- 经过全连接层处理后的特征被分为两路:

- **Proposal classifier**: 使用线性层加上softmax激活函数,对每个候选区域进行分类,判断其属于哪个类别(包括背景类)。

- **Bounding box regressors**: 使用线性层对每个候选区域进行边界框回归,调整候选区域的位置和大小,使其更准确地包围目标对象。

### 6. **Loss functions**

- 在训练过程中,需要计算损失函数来评估模型的预测结果与真实标签之间的差异,并据此更新模型参数。

- **Log loss + smooth L1 loss**: 分别用于分类任务和回归任务。其中,log loss(交叉熵损失)衡量分类的准确性,而smooth L1 loss则用于边界框回归,以减少异常值的影响。

- 这两个损失函数共同构成了多任务损失(multi-task loss),指导模型同时优化分类和定位两个任务。

### 7. **Trainable**

- “Trainable”部分模块是可训练的,即它们的参数会在训练过程中通过反向传播算法不断更新,以最小化损失函数。

总的来说,从输入图像到最终的目标检测结果的完整流程,包括特征提取、候选区域生成、特征映射、分类和回归等多个步骤,以及相应的损失函数和训练机制。