多模态AI新纪元:Vertex AI Gemini与Spring AI深度集成实践

企业级AI集成进阶:Spring AI与Vertex AI Gemini的配置与调优实战

一、前沿技术:多模态模型的企业级配置范式

在生成式AI技术快速迭代的当下,企业级应用对模型配置的精细化需求日益增长。Vertex AI Gemini作为Google推出的多模态大模型,通过Spring AI框架提供了丰富的配置选项,允许开发者针对不同场景定制模型行为。这种"配置即代码"的模式,不仅提升了开发效率,更确保了模型在生产环境中的稳定性与可扩展性。

1. 配置驱动的AI工程化趋势

随着企业对AI应用的要求从"可用"转向"好用",模型配置参数的重要性愈发凸显:

- 多模型管理:企业往往需要同时部署多个模型应对不同业务场景,如Gemini-Pro处理文本、Gemini-Pro-Vision处理图像,Spring AI通过统一配置接口简化了这种管理复杂度。

- 性能优化:通过调整temperature、topK等参数,可在创造性与准确性之间取得平衡,满足金融、医疗等不同行业的差异化需求。

- 安全合规:借助safetySettings等配置项,企业可实现内容过滤,确保AI输出符合行业监管要求。

2. Vertex AI Gemini的独特优势

Vertex AI Gemini在配置灵活性方面表现突出:

- 多模态配置:支持文本、图像、PDF等多种输入格式的自定义处理,例如通过

responseMimeType指定JSON格式输出,便于后续系统集成。 - 工具调用增强:通过

functions和proxy-tool-calls参数,实现模型与外部工具的深度协作,构建闭环智能系统。 - 动态参数调整:不仅支持启动时配置,还允许运行时通过

VertexAiGeminiChatOptions动态调整参数,适应实时变化的业务需求。

二、配置实战:Spring AI与Vertex AI Gemini的深度集成

1. 核心配置参数详解

Vertex AI Gemini的配置体系分为三层:基础连接配置、聊天模型配置和运行时选项。以下是关键参数的详细说明:

基础连接配置(spring.ai.vertex.ai.gemini)

| 属性 | 描述 | 默认值 |

|---|---|---|

| spring.ai.model.chat | 启用聊天模型客户端 | vertexai |

| spring.ai.vertex.ai.gemini.projectId | Google Cloud项目ID | - |

| spring.ai.vertex.ai.gemini.location | 服务所在区域 | - |

| spring.ai.vertex.ai.gemini.credentialsUri | 凭证URI,用于创建GoogleCredentials实例 | - |

| spring.ai.vertex.ai.gemini.apiEndpoint | API端点 | - |

| spring.ai.vertex.ai.gemini.transport | API传输协议(GRPC或REST) | REST |

聊天模型配置(spring.ai.vertex.ai.gemini.chat)

| 属性 | 描述 | 默认值 |

|---|---|---|

| spring.ai.vertex.ai.gemini.chat.options.model | 模型版本,支持gemini-1.5-pro-001等 | gemini-1.5-pro-001 |

| spring.ai.vertex.ai.gemini.chat.options.responseMimeType | 输出格式(text/plain或application/json) | text/plain |

| spring.ai.vertex.ai.gemini.chat.options.googleSearchRetrieval | 启用Google搜索增强 | false |

| spring.ai.vertex.ai.gemini.chat.options.temperature | 控制输出随机性(0.0-1.0) | 0.8 |

| spring.ai.vertex.ai.gemini.chat.options.topK | 采样时考虑的最大token数 | - |

| spring.ai.vertex.ai.gemini.chat.options.topP | 采样时考虑的token累积概率 | - |

| spring.ai.vertex.ai.gemini.chat.options.candidateCount | 返回的候选响应数量(1-8) | 1 |

| spring.ai.vertex.ai.gemini.chat.options.maxOutputTokens | 最大生成token数 | - |

| spring.ai.vertex.ai.gemini.chat.options.tool名称 | 注册的工具列表(已弃用) | - |

| spring.ai.vertex.ai.gemini.chat.options.functions | 注册的函数列表 | - |

| spring.ai.vertex.ai.gemini.chat.options.proxy-tool-calls | 是否代理函数调用到客户端 | false |

| spring.ai.vertex.ai.gemini.chat.options.safetySettings | 安全过滤设置 | - |

2. 配置实践示例

以下是一个完整的配置示例,展示如何在Spring Boot项目中配置Vertex AI Gemini:

# application.properties

spring.ai.model.chat=vertexai

spring.ai.vertex.ai.gemini.project-id=my-gcp-project

spring.ai.vertex.ai.gemini.location=us-central1

spring.ai.vertex.ai.gemini.chat.options.model=gemini-1.5-pro-001

spring.ai.vertex.ai.gemini.chat.options.temperature=0.6

spring.ai.vertex.ai.gemini.chat.options.googleSearchRetrieval=true

spring.ai.vertex.ai.gemini.chat.options.safetySettings[0].category=HARM_CATEGORY_HATE_SPEECH

spring.ai.vertex.ai.gemini.chat.options.safetySettings[0].threshold=BLOCK_MEDIUM_AND_ABOVE

3. 运行时参数调整

除了配置文件,Spring AI还支持在运行时动态调整参数:

// 动态调整温度和最大输出token

VertexAiGeminiChatOptions options = VertexAiGeminiChatOptions.builder().temperature(0.4).maxOutputTokens(1000).build();ChatResponse response = chatModel.call(new Prompt("详细介绍量子计算的原理", options)

);

4. 函数调用配置

配置模型调用外部工具的能力:

@Bean

@Description("查询股票价格")

public Function<StockRequest, StockResponse> stockFunction() {return request -> {// 调用股票API的实现return new StockResponse("AAPL", 175.25, LocalDateTime.now());};

}// 在请求中启用函数调用

String response = ChatClient.create(chatModel).prompt("查询苹果公司当前股价").functions("stockFunction").call().content();

三、最佳实践与性能优化

1. 参数调优策略

- 创造性场景(如内容生成):提高temperature(0.7-1.0),适当降低topP(0.8-0.9)

- 准确性场景(如问答系统):降低temperature(0.2-0.5),提高topK(40-80)

- 长文本生成:增加maxOutputTokens,同时设置presencePenalty(0.1-0.5)避免重复

2. 安全合规配置

通过safetySettings实现内容过滤:

spring.ai.vertex.ai.gemini.chat.options.safetySettings[0].category=HARM_CATEGORY_HATE_SPEECH

spring.ai.vertex.ai.gemini.chat.options.safetySettings[0].threshold=BLOCK_MEDIUM_AND_ABOVE

spring.ai.vertex.ai.gemini.chat.options.safetySettings[1].category=HARM_CATEGORY_VIOLENCE

spring.ai.vertex.ai.gemini.chat.options.safetySettings[1].threshold=BLOCK_LOW_AND_ABOVE

3. 多模型配置方案

在单个应用中配置多个模型:

@Configuration

public class AiConfig {@Beanpublic ChatModel geminiProModel(VertexAI vertexAI) {return new VertexAiGeminiChatModel(vertexAI, VertexAiGeminiChatOptions.builder().model("gemini-1.5-pro-001").build());}@Beanpublic ChatModel geminiVisionModel(VertexAI vertexAI) {return new VertexAiGeminiChatModel(vertexAI, VertexAiGeminiChatOptions.builder().model("gemini-pro-vision").build());}

}

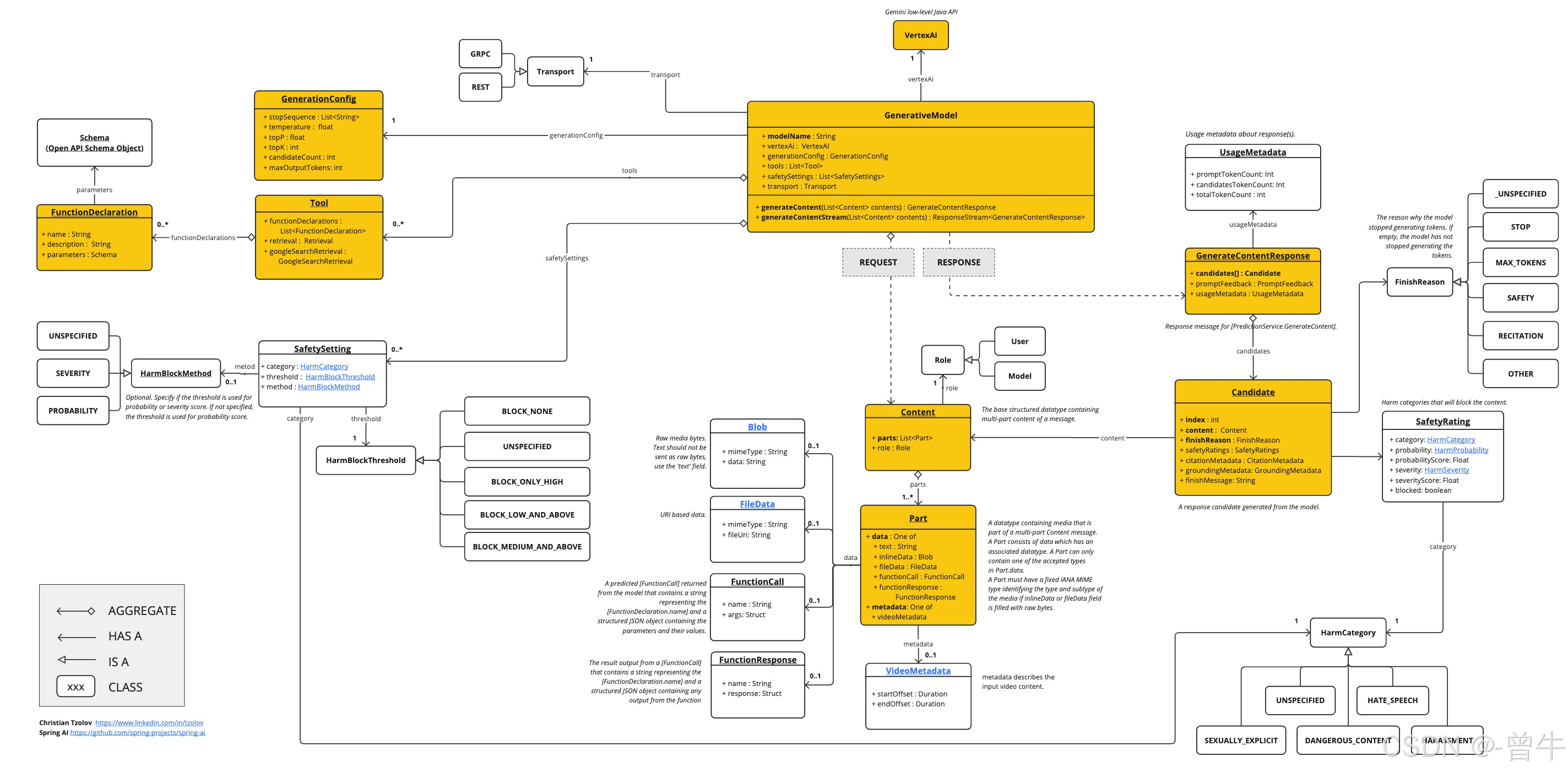

以下类图说明了 Vertex AI Gemini 原生 Java API:

四、未来展望:智能化配置管理

随着AI技术的发展,配置管理也在向智能化演进:

- 自动超参数优化:基于强化学习的自动调参技术,可根据业务指标自动寻找最优参数组合。

- 配置即代码(AIConfig):借鉴DevOps理念,将模型配置纳入版本控制,实现配置的可追溯、可回滚。

- 智能配置推荐:基于行业最佳实践和历史数据,为特定场景推荐最优配置方案。

Vertex AI Gemini与Spring AI的深度集成,为企业提供了强大而灵活的AI配置能力。通过精细化的参数调优和智能化的配置管理,企业能够充分发挥多模态大模型的潜力,构建更加智能、安全、高效的AI应用系统。

参考资料

- Google Vertex AI官方文档:Gemini API指南

- Spring AI官方指南:Spring AI入门

- Gemini 2.0技术白皮书:多模态AI的未来

- 多模态应用案例:BLIP-2与Gemini构建时尚搜索代理

- Google I/O 2025大会实录:Gemini 2.5发布