LLM中的Loss与Logits详解

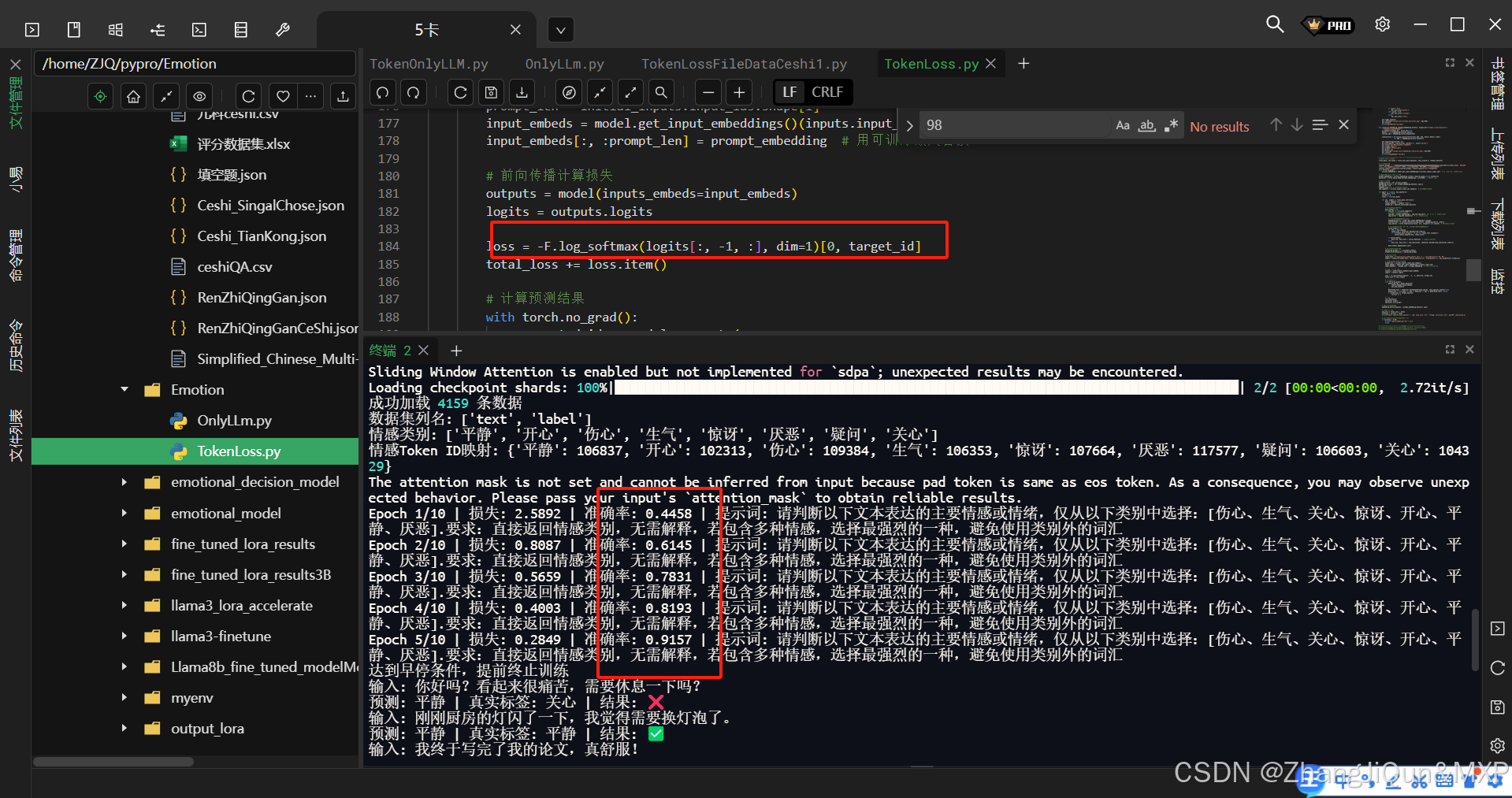

自己构建的logits的损失函数,比自带loss效果好很多,建议自己构建;

另外学习率也是十分重要的参数,多次尝试,通过查看loss的下降趋势进行调整;

举例,来回跳跃说明下降率过大,一般从0.0001 开始尝试。

在深度学习中,logits 和 loss 是两个不同的概念,需要先区分清楚:

logits 是模型输出的原始未归一化分数(如分类任务中未经过 softmax 激活的线性输出)。loss 是根据模型预测(logits 或概率)与真实标签计算的损失值,用于衡量预测与真实值的差距。