QWen3对比QWen2.5:显著优势解析

在人工智能领域,阿里巴巴的QWen系列模型一直以其卓越的性能和广泛的应用场景而受到关注。

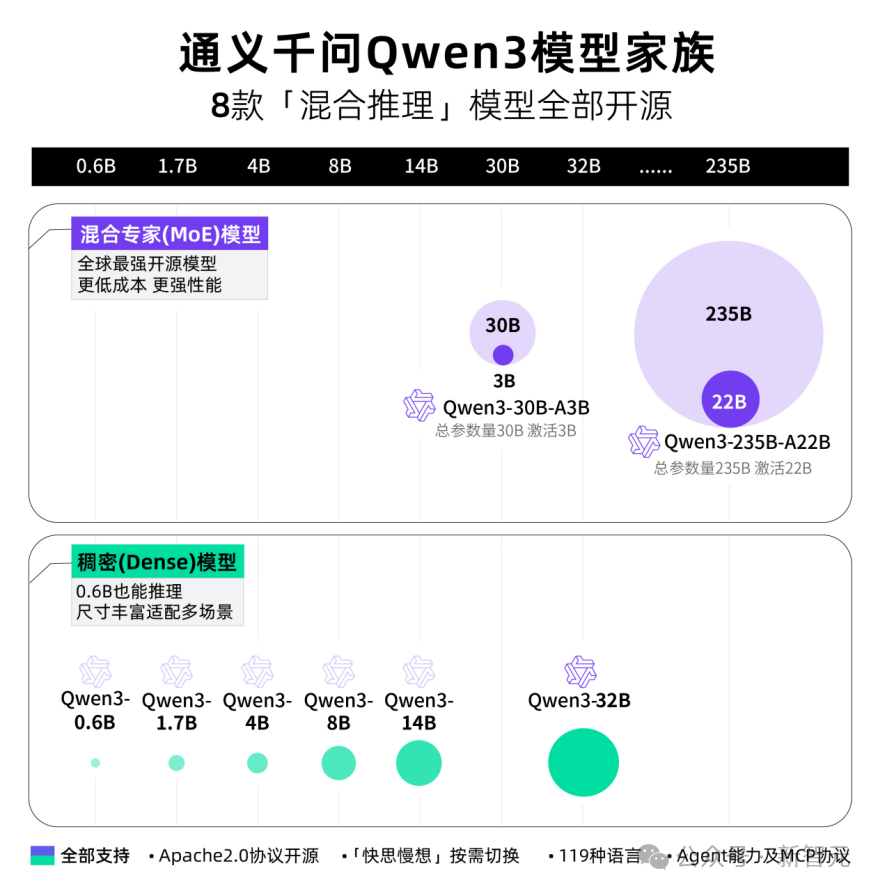

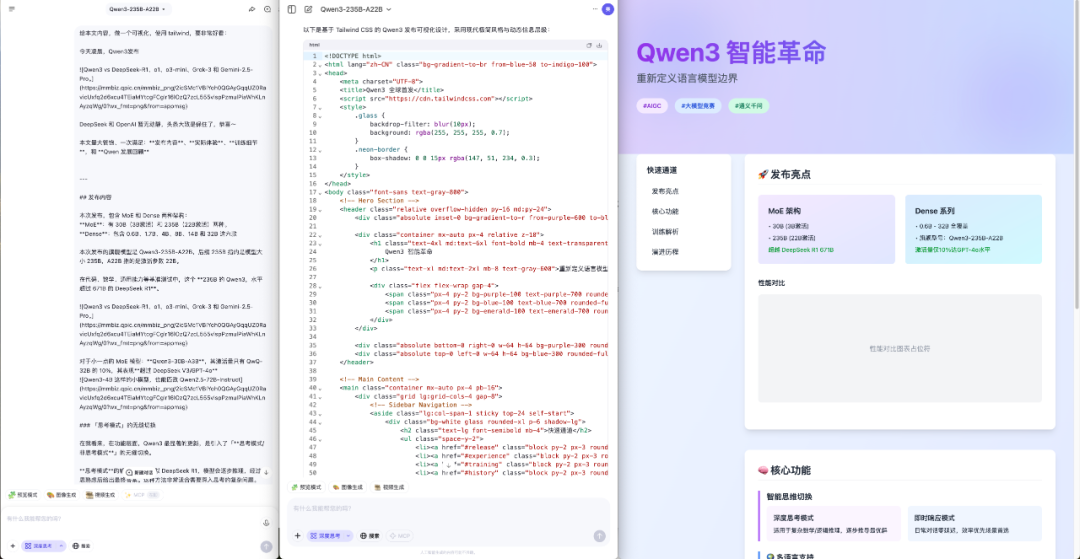

4月28日,阿里巴巴发布了新一代通义千问QWen3模型,这一发布标志着QWen系列在技术和应用上的又一次重大飞跃。与之前的版本QWen2.5相比,QWen3在多个方面展现出了显著的优势。

一、思考模式的创新

QWen3的一个亮点功能是支持两种思考模式:思考模式和非思考模式。在思考模式下,模型会逐步推理,经过深思熟虑后给出最终答案,这种模式非常适合需要深入思考的复杂问题。而非思考模式则提供快速、近乎即时的响应,适用于对速度要求高于深度的简单问题。用户可以根据具体任务控制模型进行“思考”的程度,这种灵活性使得QWen3能够更高效地处理不同类型的任务。这一创新大大增强了模型的实用性和适应性。

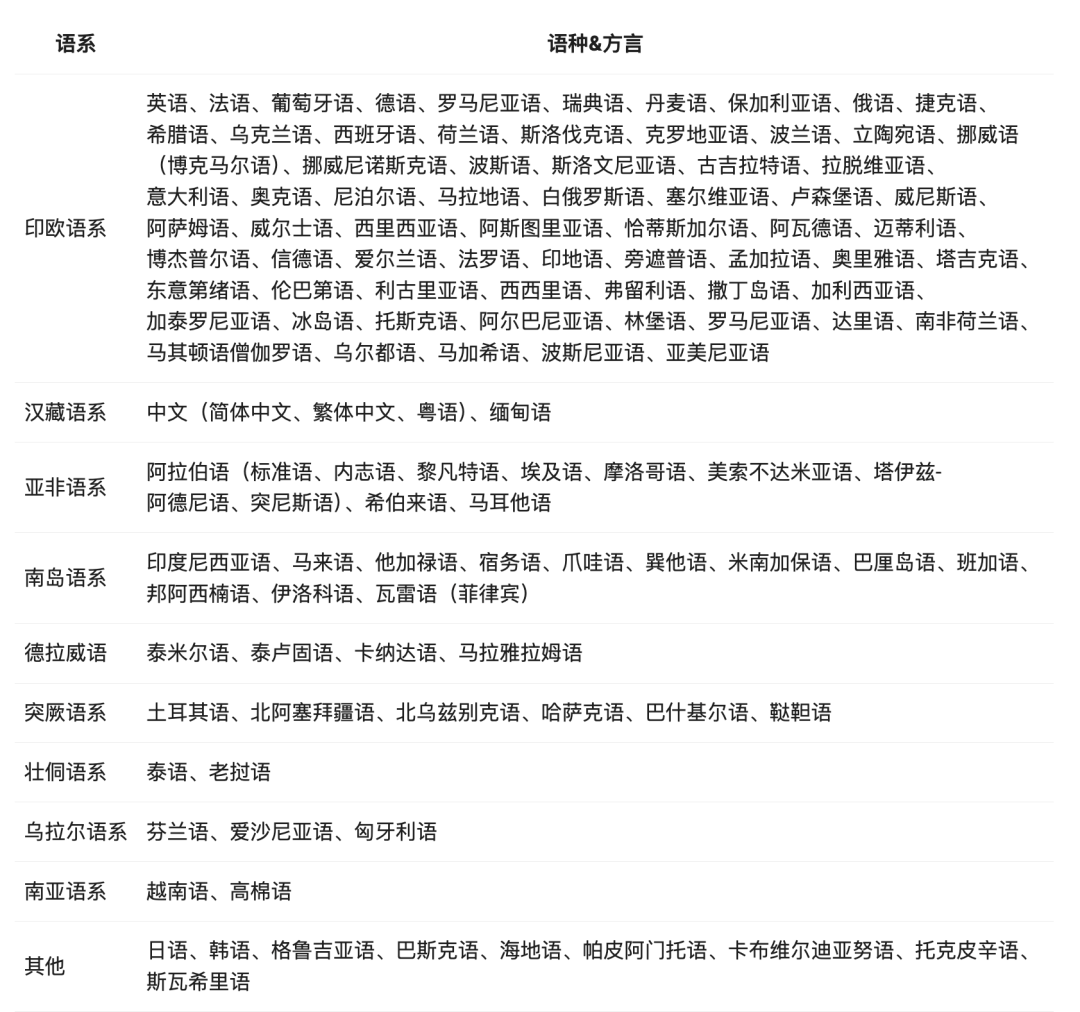

二、语言支持的扩展

QWen3在语言支持方面也取得了显著进展。它不仅支持中文,还涵盖了葡萄牙语、德语、罗马尼亚语、瑞典语、丹麦语、保加利亚语等共计119种语言和方言,相比QWen2.5支持的29种以上语言有了大幅提升。这一广泛的多语言能力为国际应用开辟了新的可能性,使得QWen3能够在全球范围内发挥更大的作用。

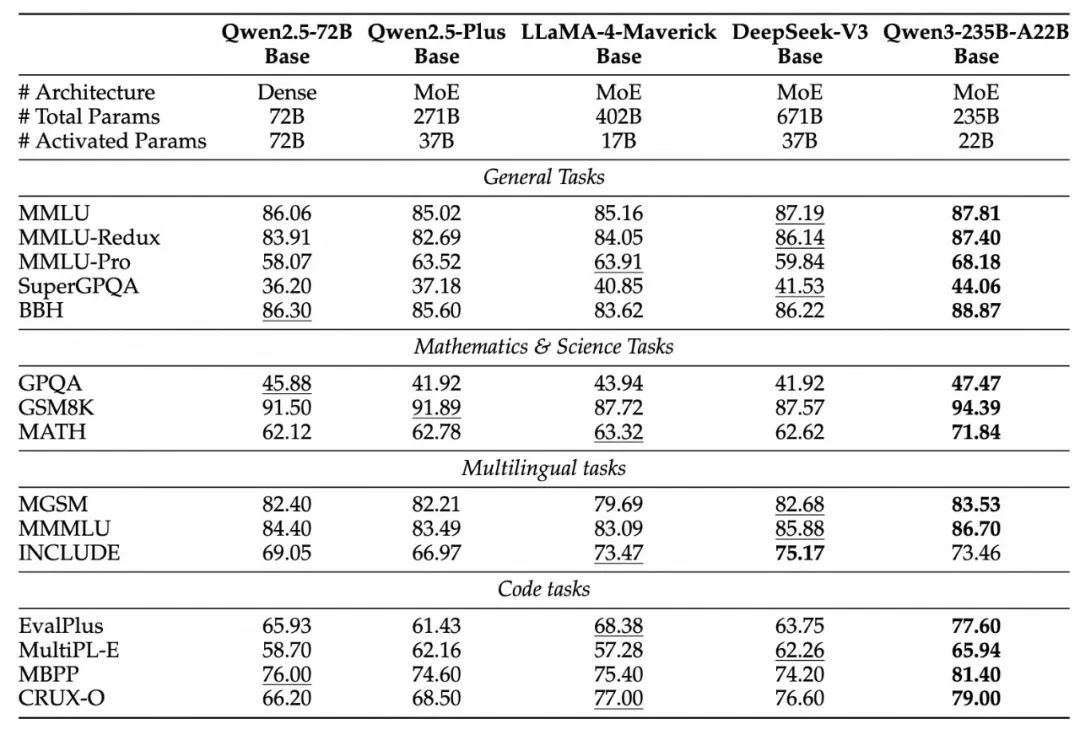

三、预训练数据的增加和训练方法的改进

在预训练方面,QWen3使用的数据量几乎达到了QWen2.5的两倍,涵盖了119种语言和方言的约36万亿个token,而QWen2.5则是在18万亿个token上进行预训练的。为了构建这个庞大的数据集,阿里巴巴不仅从网络上收集数据,还从PDF文档中提取信息,并利用QWen2.5-VL和QWen2.5等模型改进提取内容的质量。此外,QWen3还通过增加数学和代码数据的数量,合成了包括教科书、问答对以及代码片段等多种形式的数据,进一步丰富了训练集。

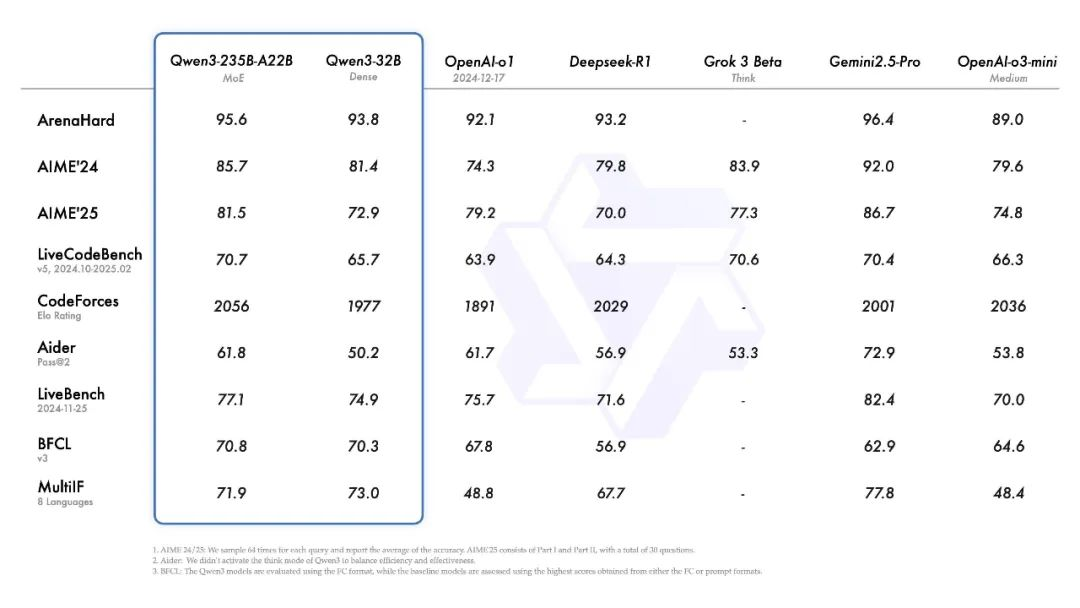

在训练方法上,QWen3也进行了多项改进。预训练过程分为三个阶段,每个阶段都针对模型的不同能力进行了优化。这些改进使得QWen3在STEM、编码和推理等领域的表现甚至超过了更大规模的QWen2.5模型。

四、模型架构的优化和推理效率的提升

QWen3在模型架构上也进行了优化,采用了分层稀疏调度与动态专家激活机制等先进技术。这些优化使得QWen3在推理效率上有了显著提升,同时降低了显存占用。例如,在15B参数模型中,QWen3仅需激活2B参数,推理效率提升42%,显存占用从28GB降至18GB。此外,QWen3还支持RTX3090等消费级显卡运行类GPT-4性能模型,进一步降低了使用门槛。

五、应用场景的拓展

由于QWen3在性能上的显著提升和功能的丰富化,它的应用场景也得到了极大的拓展。在教育领域,QWen3可以作为智能辅导工具,为学生解答学习过程中的各种问题;在企业办公中,它可以用于智能客服和自动化办公;在科研领域,QWen3为研究人员提供强大的数据处理和分析支持;在编程开发方面,QWen3-coder为开发者提供高效的编程辅助。此外,QWen3还在政务、医疗、金融等多个领域展现出了广泛的应用前景。

六、开源策略和工具链升级

阿里巴巴延续了通义千问的开源传统,为QWen3提供了多个版本的开源模型,包括8B/15B/72B等版本,并支持Hugging Face平台调用。此外,阿里巴巴还推出了动态量化工具、分布式训练框架等配套工具链升级,进一步降低了AI应用门槛,推动了产业智能化进程。

综上所述,QWen3相比QWen2.5在思考模式的创新、语言支持的扩展、预训练数据的增加和训练方法的改进、模型架构的优化和推理效率的提升以及应用场景的拓展等方面都展现出了显著的优势。这些优势使得QWen3成为国产大模型对标全球领先水平的关键选手,并在推动产业智能化进程中发挥着越来越重要的作用。